Введение в основные компоненты ETL и общие инструменты ETL.

Технология ETL (Extract-Transform-Load) является ключевым компонентом в области интеграции данных и широко используется в хранилищах данных, обработке больших данных и современных системах анализа данных. Он включает в себя процесс извлечения данных из различных источников, проведения необходимых преобразований и, наконец, загрузки их в целевую систему (например, хранилище данных, озеро данных или другую аналитическую платформу). Ниже приведены основные компоненты стека технологий ETL и введение в связанные технологии:

1. Извлечение данных (Извлечение)

- Подключение к исходной системе: требуется возможность интеграции с различными источниками данных, включая реляционные базы данных (такие как MySQL, Oracle), базы данных NoSQL (MongoDB, Cassandra), API, файловые системы (CSV, JSON, XML), облачное хранилище (S3). ) , хранилище BLOB-объектов Azure) и т. д.

- Инструменты извлечения данных: например, Sqoop используется для извлечения данных в среде Hadoop, Kafka используется для захвата потоков данных в реальном времени, а соединитель JDBC используется для извлечения данных из реляционной базы данных.

- Инкрементное извлечение: такие технологии, как извлечение моментальных снимков, извлечение на основе журналов, сравнение временных меток и т. д., гарантируют, что можно эффективно извлечь только новые или измененные данные с момента последнего извлечения.

2. Преобразование данных (Преобразование)

- Очистка данных: включая удаление повторяющихся записей, обработку нулевых значений, обнаружение и обработку выбросов, преобразование типов данных и т. д.

- Сопоставление и стандартизация данных: унификация форматов данных из разных источников, например стандартизация формата даты и преобразование единиц измерения.

- Проверка качества данных: проверка полноты, согласованности и точности данных, что может включать использование инструментов обеспечения качества данных.

- Инструменты преобразования данных: такие как Apache Spark для крупномасштабной обработки и преобразования данных, SSIS (службы интеграции SQL Server) для задач преобразования данных в экосистеме Microsoft, а также Talend с открытым исходным кодом, Apache NiFi и т. д.

3. Загрузка данных (Load)

- Интерфейс целевой системы: поддерживает загрузку в различные целевые системы, включая хранилища данных (например, Teradata, Snowflake), озера данных (например, Hadoop HDFS, AWS S3) или базы данных NoSQL и т. д.

- Пакетная загрузка и загрузка в реальном времени. Выберите подходящую стратегию загрузки в соответствии с потребностями бизнеса. Пакетная загрузка подходит для периодической обработки больших объемов данных, а загрузка в реальном времени (например, с использованием Kafka Streams, Flink) подходит для сценариев, в которых требуют немедленного анализа.

- Стратегии загрузки: полная загрузка, поэтапная загрузка, микропакетная обработка и т. д. для адаптации к различной своевременности обработки данных и ограничениям системных ресурсов.

Вспомогательные технологии и инструменты

- Управление метаданными: отслеживайте источники данных, процессы преобразования, качество данных и другую метаинформацию, а также документируйте и управляйте процессом ETL.

- Планирование и управление рабочими процессами: такие как Airflow и Oozie, используются для автоматического выполнения задач ETL в запланированное время, управления зависимостями задач и обработки ошибок.

- Мониторинг и ведение журнала: внедрите мониторинг производительности, сигналы об ошибках и отслеживание операций ETL для обеспечения стабильности и отслеживаемости процесса.

- Безопасность данных и защита конфиденциальности: зашифрованная передача, контроль доступа, десенсибилизация и т. д. для обеспечения безопасности во время обработки данных.

Общие инструменты для ETL

Обычно используемые инструменты для ETL (извлечение, преобразование, загрузка) в основном включают следующее:

1. Kettle (Pentaho Data Integration):

Он имеет открытый исходный код, бесплатен, написан на чистом Java и работает кроссплатформенно. Предоставляет графический интерфейс, прост в использовании и поддерживает несколько источников и целей данных. Он имеет богатые этапы преобразования и функции планирования заданий. Подходит для малых и средних предприятий и энтузиастов открытого исходного кода.

2. Informatica PowerCenter

Программное обеспечение для бизнеса, широко используемое на крупных предприятиях. Обеспечьте мощные возможности интеграции данных и поддержите разработку сложных процессов ETL. Он обладает высокой масштабируемостью и оптимизированной производительностью и подходит для крупномасштабных проектов интеграции данных.

3. Apache NiFi

Проект с открытым исходным кодом, поддерживаемый Apache Software Foundation. Предоставляет веб-интерфейс пользователя для облегчения проектирования, управления и мониторинга потоков данных. Специализируется на обработке потоков данных в реальном времени и данных Интернета вещей (IoT).

4. Talend Open Studio

Версия с открытым исходным кодом бесплатна, также доступна платная корпоративная версия. Поддерживает широкий спектр разъемов для обработки больших данных и интеграции облачных данных. Он имеет графический интерфейс для облегчения построения сложных конвейеров данных.

5. Microsoft SQL Server Integration Services (SSIS)

Инструменты ETL, предоставляемые Microsoft, тесно интегрированы с SQL Server. Он подходит для решения задач интеграции данных в среде SQL Server и предоставляет богатые элементы управления и компоненты потока данных.

6. Apache Airflow

Система управления рабочими процессами с открытым исходным кодом, предназначенная для конвейеров данных и пакетной работы. Поддерживает рабочий процесс написания Python, подходящий для сценариев ETL, требующих высокой степени настройки и программного управления.

7. DataStage (IBM InfoSphere)

Продукты IBM нацелены на рынок интеграции данных корпоративного уровня. Предоставляет высокопроизводительную платформу параллельной обработки, поддерживающую облачное и локальное развертывание. Подходит для реализации больших и сложных проектов по интеграции данных.

8.Sqoop (Apache Sqoop)

В основном используется для передачи данных между Hadoop и реляционными базами данных. Подходит для задач извлечения и загрузки данных в сценариях больших данных.

9. StreamSets

Предоставляет визуальный интерфейс проектирования потоков данных, который поддерживает потоки данных в реальном времени и пакетные данные. Особенно подходит для интеграции данных в облачных и гибридных облачных средах.

10. Apache Kafka Connect

Используется для создания масштабируемых конвейеров потоков данных, часто используемых для интеграции данных в реальном времени. Глубоко интегрирован с системой очередей сообщений Apache Kafka, поддерживает несколько источников данных и целевых соединителей.

Каждый из этих инструментов имеет свои преимущества, и при выборе одного из них следует учитывать конкретные потребности проекта, бюджет, навыки команды, а также необходимость поддержки конкретной технологической экосистемы.

С развитием больших данных и облачных вычислений современные стеки технологий ETL также включают в себя новые концепции, такие как большее количество облачных сервисов, модели машинного обучения для расширенной обработки данных и обратный ETL (перенос данных из хранилища данных обратно в бизнес-систему). ), что еще больше обогащает и улучшает возможности интеграции данных.

Углубленный анализ переполнения памяти CUDA: OutOfMemoryError: CUDA не хватает памяти. Попыталась выделить 3,21 Ги Б (GPU 0; всего 8,00 Ги Б).

[Решено] ошибка установки conda. Среда решения: не удалось выполнить первоначальное зависание. Повторная попытка с помощью файла (графическое руководство).

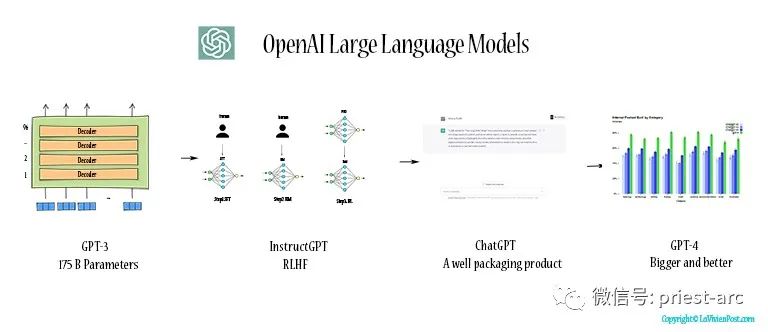

Прочитайте нейросетевую модель Трансформера в одной статье

.ART Теплые зимние предложения уже открыты

Сравнительная таблица описания кодов ошибок Amap

Уведомление о последних правилах Points Mall в декабре 2022 года.

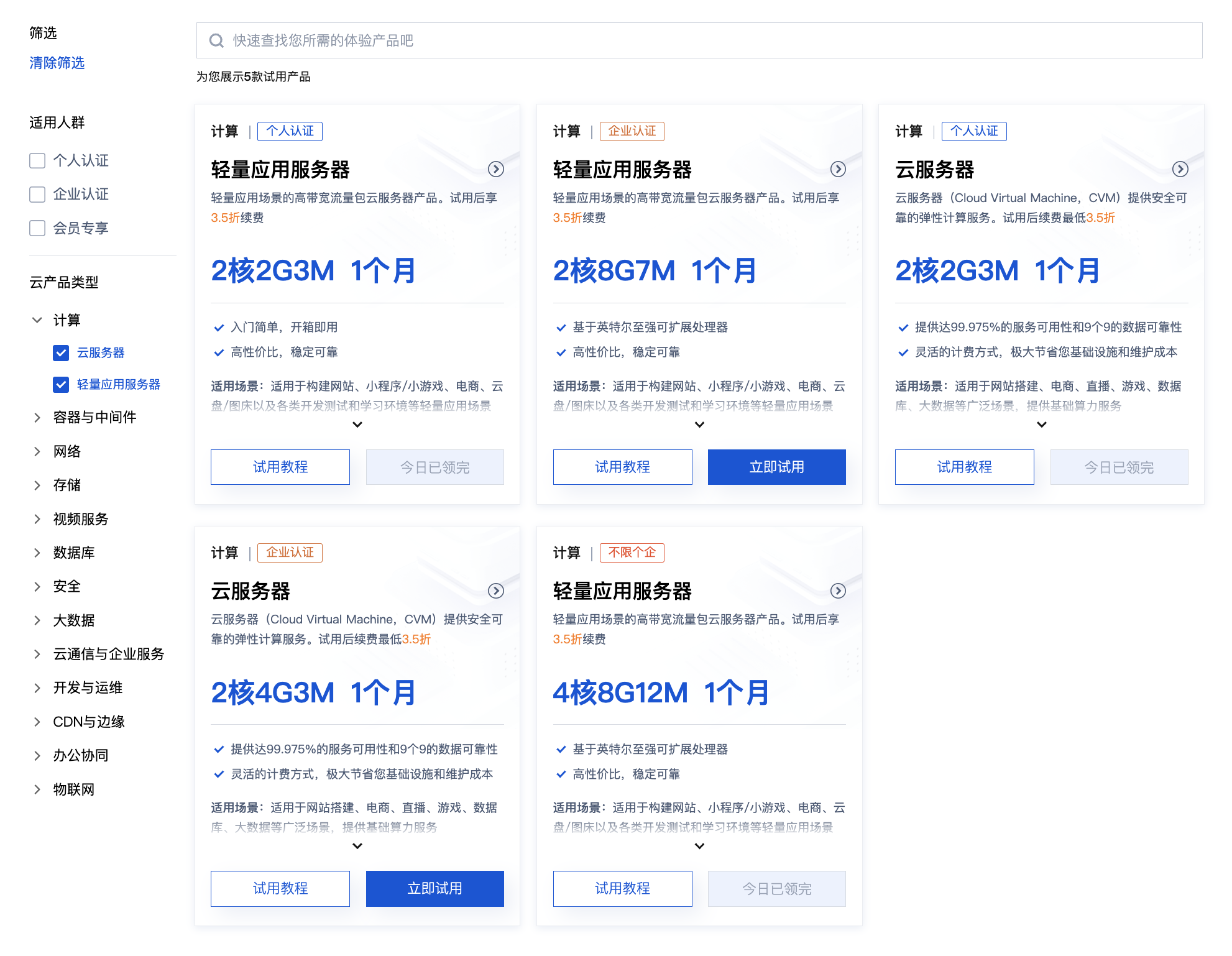

Даже новички могут быстро приступить к работе с легким сервером приложений.

Взгляд на RSAC 2024|Защита конфиденциальности в эпоху больших моделей

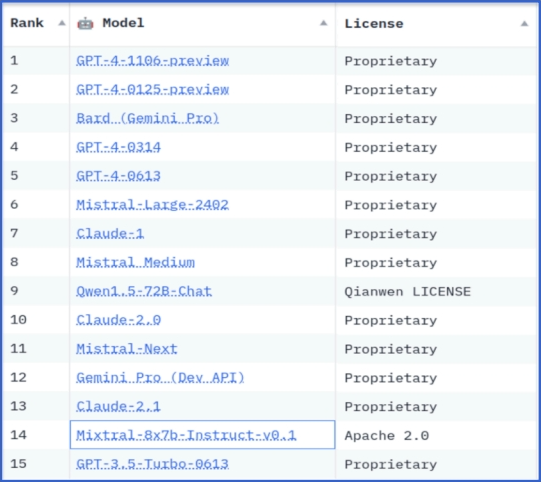

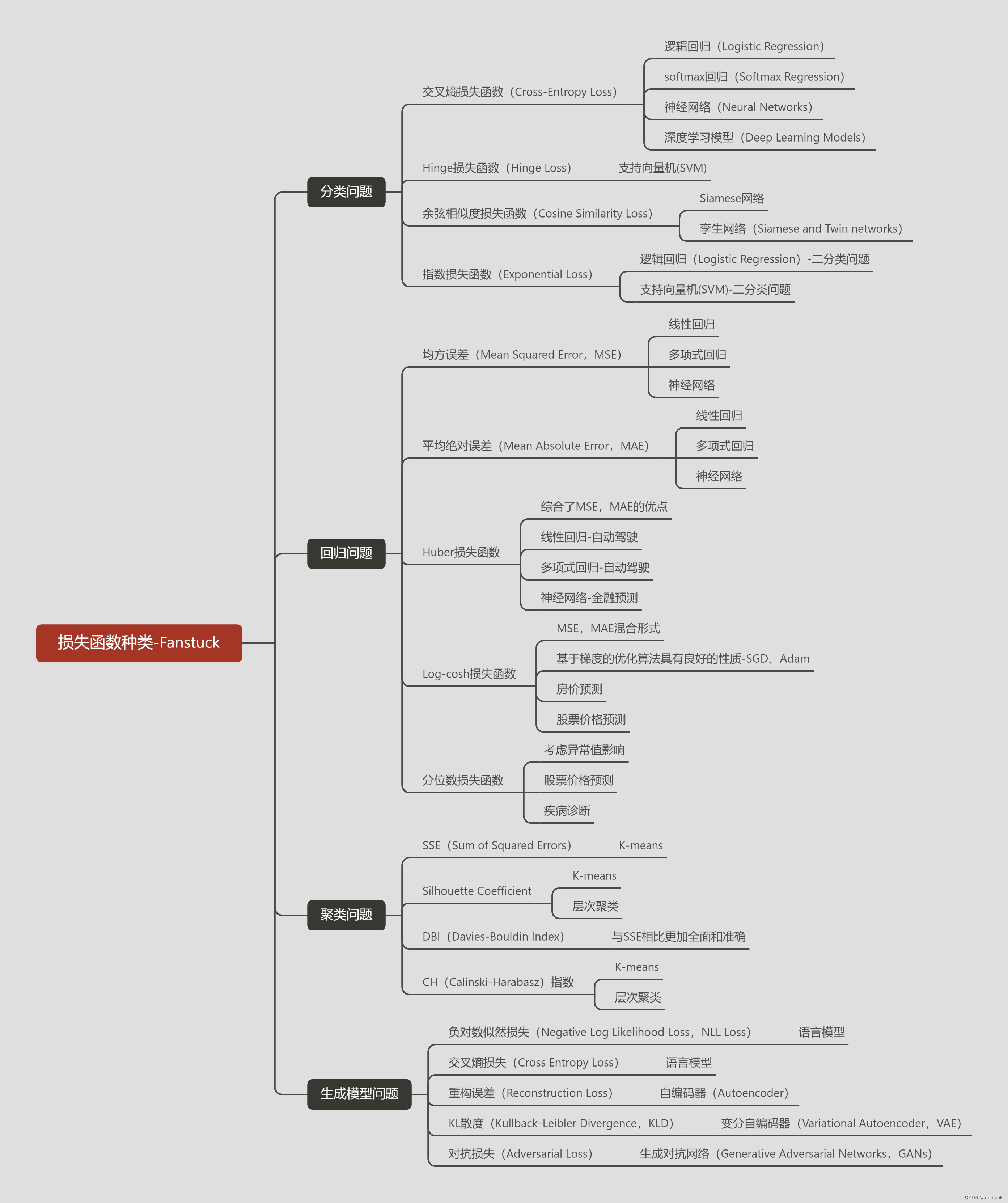

Вы используете ИИ каждый день и до сих пор не знаете, как ИИ дает обратную связь? Одна статья для понимания реализации в коде Python общих функций потерь генеративных моделей + анализ принципов расчета.

Используйте (внутренний) почтовый ящик для образовательных учреждений, чтобы использовать Microsoft Family Bucket (1T дискового пространства на одном диске и версию Office 365 для образовательных учреждений)

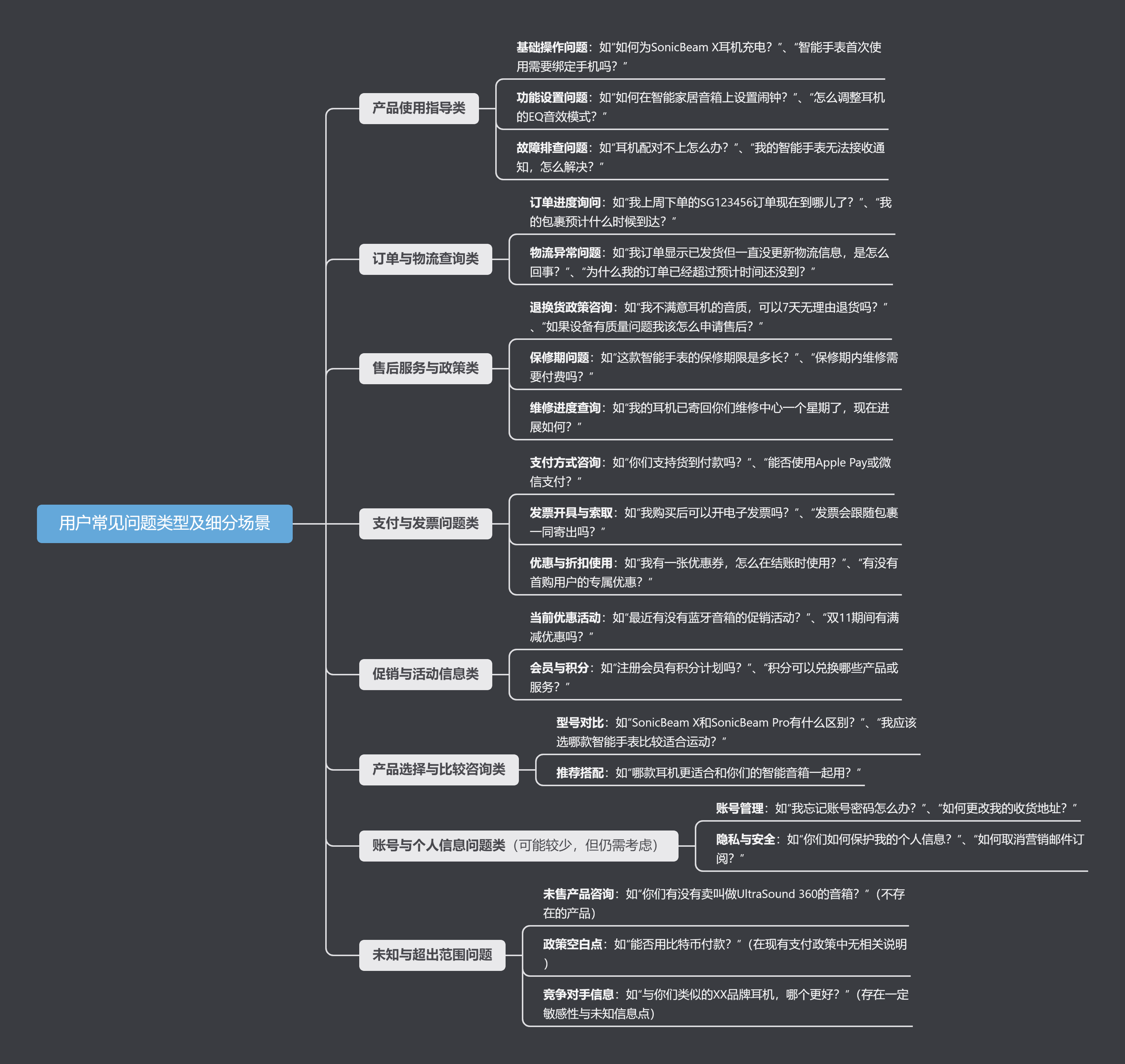

Руководство по началу работы с оперативным проектом (7) Практическое сочетание оперативного письма — оперативного письма на основе интеллектуальной системы вопросов и ответов службы поддержки клиентов

[docker] Версия сервера «Чтение 3» — создайте свою собственную программу чтения веб-текста

Обзор Cloud-init и этапы создания в рамках PVE

Корпоративные пользователи используют пакет регистрационных ресурсов для регистрации ICP для веб-сайта и активации оплаты WeChat H5 (с кодом платежного узла версии API V3)

Подробное объяснение таких показателей производительности с высоким уровнем параллелизма, как QPS, TPS, RT и пропускная способность.

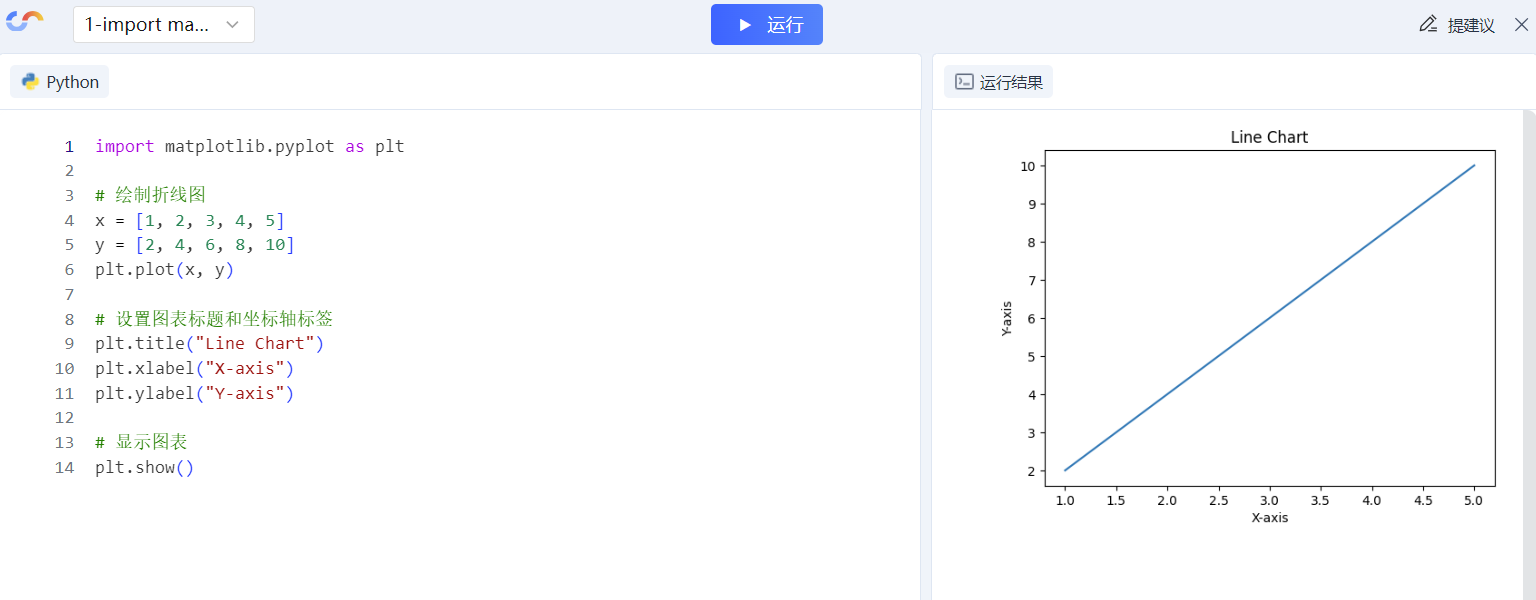

Удачи в конкурсе Python Essay Challenge, станьте первым, кто испытает новую функцию сообщества [Запускать блоки кода онлайн] и выиграйте множество изысканных подарков!

[Техническая посадка травы] Кровавая рвота и отделка позволяют вам необычным образом ощипывать гусиные перья! Не распространяйте информацию! ! !

[Официальное ограниченное по времени мероприятие] Сейчас ноябрь, напишите и получите приз

Прочтите это в одной статье: Учебник для няни по созданию сервера Huanshou Parlu на базе CVM-сервера.

Cloud Native | Что такое CRD (настраиваемые определения ресурсов) в K8s?

Как использовать Cloudflare CDN для настройки узла (CF самостоятельно выбирает IP) Гонконг, Китай/Азия узел/сводка и рекомендации внутреннего высокоскоростного IP-сегмента

Дополнительные правила вознаграждения амбассадоров акции в марте 2023 г.

Можно ли открыть частный сервер Phantom Beast Palu одним щелчком мыши? Супер простой урок для начинающих! (Прилагается метод обновления сервера)

[Играйте с Phantom Beast Palu] Обновите игровой сервер Phantom Beast Pallu одним щелчком мыши

Maotouhu делится: последний доступный внутри страны адрес склада исходного образа Docker 2024 года (обновлено 1 декабря)

Кодирование Base64 в MultipartFile

5 точек расширения SpringBoot, супер практично!

Глубокое понимание сопоставления индексов Elasticsearch.