Технические принципы архитектуры NVIDIA Tensor Core

Архитектура NVIDIA Tensor Core — это аппаратный блок, предназначенный для ускорения матричных и тензорных операций в области искусственного интеллекта, глубокого обучения, высокопроизводительных вычислений (HPC) и других областей. С момента своего первого появления в архитектуре Volta тензорные ядра стали основной функцией высокопроизводительных графических процессоров NVIDIA и продолжали развиваться в последующих архитектурах Turing, Ampere и последующих.

Представьте предысторию и цель

С развитием глубокого обучения традиционное ядро CUDA имеет ограниченную эффективность при обработке крупномасштабных операций умножения матриц и операций свертки. Тензорные ядра предназначены для эффективного выполнения этих операций, распространенных во время обучения и вывода моделей глубокого обучения, значительно улучшая без ущерба для точности модели за счет использования вычислений смешанной точности (обычно комбинация FP16 и FP32). Производительность вычислений.

расчеты смешанной точности

Смешанная точность означает одновременное использование типов данных различной точности в процессе вычислений, таких как одинарная точность (FP32), половинная точность (FP16) или более низкая точность, чтобы достичь более высокой эффективности вычислений. Тензорные ядра способны выполнять операции умножения-накопления (FMA) FP16 и поддерживают TF32 (специфичный для NVIDIA 32-битный формат с плавающей запятой, разработанный для обеспечения точности, близкой к FP32, но близкой к производительности FP16) и других режимов смешанной точности, позволяющих Значительно повысьте производительность, сохраняя при этом точность модели.

Введение архитектуры Вольта

Тензорные ядра впервые появились в архитектуре NVIDIA Volta, что стало большим достижением для графических процессоров в области глубокого обучения. Это поколение тензорных ядер в основном ориентировано на ускорение базовых операций умножения матриц в глубоком обучении, предоставляя исследователям и разработчикам мощные инструменты ускорения.

Расширения архитектуры Тьюринга

В архитектуре Тьюринга функции тензорных ядер были дополнительно расширены: они не только поддерживают более широкий спектр операций смешанной точности, но также добавляют ядро RT для трассировки лучей в реальном времени, что делает графический процессор важным как для рендеринга графики, так и для вычислений с использованием искусственного интеллекта. . продвигать.

Оптимизация архитектуры Ampere

Тензорные ядра архитектуры Ampere, например, в графическом процессоре NVIDIA A100, обеспечивают более высокий уровень повышения производительности. A100 способен обеспечить в 20 раз более высокую производительность, чем предыдущее поколение, и обеспечивает поддержку более крупных тензорных операций, а также более крупных конфигураций памяти (например, версии 40 ГБ и 80 ГБ), расширяя возможности обработки крупномасштабных наборов данных и сложных моделей. поддерживать. Кроме того, в A100 реализована функция Multi-Instance GPU (MIG), которая позволяет разделить графический процессор на несколько независимых экземпляров, чтобы лучше удовлетворить потребности различных рабочих нагрузок и улучшить использование ресурсов.

Структура и технические принципы

Технология NVIDIA Tensor Core — это аппаратный ускоритель, предназначенный для ускорения задач массово-параллельных вычислений, в частности, умножения матриц и тензорных операций в приложениях глубокого обучения, машинного обучения и высокопроизводительных вычислений (HPC).

Принцип работы тензорных ядер основан на сильно распараллеленных операциях умножения и накопления матриц. Он особенно оптимизирует небольшие операции умножения матриц 4x4x4 или 16x16x16, которые распространены в глубоком обучении, и может выполнять большое количество таких операций за один такт. Они достигают большей энергоэффективности и производительности за счет снижения требований к пропускной способности вычислений и хранилища за счет оптимизации на аппаратном уровне.

расчеты смешанной точности

Тензорные ядра поддерживают операции смешанной точности — метод, который одновременно использует различную числовую точность во время вычислений. Обычно это означает использование половинной точности (FP16) для внутренних вычислений и использование одинарной точности (FP32) или выше на входе и выходе для сохранения точности конечного результата. Этот подход может значительно повысить скорость вычислений и энергоэффективность, не жертвуя при этом качеством прогнозов модели. В некоторых архитектурах, например Ampere, также представлен TF32, обеспечивающий точность, близкую к FP32, но со скоростью вычислений FP16.

Специальное аппаратное ускорение

В отличие от традиционных ядер CUDA, тензорные ядра представляют собой аппаратные блоки, оптимизированные для операций умножения и накопления матриц (Multiply-Accumulate, MAC). Они могут выполнять несколько операций умножения-накопления матриц FP16 или TF32 за один такт, что значительно повышает пропускную способность. Например, в архитектуре Volta каждое тензорное ядро может одновременно обрабатывать тензорную операцию 4x4x4; в архитектуре Ampere тензорные ядра были дополнительно модернизированы и могут обрабатывать матрицы большего размера, такие как умножение матриц FP16 или TF32 16x16x16.

Возможность параллельной обработки

Поскольку приложения глубокого обучения и высокопроизводительных вычислений требуют большого объема параллельных вычислений, тензорные ядра используют преимущества архитектуры параллельной обработки графического процессора и могут выполнять тысячи таких матричных операций одновременно, что очень подходит для обработки интенсивного обучения и процесса вывода больших объемов данных. нейронные сети. Вычислительные задачи.

Поддержка программного стека

Чтобы в полной мере использовать производительность тензорных ядер, NVIDIA предоставляет множество программных инструментов и библиотек, таких как cuDNN, cuBLAS и т. д., которые оптимизированы для тензорных ядер и позволяют разработчикам ускорять свои приложения с помощью вызовов API высокого уровня без необходимость глубоко разбираться в деталях оборудования.

Точность динамической регулировки

Тензорные ядра могут гибко настраивать точность вычислений в соответствии со сценариями приложения, позволяя пользователям находить компромисс между производительностью и точностью. Это особенно полезно для определенных сценариев, которые не имеют чрезвычайно строгих требований к точности и могут еще больше повысить эффективность вычислений.

Сжатие памяти и оптимизация пропускной способности

Чтобы уменьшить узкие места при передаче данных, тензорные ядра также поддерживают сжатие форматов данных и эффективные шаблоны доступа к памяти, что снижает потребность в памяти с высокой пропускной способностью и повышает общую производительность системы.

Tensor Базовая технология посредством оптимизации на аппаратном уровне, расчеты смешанной точности и тесная интеграция с экосистемой программного обеспечения, позволяющая добиться значительных улучшений в более глубоких измерениях при сохранении точности вычислений. скорость и эффективность обработки знаний и научных вычислений.

Подвести итог

Архитектура NVIDIA Tensor Core представляет собой важную веху в технологии графических процессоров в ускорении искусственного интеллекта и высокопроизводительных вычислений. Благодаря инновационному дизайну оборудования и оптимизации алгоритмов она значительно повышает эффективность вычислений, снижает эксплуатационные расходы и способствует быстрому развитию таких областей, как искусственный интеллект и научные вычисления. Ожидается, что благодаря постоянному обновлению технологии тензорные ядра продолжат обеспечивать новый скачок в производительности вычислений в будущем.

Углубленный анализ переполнения памяти CUDA: OutOfMemoryError: CUDA не хватает памяти. Попыталась выделить 3,21 Ги Б (GPU 0; всего 8,00 Ги Б).

[Решено] ошибка установки conda. Среда решения: не удалось выполнить первоначальное зависание. Повторная попытка с помощью файла (графическое руководство).

Прочитайте нейросетевую модель Трансформера в одной статье

.ART Теплые зимние предложения уже открыты

Сравнительная таблица описания кодов ошибок Amap

Уведомление о последних правилах Points Mall в декабре 2022 года.

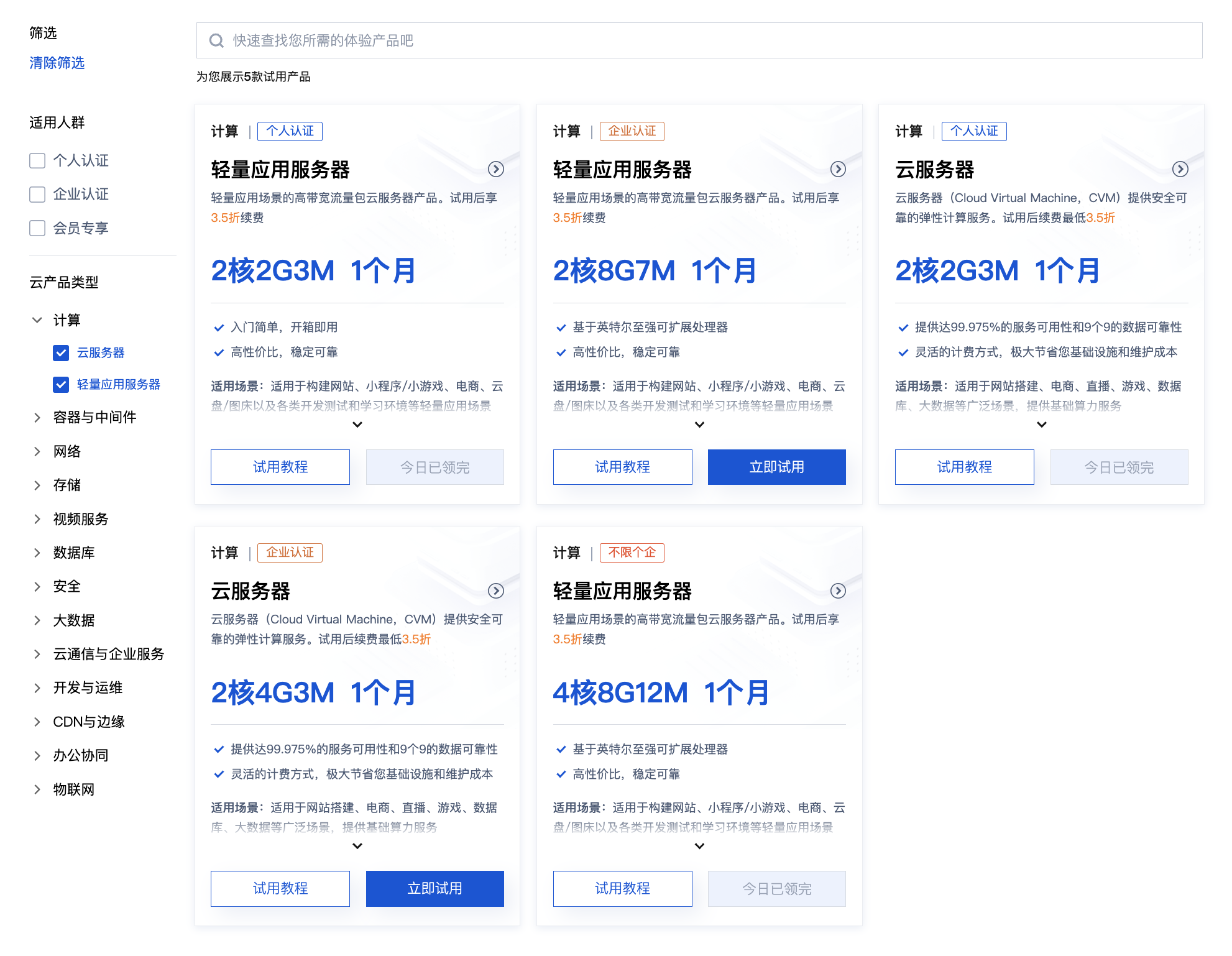

Даже новички могут быстро приступить к работе с легким сервером приложений.

Взгляд на RSAC 2024|Защита конфиденциальности в эпоху больших моделей

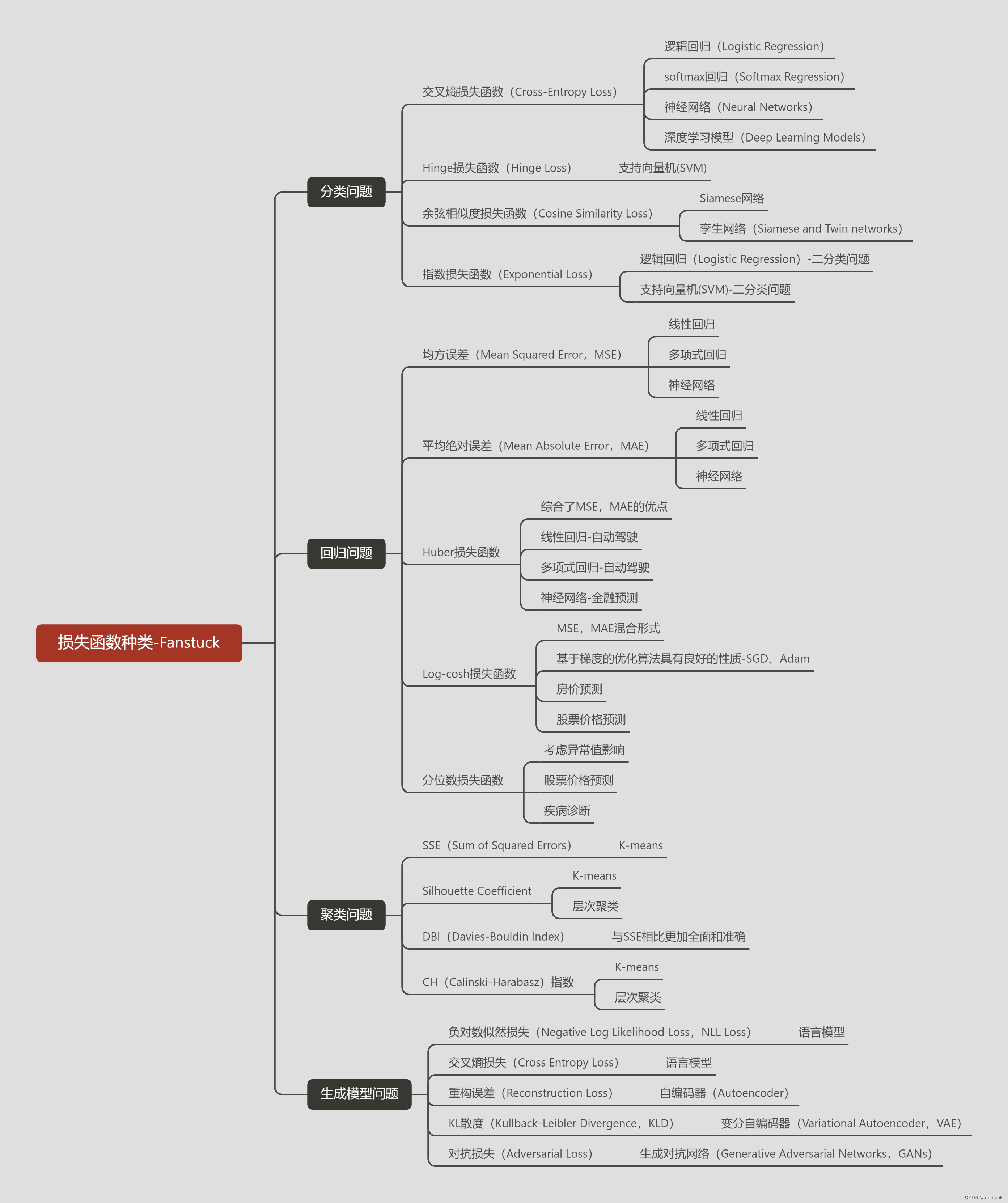

Вы используете ИИ каждый день и до сих пор не знаете, как ИИ дает обратную связь? Одна статья для понимания реализации в коде Python общих функций потерь генеративных моделей + анализ принципов расчета.

Используйте (внутренний) почтовый ящик для образовательных учреждений, чтобы использовать Microsoft Family Bucket (1T дискового пространства на одном диске и версию Office 365 для образовательных учреждений)

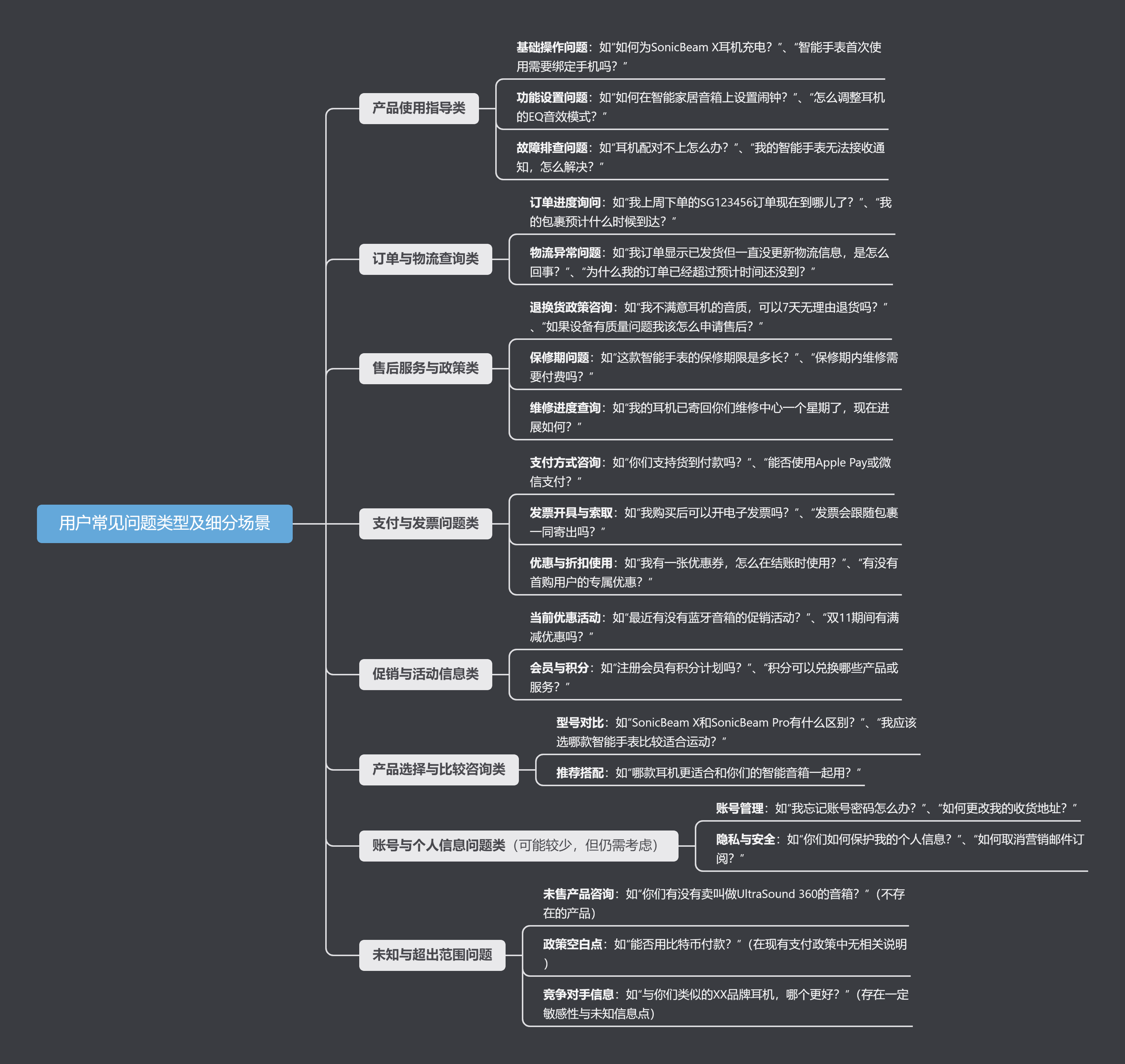

Руководство по началу работы с оперативным проектом (7) Практическое сочетание оперативного письма — оперативного письма на основе интеллектуальной системы вопросов и ответов службы поддержки клиентов

[docker] Версия сервера «Чтение 3» — создайте свою собственную программу чтения веб-текста

Обзор Cloud-init и этапы создания в рамках PVE

Корпоративные пользователи используют пакет регистрационных ресурсов для регистрации ICP для веб-сайта и активации оплаты WeChat H5 (с кодом платежного узла версии API V3)

Подробное объяснение таких показателей производительности с высоким уровнем параллелизма, как QPS, TPS, RT и пропускная способность.

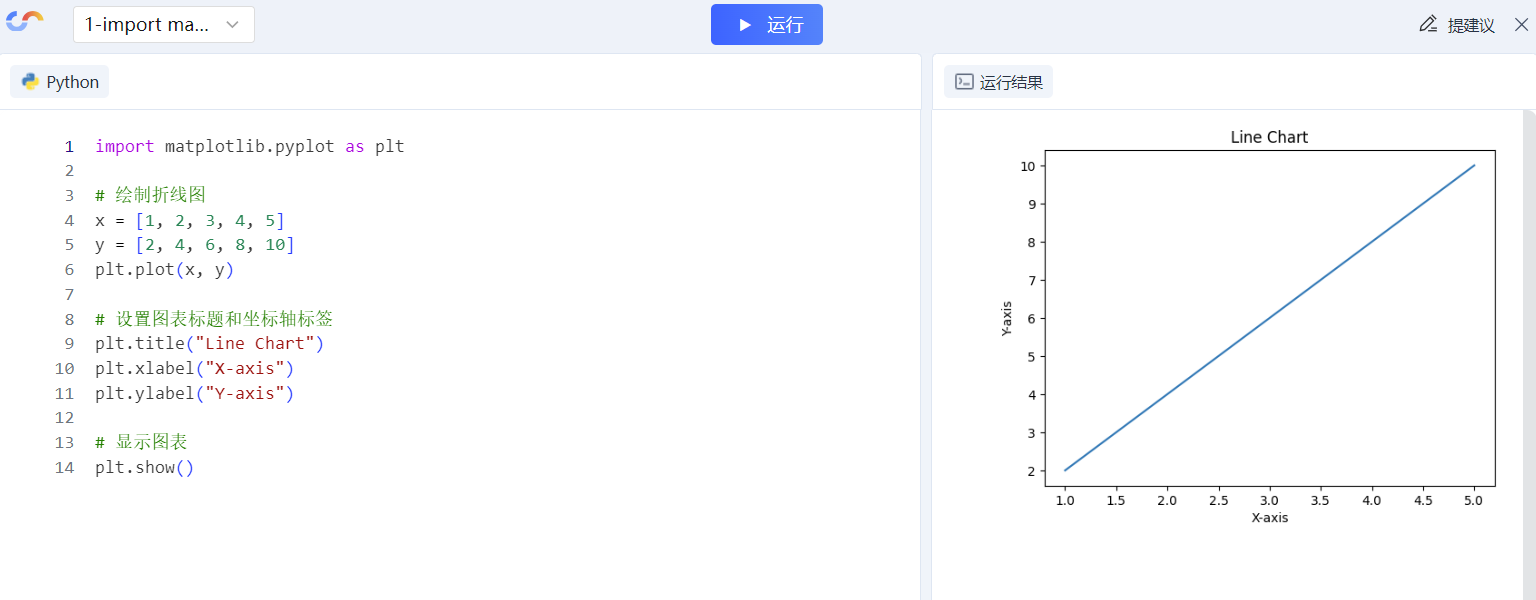

Удачи в конкурсе Python Essay Challenge, станьте первым, кто испытает новую функцию сообщества [Запускать блоки кода онлайн] и выиграйте множество изысканных подарков!

[Техническая посадка травы] Кровавая рвота и отделка позволяют вам необычным образом ощипывать гусиные перья! Не распространяйте информацию! ! !

[Официальное ограниченное по времени мероприятие] Сейчас ноябрь, напишите и получите приз

Прочтите это в одной статье: Учебник для няни по созданию сервера Huanshou Parlu на базе CVM-сервера.

Cloud Native | Что такое CRD (настраиваемые определения ресурсов) в K8s?

Как использовать Cloudflare CDN для настройки узла (CF самостоятельно выбирает IP) Гонконг, Китай/Азия узел/сводка и рекомендации внутреннего высокоскоростного IP-сегмента

Дополнительные правила вознаграждения амбассадоров акции в марте 2023 г.

Можно ли открыть частный сервер Phantom Beast Palu одним щелчком мыши? Супер простой урок для начинающих! (Прилагается метод обновления сервера)

[Играйте с Phantom Beast Palu] Обновите игровой сервер Phantom Beast Pallu одним щелчком мыши

Maotouhu делится: последний доступный внутри страны адрес склада исходного образа Docker 2024 года (обновлено 1 декабря)

Кодирование Base64 в MultipartFile

5 точек расширения SpringBoot, супер практично!

Глубокое понимание сопоставления индексов Elasticsearch.