Сверточная нейронная сеть на основе глубокого обучения

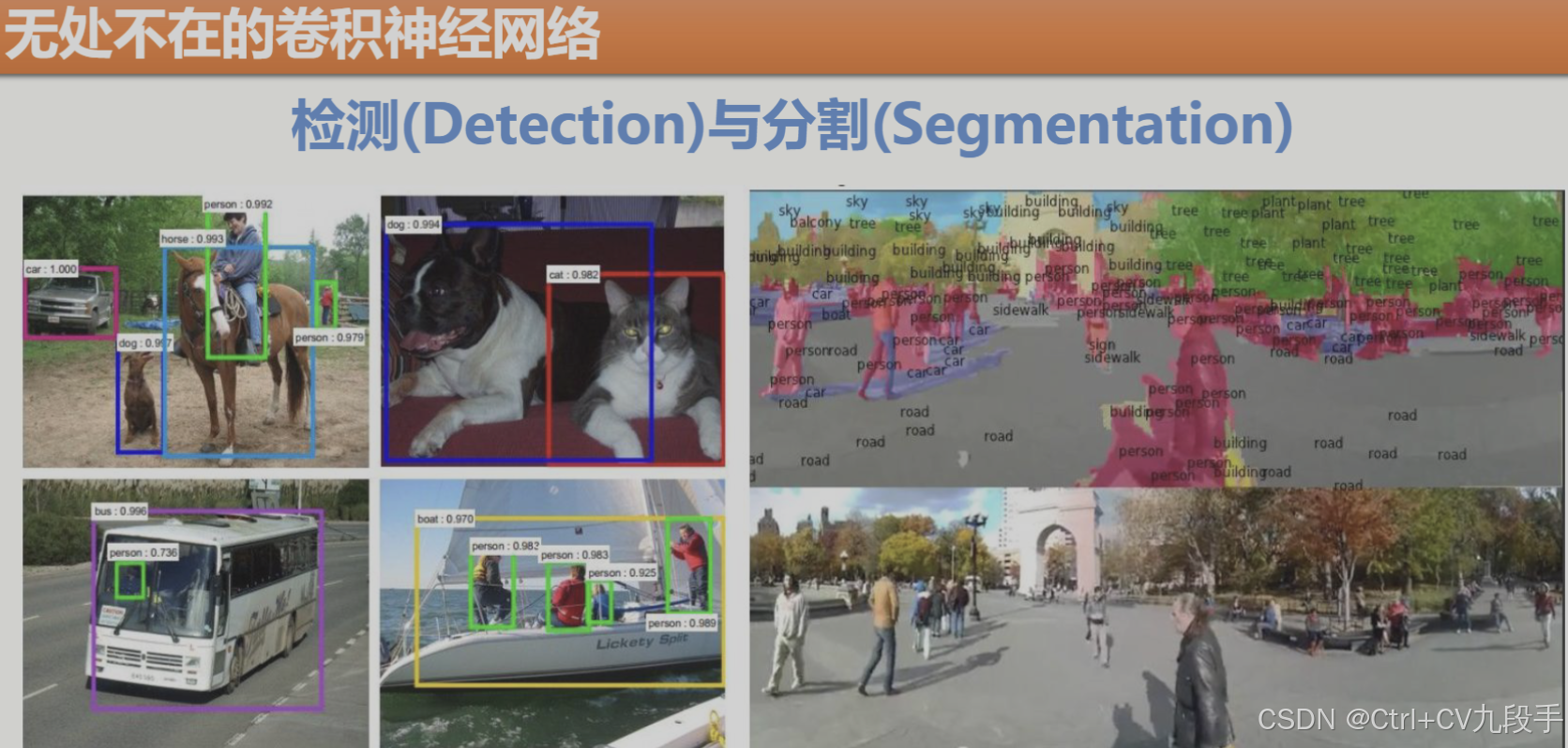

Сверточная нейронная сеть (CNN) — важная модель нейронной сети в области глубокого обучения, особенно в области обработки изображений и компьютерного зрения. Имитируя принцип работы зрительной системы человека, CNN может автоматически извлекать особенности изображений и выполнять такие задачи, как классификация и распознавание. Базовая структура CNN включает входной уровень, уровень свертки, уровень пула, полностью связный уровень и выходной уровень. Среди них сверточный слой отвечает за извлечение локальных особенностей изображения, слой объединения используется для уменьшения размера объекта и предотвращения переобучения, а полностью связный слой используется для окончательной задачи классификации или регрессии. Эти уровни подвергаются нелинейной трансформации с помощью функций активации, таких как ReLU, для повышения выразительности модели. Основная идея CNN состоит в том, чтобы использовать ядро свертки (фильтр) для выполнения операции свертки над входным изображением для создания карты объектов (карты объектов), а затем уменьшить объем вычислений и сохранить важную информацию посредством операции объединения. . Эта структура делает трансляцию CNN инвариантной и надежной при обработке изображений. Классические модели CNN включают LeNet, AlexNet, VGG и ResNet и т. д., которые добились замечательных результатов в различных задачах распознавания изображений. Например, LeNet широко используется для распознавания рукописных цифр, а AlexNet добился выдающихся результатов на конкурсе ImageNet 2012 года. CNN широко используется в области компьютерного зрения, включая классификацию изображений, обнаружение целей, распознавание лиц, сегментацию изображений и т. д. Кроме того, CNN также используется в таких областях, как распознавание речи и обработка естественного языка. Короче говоря, сверточные нейронные сети благодаря своей уникальной структуре и мощным возможностям извлечения признаков хорошо справляются с различными визуальными и невизуальными задачами и стали важным инструментом для современных исследований искусственного интеллекта.

Историческое развитие и ключевые вехи сверточных нейронных сетей (CNN)

Сверточные нейронные сети (CNN) — важная отрасль глубокого обучения. Ее историческое развитие и ключевые вехи можно проследить еще в 1950-х годах, и она прошла через множество важных этапов.

Ранние концепции и предварительные исследования

В 1950-х годах исследования в области искусственного интеллекта только начинались. Исследования этого периода заложили основу для более поздней CNN. В частности, канадские нейробиологи Дэвид Х. Хьюбель и Торстен Визель в 1959 году предложили концепцию «рецептивного поля», которая обеспечила теоретическую основу для последующего развития CNN.

Настоящая сверточная нейронная сеть

1989, Йошуа Bengio、Yann Ле Кун и Джеффри Хинтон и др. разработали первую Настоящую сверточная нейронная сети, для распознавания рукописных цифр. Это современная глубина сверточная нейронная Начало сети. Разработка Лекуна ознаменовала важный прорыв в практическом применении CNN и заложила прочную основу для последующего развития.

Наступление эпохи глубокого обучения

После вступления в 21 век, с улучшением вычислительной мощности и увеличением объема данных, сверточные нейронные сети получили быстрое развитие. Особенно развитию CNN способствовало появление AlexNet в 2012 году. AlexNet добилась отличных результатов в конкурсе ImageNet, доказав мощные возможности глубоких сверточных нейронных сетей в задачах классификации изображений.

Развитие и инновации в последние годы

С 2012 года сверточные нейронные сети достигли самых современных результатов в решении многих задач, став наиболее универсальным из различных методов глубокого обучения. В последние годы конструкция CNN также продолжает развиваться, и появились классические модели, такие как VGGNet и EfficientNet. Эти модели дополнительно оптимизируют производительность CNN за счет модульности, многопутевого распространения, факторизации, сжатия и масштабируемости.

Подвести итог

От ранних концепций до современных приложений, сверточные нейронные сети прошли путь от теоретических исследований до практических приложений и непрерывной оптимизации. Его ключевые вехи включают в себя:

- Концепция «рецептивных полей» была предложена в 1950-х годах.

- 1989ГодLeCunПервый, спроектированный Настоящая сверточная нейронная сеть。

- Успешное применение AlexNet на конкурсе ImageNet в 2012 году.

- В последние годы благодаря постоянной оптимизации и совершенствованию CNN добилась замечательных результатов во многих областях.

Как сравниваются конкретная архитектура и производительность классических моделей CNN, таких как LeNet, AlexNet, VGG и ResNet?

LeNet, AlexNet, VGG и ResNet — классические модели сверточных нейронных сетей (CNN) в области глубокого обучения. Они имеют свои особенности по структуре и производительности. Вот сравнение конкретной архитектуры и производительности этих моделей:

LeNet

LeNet был разработан Яном Лекуном и в основном используется для задач распознавания рукописных цифр. Основная идея состоит в том, чтобы извлекать признаки с помощью таких операций, как сверточные слои, совместное использование параметров и понижающая дискретизация, а также использовать полносвязные нейронные сети для классификации и распознавания. LeNet-5 — самая известная версия, содержащая два сверточных слоя, три слоя максимального пула и два полносвязных слоя, в общей сложности около 200 000 параметров.

AlexNet

AlexNet был предложен Алексом Крижевским и другими в 2012 году для конкурса ImageNet и добился большого успеха. Он содержит 5 сверточных слоев и 3 полностью связанных слоя, всего 8 взвешенных слоев. Возможности AlexNet включают в себя:

- сложность:СравниватьLeNetболее сложный,Существует 60 миллионов параметров и 65 000 нейронов.

- параллельные вычисления:Используйте две частиGPUПроизвести расчеты,Улучшена скорость вычислений.

- функция активации:Каждый сверточный слой и всесоединять Оба слоя используютReLUфункция активации。

- выходной слой:Конечный результат1000сортSoftmaxслой。

VGG

VGG был предложен исследователями из Оксфордского университета и известен своей простой, но мощной структурой. Основная идея состоит в том, чтобы использовать меньшие ядра свертки (3x3) и большие шаги (1x1 или 2x2), а также увеличить глубину сети за счет повторения одних и тех же модулей свертки и объединения несколько раз. Типичная модель VGG-16 содержит 16 сверточных слоев и 3 полносвязных слоя. К основным особенностям VGG относятся:

- простота:所有隐藏слой的激活单元都采用ReLUфункция。

- Иерархия:Можно разделить на несколькоstage,Каждый уровень состоит из двух ядер свертки и пула.

- Количество параметров:随着слой数的增加,Количество параметры также значительно увеличились.

ResNet

ResNet (остаточная сеть) была предложена Хэ Каймингом и другими из Microsoft Research для решения проблемы деградации при глубоком обучении сети. Основная идея состоит в том, чтобы ввести «пропуск соединений» или «остаточные соединения», чтобы входные данные можно было напрямую добавлять к последующим слоям, тем самым помогая плавному протеканию градиента. Типичная версия ResNet — ResNet-50, которая содержит 50 остаточных блоков:

- Улучшения производительности:Вводя остаткисоединять,Значительно улучшена производительность сети.,При этом Количество параметров остается неизменным.

- стратегия обучения:Еще раз о методах обучения и стратегиях масштабирования,Производительность еще больше улучшена.

Сравнение производительности

В целом эти модели хорошо работают в различных сценариях применения и задачах:

- LeNet:Подходит для небольших наборов данных и простых задач.,Например, распознавание рукописных цифр.

- AlexNet:в крупномасштабных наборах данных(нравитьсяImageNet)Отличная производительность на,продвинутыйглубокое Развитие обучения.

- VGG:Хорошо справляется с задачами классификации изображений благодаря своей простой, но мощной структуре.,Но вычислительные затраты выше.

- ResNet:Вводя остаткисоединять解决了深слой网络训练中的退化问题,Он широко используется в различных сложных задачах зрения.

Каковы случаи применения CNN в невизуальных задачах, таких как распознавание речи и обработка естественного языка?

Случаи применения сверточных нейронных сетей (CNN) в невизуальных задачах в основном сосредоточены в областях обработки естественного языка (NLP) и распознавания речи. В обработке естественного языка (NLP) CNN широко используется в таких задачах, как классификация текста, анализ настроений и распознавание именованных объектов. Например, алгоритм классификации китайского текста, основанный на CNN, можно использовать в различных сценариях применения, таких как фильтрация спама и анализ настроений. Кроме того, CNN также может извлекать признаки из текстовых данных, а ее практический эффект в этих задачах демонстрируется на примерах и диаграммах. Что касается распознавания речи, CNN также продемонстрировала свой мощный прикладной потенциал. Например, модель DeepSpeech2, реализованная с помощью PaddlePaddle, может выполнять распознавание китайской речи. Кроме того, модель Conformer сочетает в себе технологию Transformer с усовершенствованной сверткой для достижения значительного повышения точности задач распознавания речи.

Как решить проблему переобучения в процессе обучения сверточной нейронной сети?

Переоснащение — распространенная проблема в процессе обучения сверточных нейронных сетей (CNN). Для решения данной проблемы можно использовать следующие методы:

- увеличение данных:Выполняя серию случайных преобразований обучающих данных,Такие как перевод, вращение, масштабирование и т. д.,увеличить разнообразие обучающих данных,Тем самым уменьшая переобучение. Этот метод может быть достигнут с помощью технологии улучшения изображения.,Например, примените случайное преобразование к существующему изображению.

- регуляризация:在损失функция中添加регуляризацияэлемент,Такие как L1регуляризация и L2регуляризация.,Возможность ограничить размер параметров модели.,Это предотвращает слишком сложную модель и позволяет избежать переобучения.

- Dropout:во время тренировки,Случайным образом выберите часть нейронных узлов, чтобы инактивировать их.,Установить выход некоторых нейронов на 0 с определенной вероятностью,Это позволяет избежать высокой зависимости сети от определенных нейронов.,Предотвратите риск переобучения.

- Ранняя остановка : Заканчивайте тренировку раньше, чем произойдет переобучение. Хотя этот момент трудно понять, теоретически он может эффективно предотвратить переобучение.

- Batch Normalization:通过规范化每一слой的输入,Может ускорить процесс обучения и повысить стабильность модели.

Каковы будущие тенденции развития и потенциальные новые области применения CNN?

Будущие тенденции развития и потенциальные новые области применения сверточных нейронных сетей (CNN) очень широки, в основном сосредоточены на следующих аспектах:

- Оптимизация моделей глубокого обучения:По мере увеличения объема данных и вычислительной мощности,глубокое Обучение Модель станет более сложной. Это требует более эффективных методов оптимизации для улучшения производительности модели.

- Автономное вождение и зрение робота:CNNПриложения в области автономного вождения и робототехники будут и дальше развиваться.,За счет улучшения возможностей обработки изображений,Позвольте этим системам более точно понимать и интерпретировать окружающую среду.

- Сложность сетевой структуры:будущееCNNСеть может еще больше увеличить глубину сети.,Чтобы улучшить производительность Model. Это означает, что структура сети станет более сложной.,Но это также может потребовать более высоких вычислительных затрат.

- Интеграция с Трансформером:CNNиTransformerГлубокая интеграция компьютерного зрения открыла новые возможности и проблемы в области компьютерного зрения.。Эта комбинация создает более мощный、гибкий Модельдля обработки сложных данных изображения。будущее,Ожидается появление инновационных приложений на базе CNN+Transformer.

- Поле суперразрешения:в супер разрешении(SR)поле,Трансформатор из-за меньшего количества флопов и количества параметров.,Отлично справляется с зависимостью на больших расстояниях и адаптивными корректировками.,за пределами традиционных CNN. Эта технология термоядерного синтеза становится горячей точкой исследований.

- Приложения в финансовой сфере:CNN在金融поле也有重要应用,Особенно в таких аспектах, как интеллектуальный анализ данных, прогнозный анализ и контроль рисков. С ростом приложений больших данных,Спрос финансовых учреждений на эти технологии также растет.

- Расширение в других областях:除了上述поле外,CNN также широко используется в других областях искусственного интеллекта, таких как распознавание речи и обработка естественного языка.,И эти приложения постоянно расширяются.

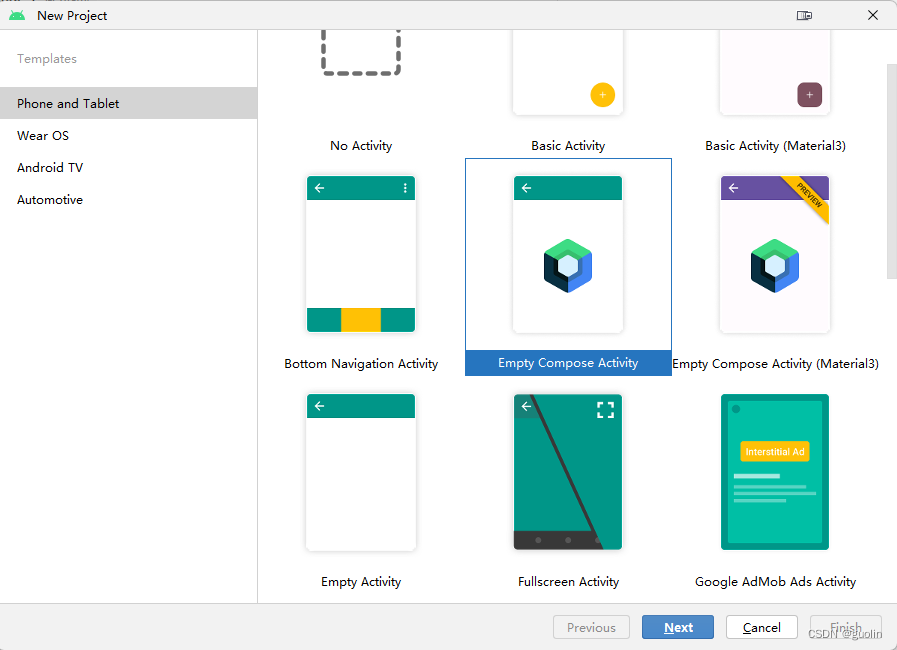

Учебное пособие по Jetpack Compose для начинающих, базовые элементы управления и макет

Код js веб-страницы, фон частицы, код спецэффектов

【новый! Суперподробное】Полное руководство по свойствам компонентов Figma.

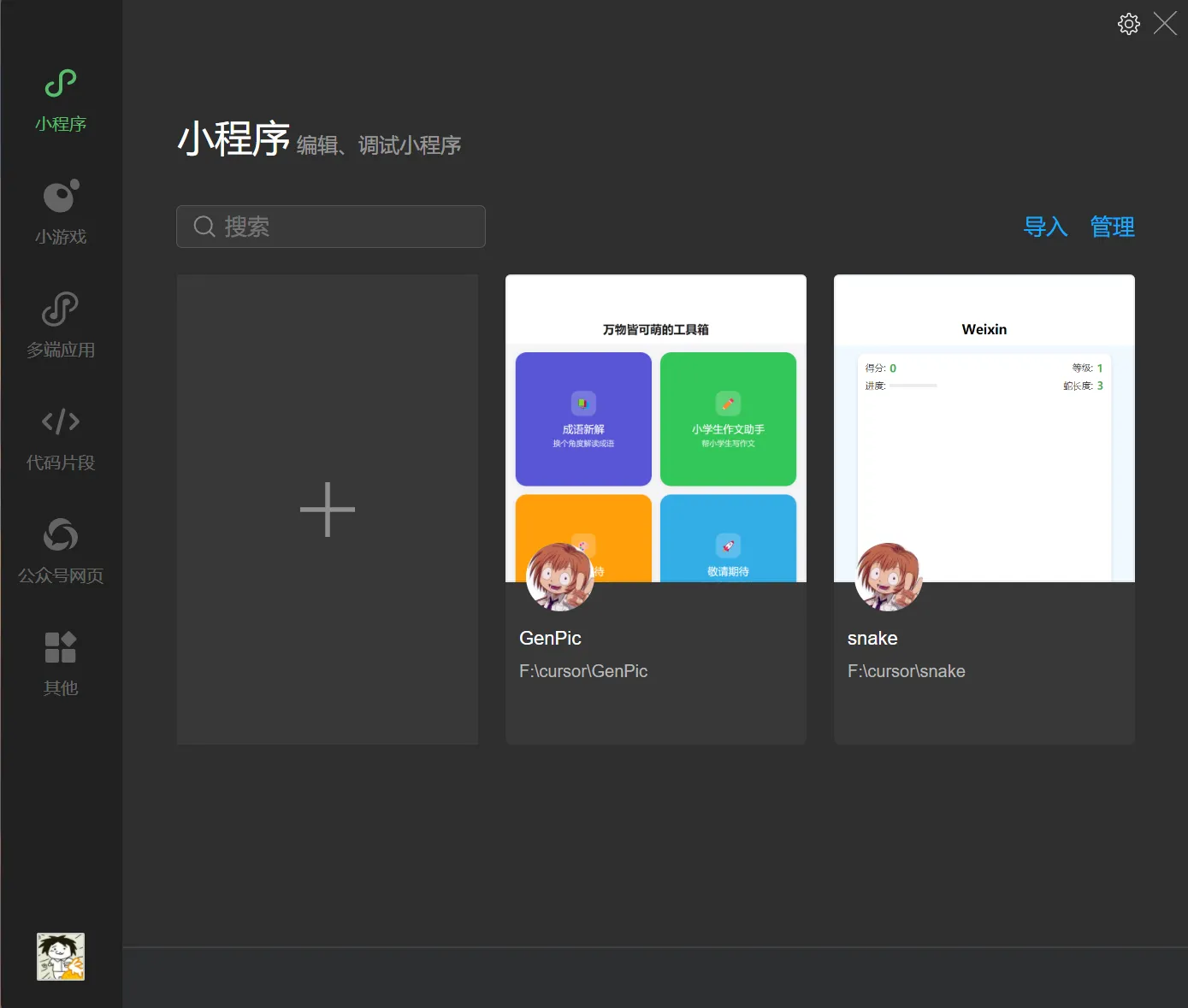

🎉Обязательно к прочтению новичкам: полное руководство по написанию мини-программ WeChat с использованием программного обеспечения Cursor.

[Забавный проект Docker] VoceChat — еще одно приложение для мгновенного чата (IM)! Может быть встроен в любую веб-страницу!

Как реализовать переход по странице в HTML (html переходит на указанную страницу)

Как решить проблему зависания и низкой скорости при установке зависимостей с помощью npm. Существуют ли доступные источники npm, которые могут решить эту проблему?

Серия From Zero to Fun: Uni-App WeChat Payment Practice WeChat авторизует вход в систему и украшает страницу заказа, создает интерфейс заказа и инициирует запрос заказа

Серия uni-app: uni.navigateЧтобы передать скачок значения

Апплет WeChat настраивает верхнюю панель навигации и адаптируется к различным моделям.

JS-время конвертации

Обеспечьте бесперебойную работу ChromeDriver 125: советы по решению проблемы chromedriver.exe не найдены

Поле комментария, щелчок мышью, специальные эффекты, js-код

Объект массива перемещения объекта JS

Как открыть разрешение на позиционирование апплета WeChat_Как использовать WeChat для определения местонахождения друзей

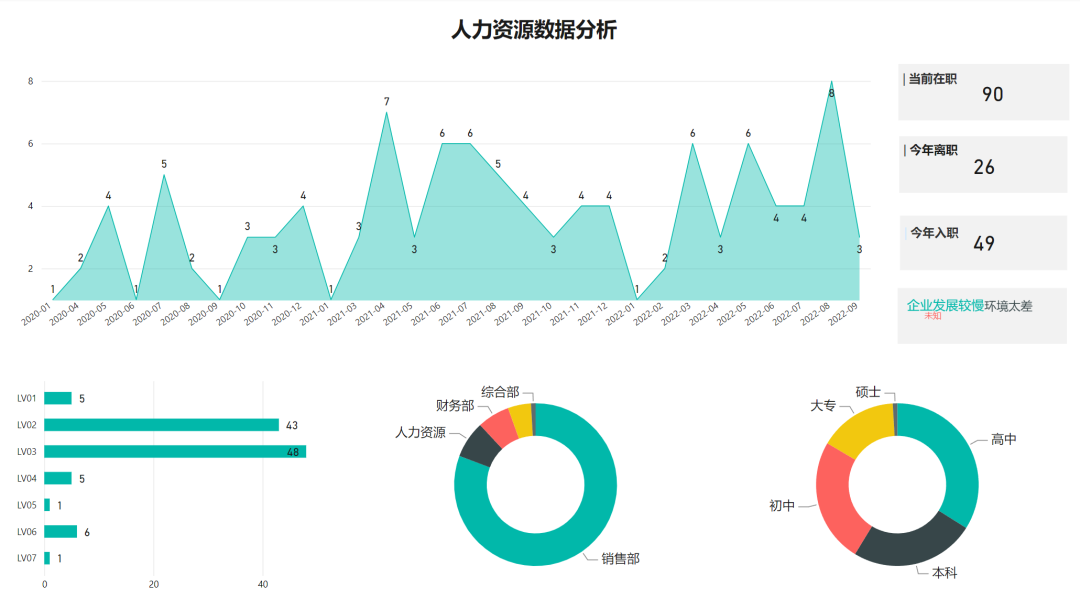

Я даю вам два набора из 18 простых в использовании фонов холста Power BI, так что вам больше не придется возиться с цветами!

Получить текущее время в js_Как динамически отображать дату и время в js

Вам необходимо изучить сочетания клавиш vsCode для форматирования и организации кода, чтобы вам больше не приходилось настраивать формат вручную.

У ChatGPT большое обновление. Всего за 45 минут пресс-конференция показывает, что OpenAI сделал еще один шаг вперед.

Copilot облачной разработки — упрощение разработки

Микросборка xChatGPT с низким кодом, создание апплета чат-бота с искусственным интеллектом за пять шагов

CUDA Out of Memory: идеальное решение проблемы нехватки памяти CUDA

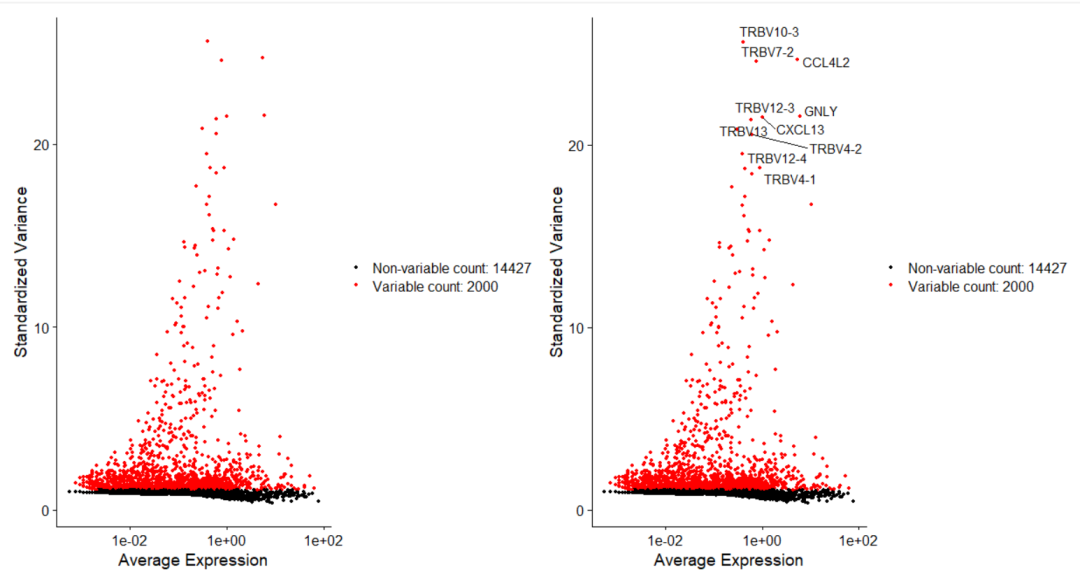

Анализ кластеризации отдельных ячеек, который должен освоить каждый&MarkerгенетическийВизуализация

vLLM: мощный инструмент для ускорения вывода ИИ

CodeGeeX: мощный инструмент генерации кода искусственного интеллекта, который можно использовать бесплатно в дополнение к второму пилоту.

Машинное обучение Реальный бой LightGBM + настройка параметров случайного поиска: точность 96,67%

Бесшовная интеграция, мгновенный интеллект [1]: платформа больших моделей Dify-LLM, интеграция без кодирования и встраивание в сторонние системы, более 42 тысяч звезд, чтобы стать свидетелями эксклюзивных интеллектуальных решений.

LM Studio для создания локальных больших моделей

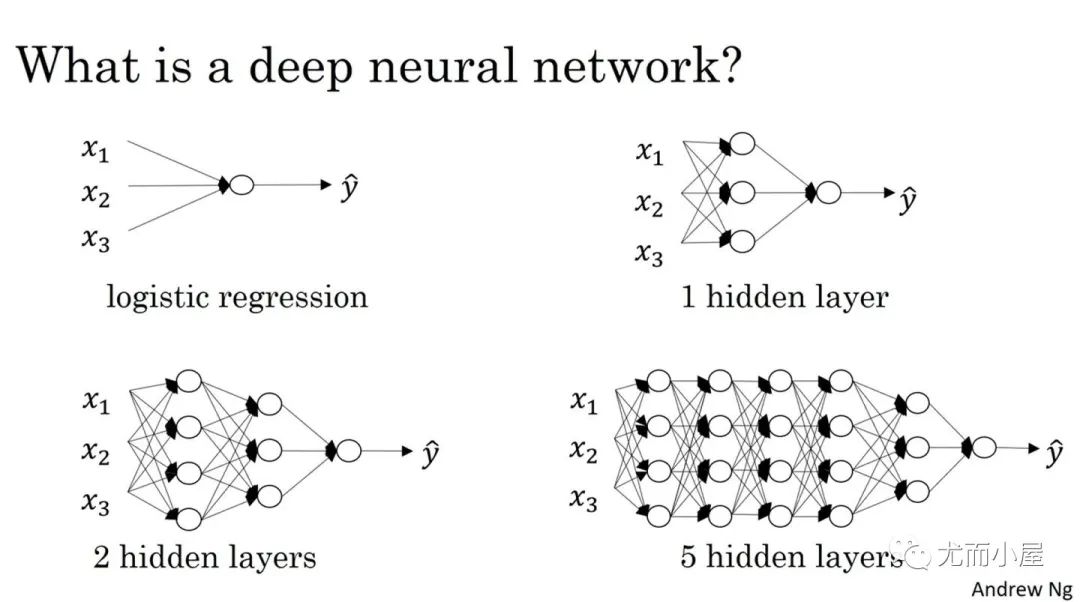

Как определить количество слоев и нейронов скрытых слоев нейронной сети?