Расширенное руководство по NumPy — ускорение графического процессора

Расширенное руководство по Python NumPy: ускорение графического процессора

Использование ускорения графического процессора — распространенный подход к оптимизации при обработке больших наборов данных или выполнении сложных вычислений. NumPy предоставляет инструменты и методы для простого выполнения вычислений на графических процессорах. В этом блоге мы подробно углубимся в ускорение графического процессора в NumPy и продемонстрируем, как применять эти методы на практических примерах.

1. Использование библиотеки CuPy

CuPy — это NumPy-совместимая библиотека массивов графических процессоров, которая позволяет выполнять операции в стиле NumPy на графическом процессоре. Сначала вам нужно установить CuPy:

pip install cupyЗатем вы можете использовать CuPy вместо массивов NumPy и выполнять вычисления на графическом процессоре.

import cupy as cp

import numpy as np

# создавать NumPy множество

arr_np = np.random.rand(1000000)

# Воля NumPy множество Преобразовать в CuPy множество

arr_gpu = cp.asarray(arr_np)

# существовать GPU выполнить навычислить

result_gpu = cp.sin(arr_gpu)

# Воля получается из GPU Преобразовать обратно в NumPy множество

result_np = cp.asnumpy(result_gpu)

# Проверьте согласованность результатов

assert np.allclose(np.sin(arr_np), result_np)2. Используйте Numba для ускорения вычислений на графическом процессоре.

Numba — это JIT-компилятор (точно в срок), который ускоряет выполнение кода Python. Используя декоратор cuda.jit Numba, обычные функции Python можно скомпилировать в код, выполняющийся на графическом процессоре.

from numba import cuda

# использовать Numba ускоряться GPU вычислить

@cuda.jit

def numba_gpu_function(arr_in, arr_out):

i = cuda.grid(1)

if i < arr_in.size:

arr_out[i] = np.sin(arr_in[i])

# Подготовьте данные

arr_np = np.random.rand(1000000)

arr_gpu = cp.asarray(arr_np)

result_gpu_numba = cp.empty_like(arr_gpu)

# существовать GPU выполнить навычислить

numba_gpu_function[32, 32](arr_gpu, result_gpu_numba)

# Воля получается из GPU Преобразовать обратно в NumPy множество

result_np_numba = cp.asnumpy(result_gpu_numba)

# Проверьте согласованность результатов

assert np.allclose(np.sin(arr_np), result_np_numba)3. Используйте PyTorch или TensorFlow.

В дополнение к CuPy и Numba вы также можете использовать платформу глубокого обучения PyTorch или TensorFlow, чтобы воспользоваться преимуществами вычислений на графическом процессоре. Эти две платформы предоставляют тензорные объекты и поддерживают ускорение графического процессора.

import torch

# создавать PyTorch Тензор

arr_torch = torch.rand(1000000)

# Воля Тензорпереехать в GPU начальство

arr_torch_gpu = arr_torch.cuda()

# существовать GPU выполнить навычислить

result_torch_gpu = torch.sin(arr_torch_gpu)

# Воля получается из GPU Преобразовать обратно в NumPy множество

result_np_torch = result_torch_gpu.cpu().numpy()

# Проверьте согласованность результатов

assert np.allclose(np.sin(arr_torch.numpy()), result_np_torch)4. Использование PyCUDA

PyCUDA — это библиотека Python, которая позволяет выполнять код CUDA (унифицированная архитектура вычислительных устройств) на графических процессорах. Сначала вам необходимо установить CUDA Toolkit и установить PyCUDA:

pip install pycudaЗатем функции ядра CUDA можно записать и выполнить на графическом процессоре.

импортировать pycuda.driver как cuda

импортировать pycuda.autoinit

из pycuda.compiler импортировать SourceModule

# Функция CUDA

мод = SourceModule("""

__global__ void gpu_function(float *arr_in, float *arr_out) {

int i = threadIdx.x + blockIdx.x * blockDim.x;

arr_out[i] = sin(arr_in[i]);

}

""")

# Подготовьте данные

arr_np = np.random.rand(1000000).astype(np.float32)

arr_gpu = cuda.mem_alloc(arr_np.nbytes)

result_gpu_pycuda = cuda.mem_alloc(arr_np.nbytes)

# Воля передача данных на GPU

cuda.memcpy_htod(arr_gpu, arr_np)

# осуществлять CUDA 核функция

func = mod.get_function("gpu_function")

func(arr_gpu, result_gpu_pycuda, block=(32, 1, 1), grid=(arr_np.size // 32, 1))

# Воля получается из GPU Преобразовать обратно в NumPy множество

result_np_pycuda = np.empty_like(arr_np)

cuda.memcpy_dtoh(result_np_pycuda, result_gpu_pycuda)

# Проверьте согласованность результатов

assert np.allclose(np.sin(arr_np), result_np_pycuda)5. Резюме

Комбинируя вышеуказанные методы, вы можете реализовать ускорение графического процессора в NumPy и повысить эффективность выполнения вашего кода. Выбор правильных инструментов и методов зависит от конкретного сценария применения и вычислительных задач. Я надеюсь, что этот блог поможет вам лучше понять и использовать технологию ускорения графического процессора в NumPy.

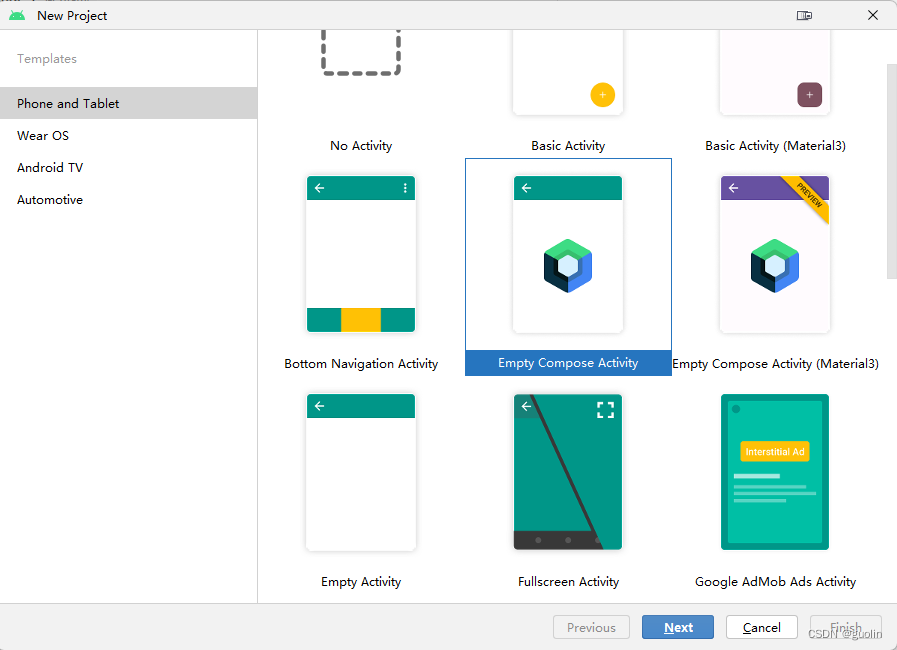

Учебное пособие по Jetpack Compose для начинающих, базовые элементы управления и макет

Код js веб-страницы, фон частицы, код спецэффектов

【новый! Суперподробное】Полное руководство по свойствам компонентов Figma.

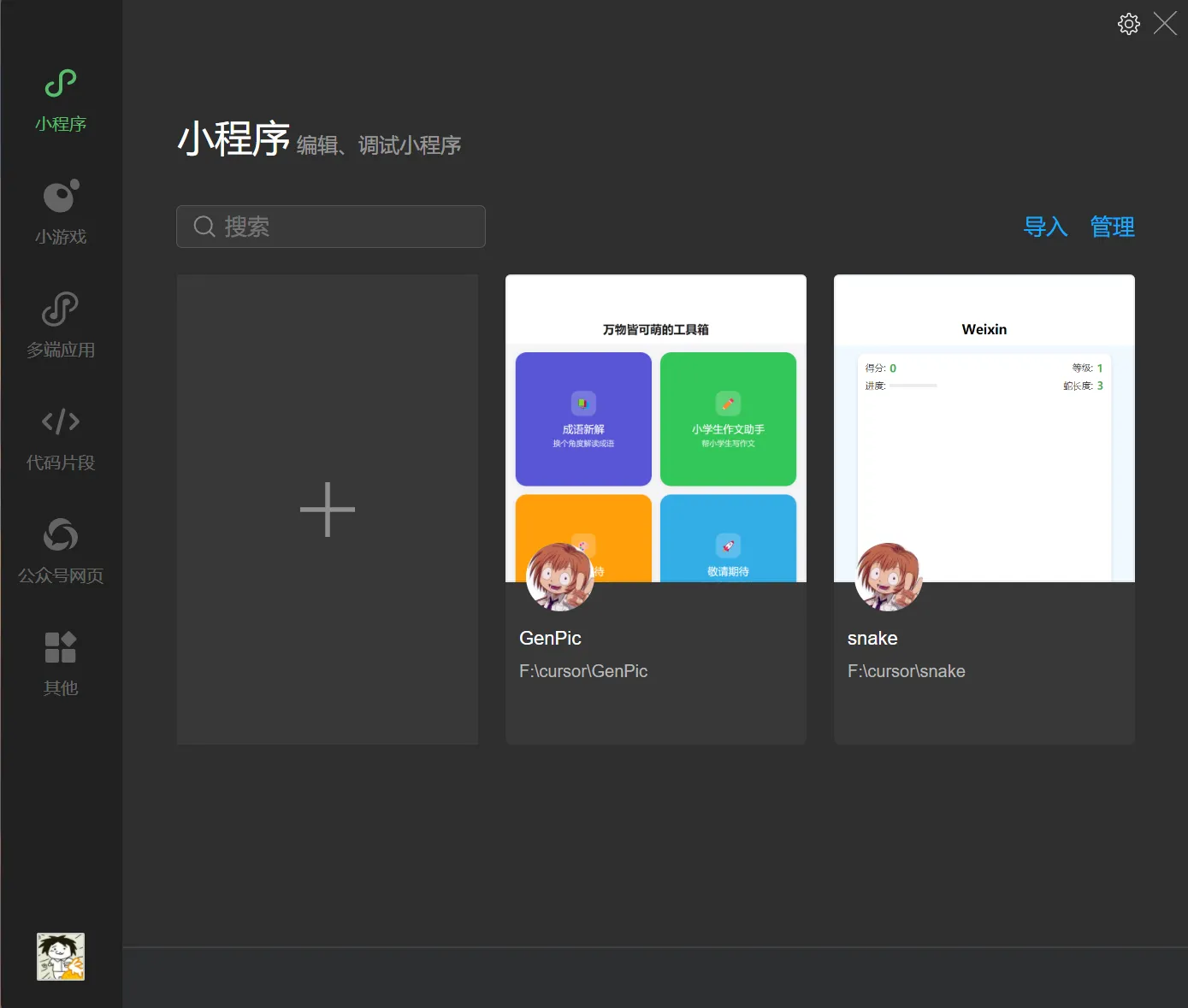

🎉Обязательно к прочтению новичкам: полное руководство по написанию мини-программ WeChat с использованием программного обеспечения Cursor.

[Забавный проект Docker] VoceChat — еще одно приложение для мгновенного чата (IM)! Может быть встроен в любую веб-страницу!

Как реализовать переход по странице в HTML (html переходит на указанную страницу)

Как решить проблему зависания и низкой скорости при установке зависимостей с помощью npm. Существуют ли доступные источники npm, которые могут решить эту проблему?

Серия From Zero to Fun: Uni-App WeChat Payment Practice WeChat авторизует вход в систему и украшает страницу заказа, создает интерфейс заказа и инициирует запрос заказа

Серия uni-app: uni.navigateЧтобы передать скачок значения

Апплет WeChat настраивает верхнюю панель навигации и адаптируется к различным моделям.

JS-время конвертации

Обеспечьте бесперебойную работу ChromeDriver 125: советы по решению проблемы chromedriver.exe не найдены

Поле комментария, щелчок мышью, специальные эффекты, js-код

Объект массива перемещения объекта JS

Как открыть разрешение на позиционирование апплета WeChat_Как использовать WeChat для определения местонахождения друзей

Я даю вам два набора из 18 простых в использовании фонов холста Power BI, так что вам больше не придется возиться с цветами!

Получить текущее время в js_Как динамически отображать дату и время в js

Вам необходимо изучить сочетания клавиш vsCode для форматирования и организации кода, чтобы вам больше не приходилось настраивать формат вручную.

У ChatGPT большое обновление. Всего за 45 минут пресс-конференция показывает, что OpenAI сделал еще один шаг вперед.

Copilot облачной разработки — упрощение разработки

Микросборка xChatGPT с низким кодом, создание апплета чат-бота с искусственным интеллектом за пять шагов

CUDA Out of Memory: идеальное решение проблемы нехватки памяти CUDA

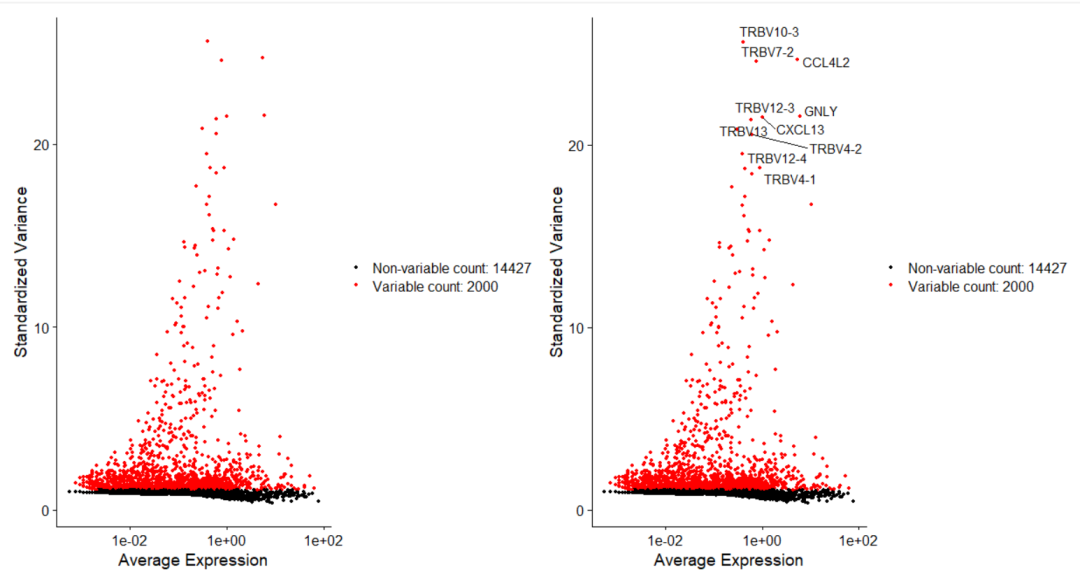

Анализ кластеризации отдельных ячеек, который должен освоить каждый&MarkerгенетическийВизуализация

vLLM: мощный инструмент для ускорения вывода ИИ

CodeGeeX: мощный инструмент генерации кода искусственного интеллекта, который можно использовать бесплатно в дополнение к второму пилоту.

Машинное обучение Реальный бой LightGBM + настройка параметров случайного поиска: точность 96,67%

Бесшовная интеграция, мгновенный интеллект [1]: платформа больших моделей Dify-LLM, интеграция без кодирования и встраивание в сторонние системы, более 42 тысяч звезд, чтобы стать свидетелями эксклюзивных интеллектуальных решений.

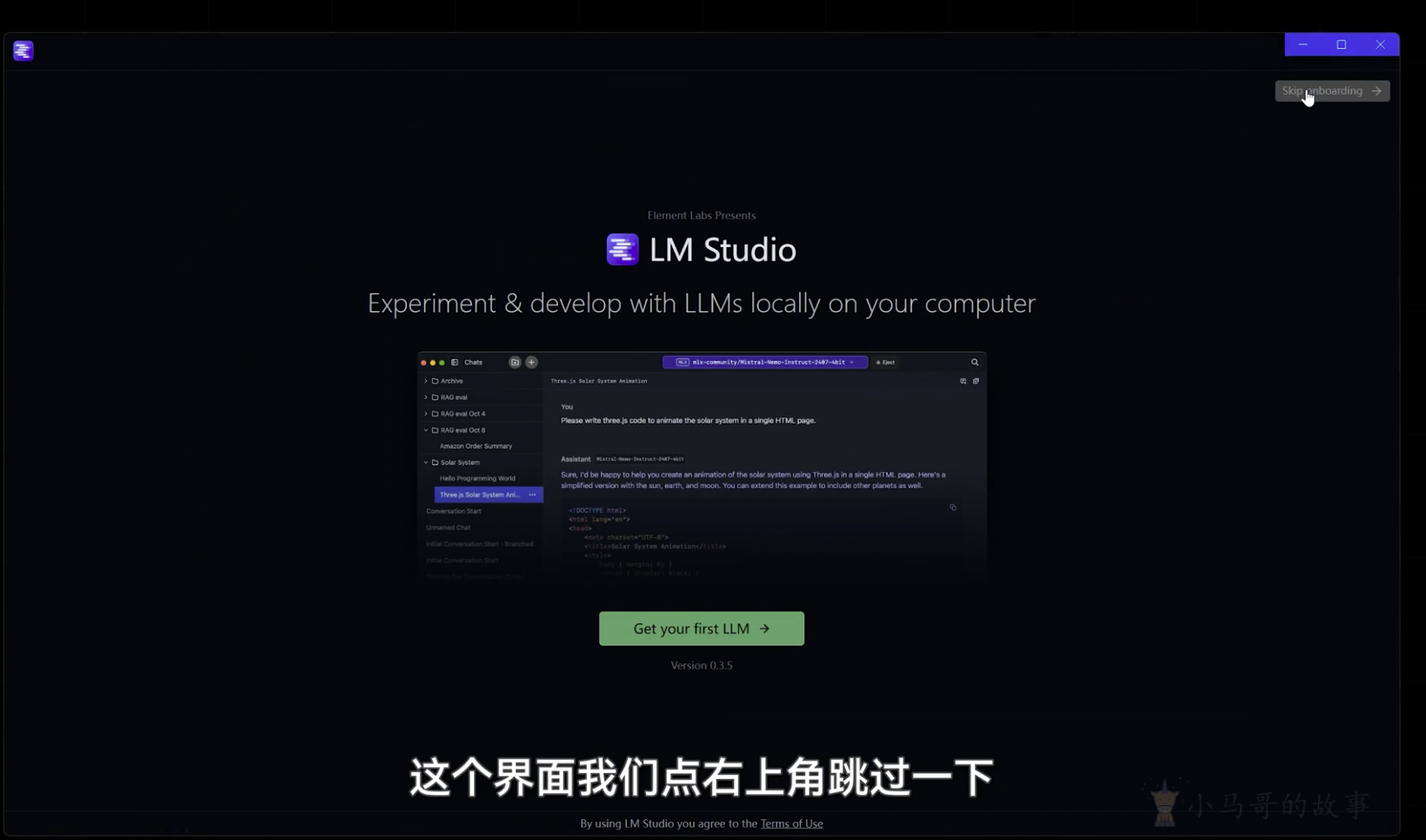

LM Studio для создания локальных больших моделей

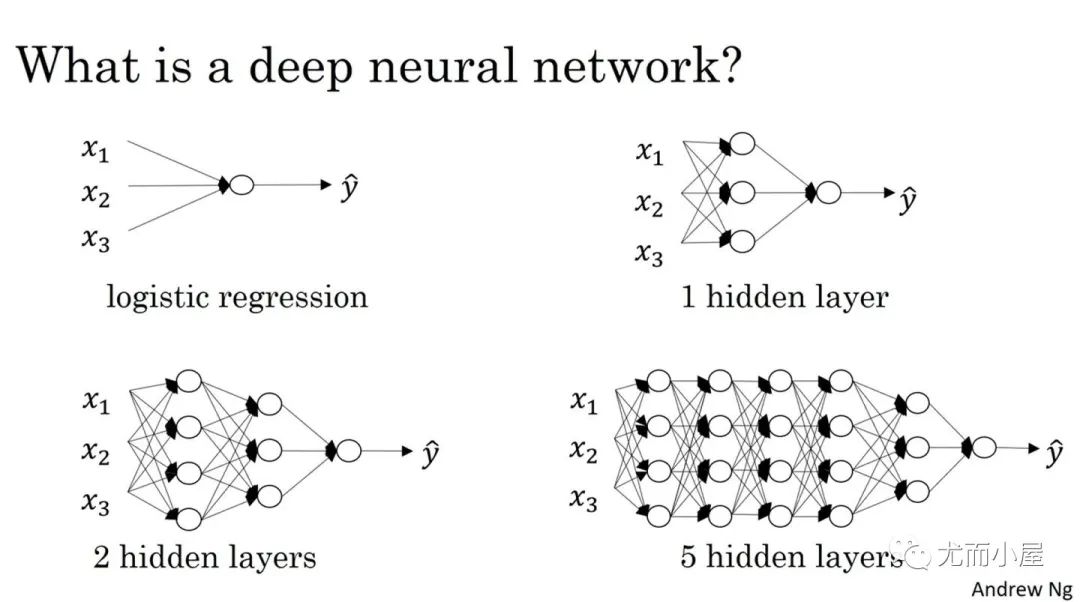

Как определить количество слоев и нейронов скрытых слоев нейронной сети?