Общая архитектура и техническая реализация витрины данных о рисках

введение

В современную эпоху больших данных витрины данных о рисках, как одна из основных инфраструктур финансовых учреждений, играют жизненно важную роль. Он не только обеспечивает всестороннюю и точную поддержку данных о рисках для банков, страховых и других финансовых учреждений, но также помогает этим учреждениям добиться усовершенствованного и интеллектуального управления рисками. В этой статье будет глубоко изучена общая архитектура витрины данных о рисках, основанная на проекте архитектуры больших данных Lambda, а также подробно представлены ее основные принципы реализации и методы реализации.

1. Обзор витрины данных о рисках

Витрина данных о рисках — это система центра обработки данных, предназначенная для хранения, обработки и анализа данных о рисках. Он обеспечивает высококачественную поддержку данных о рисках для финансовых учреждений путем интеграции, очистки, преобразования и загрузки огромных внутренних и внешних данных. Создание витрины данных о рисках направлено на улучшение возможностей финансовых учреждений по управлению рисками, снижение затрат на риск и повышение конкурентоспособности рынка.

2. Проектирование лямбда-архитектуры

Лямбда-архитектура — это образец архитектуры больших данных для обработки крупномасштабных потоков данных. Он состоит из трех частей: уровня пакетной обработки, уровня ускорения и уровня обслуживания. В сценарии применения витрины данных о рисках архитектура Lambda вполне может удовлетворить потребности автономной обработки данных и обработки данных в реальном времени.

2.1 Уровень пакетной обработки

Уровень пакетной обработки в основном отвечает за обработку автономных данных. В витринах данных о рисках автономные данные обычно включают исторические данные о транзакциях, основную информацию о клиентах и т. д. Уровень пакетной обработки использует Hadoop в качестве вычислительного механизма и использует свои мощные возможности параллельной обработки для эффективного хранения и обработки огромных объемов автономных данных.

2.1.1 Принцип реализации Hadoop

Hadoop — это платформа распределенных вычислений с открытым исходным кодом, которая реализует распределенное хранение данных через распределенную файловую систему (HDFS) и распределенную обработку данных с помощью модели программирования MapReduce. На уровне пакетной обработки витрины данных о рисках Hadoop реализует обработку данных с помощью следующих шагов:

- ввод данных: загрузите исходные данные в HDFS.

- Задания MapReduce: написание программ MapReduce,Обработка данных в HDFS. Этап карты разбивает входные данные на небольшие части.,И каждый небольшой блок обрабатывается независимо; этап «Сокращение» суммирует и выводит результаты этапа «Карта».

- вывод данных: сохраните обработанные данные в HDFS.,Для использования последующими слоями.

2.1.2 Объяснение демонстрации Java

Ниже приведена простая демонстрация Java, показывающая, как использовать Hadoop для обработки данных:

javaкопировать код

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class WordCount {

public static class TokenizerMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String[] tokens = value.toString().split("\\s+");

for (String token : tokens) {

word.set(token);

context.write(word, one);

}

}

}

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}В этой демонстрации реализована простая функция подсчета слов, которая подсчитывает слова во входном тексте и выводит их через платформу MapReduce Hadoop.

2.2 Уровень ускорения

Уровень ускорения в основном отвечает за обработку данных в реальном времени. В витринах данных о рисках данные в реальном времени обычно включают в себя данные мониторинга транзакций в реальном времени, информацию о предупреждениях о рисках и т. д. Уровень ускорения использует Spark в качестве вычислительного механизма, используя свои возможности быстрой обработки данных и богатые библиотеки обработки данных для эффективной обработки и анализа данных в реальном времени.

2.2.1 Принцип реализации Spark

Spark — это распределенная вычислительная система с открытым исходным кодом, которая обеспечивает несколько режимов вычислений, таких как вычисления в памяти, потоковая обработка и графовые вычисления. На уровне ускорения витрины данных о рисках Spark реализует обработку данных с помощью следующих шагов:

- Ввод данных: считывание данных в реальном времени из очередей сообщений, таких как Kafka.

- обработка данных: используйте Spark SQL, Spark Streaming и другие компоненты для обработки и анализа данных в реальном времени.

- вывод данных: сохраните обработанные данные в памяти или HDFS.,Для использования последующими слоями.

2.2.2 Объяснение демонстрации Python

Ниже приведена простая демонстрация Python, показывающая, как использовать Spark для обработки данных в реальном времени:

pythonкопироватькод

from pyspark.sql import SparkSession

from pyspark.streaming import StreamingContext

from pyspark.streaming.kafka import KafkaUtils

# Инициализировать SparkSession

spark = SparkSession.builder.appName("RealTimeDataProcessing").getOrCreate()

# Создать потоковыйконтекст

sc = spark.sparkContext

ssc = StreamingContext(sc, 10) # Интервал пакетной обработки составляет 10 секунд.

# Чтение данных из Kafka в реальном времени

kafkaStream = KafkaUtils.createDirectStream(

ssc,

["topic1"],

{"bootstrap.servers": "kafka-server:9092"}

)

# Обработка данных в реальном времени

lines = kafkaStream.map(lambda x: x[1].decode('utf-8'))

words = lines.flatMap(lambda line: line.split(" "))

wordCounts = words.map(lambda word: (word, 1)).reduceByKey(lambda a, b: a + b)

# Результаты обработки вывода

wordCounts.pprint()

# Начать потоковую передачу контекста

ssc.start()

ssc.awaitTermination()В этой демонстрации реализована простая функция подсчета слов в реальном времени, считывает данные в реальном времени из Kafka через Spark Streaming, обрабатывает и анализирует данные и, наконец, выводит результаты на консоль.

2.3 Сервисный уровень

Уровень обслуживания в основном отвечает за предоставление услуг запроса и анализа данных. В витрине данных о рисках сервисный уровень хранит структурированные данные через базы данных NoSQL, такие как HBase, и предоставляет эффективные интерфейсы запросов и анализа. В то же время уровень обслуживания также создает представления с возможностью запроса с помощью инструментов хранилища данных, таких как Hive, чтобы облегчить пользователям запрос и анализ данных.

2.3.1 Принцип реализации HBase

HBase — это распределенная база данных NoSQL с открытым исходным кодом, реализованная на основе модели Google Bigtable. На уровне обслуживания витрины данных о рисках HBase реализует хранение и запрос данных, выполнив следующие шаги:

- запись данных: запись обработанных данных в таблицу HBase через API HBase.

- Запрос данных: запрос и анализ сохраненных данных через HBase API.

2.3.2 Hive создает представления с возможностью запроса

Hive — это инструмент хранилища данных, который предоставляет SQL-подобный язык запросов HiveQL, позволяющий пользователям запрашивать и анализировать данные, хранящиеся в HDFS. На уровне обслуживания витрины данных о рисках с помощью Hive можно создавать запрашиваемые представления, чтобы облегчить пользователям запрос и анализ данных.

sqlкопироватькод

CREATE VIEW risk_data_view AS

SELECT * FROM risk_data_table;этотSQLоператор создает файл с именемrisk_data_viewвид,это основано наrisk_data_tableповерхность。Пользователи могут запросить это представление, чтобы получить информацию о рисках.данные。

3. Развертывание в режиме кластера

Весь проект витрины данных о рисках развертывается в кластерном режиме, включая различные типы серверов, такие как серверы приложений, серверы промежуточного программного обеспечения, серверы вычислительных механизмов, серверы баз данных и серверы передачи файлов. Этот метод развертывания позволяет в полной мере использовать возможности параллельной обработки и отказоустойчивости кластера, а также повысить надежность и производительность системы.

3.1 Конфигурация сервера

- Приложение Служить устройство: 3 шт.,Отвечает за развертывание приложения базара данных о рисках Служить.

- Промежуточное программное обеспечение Служить: 5 модулей, отвечающих за развертывание промежуточного программного обеспечения Служить, такого как очереди сообщений и кеши.

- Вычислительный движок Служить: 3 подразделения, отвечающие за развертывание Hadoop, Spark и других вычислительных движков.

- данные Библиотека Служитьустройство:9башня,Ответственный за развертываниеHBase、Hiveждатьданные Библиотека Служить。

- Устройство передачи файлов: 2 шт.,Отвечает за загрузку и скачивание данных.

3.2 Управление кластером

Управление кластером — ключ к обеспечению стабильной работы системы. В проекте витрины данных о рисках для управления кластером и его планирования можно использовать такие инструменты управления кластером, как YARN и Mesos. Эти инструменты могут автоматически распределять ресурсы, отслеживать состояние кластера, обрабатывать сбои и т. д., а также повышать надежность и производительность системы.

4. Процесс обслуживания бизнес-сценария

В процессе обслуживания всего бизнес-сценария автономные данные обрабатываются слоем пакетной обработки, а данные в реальном времени обрабатываются уровнем ускорения. Результаты обработки данных двух уровней унифицируются, консолидируются и сохраняются в структурированном виде на уровне обслуживания в соответствии с размерностями продукта, категориями данных и другими характеристиками. Пользователи могут легко запрашивать и анализировать данные о рисках через интерфейс запросов и анализа, предоставляемый уровнем обслуживания.

4.1 Процесс обработки данных в автономном режиме

- загрузка данных: загрузите исходные автономные данные в HDFS.

- обработка данных: обработка данных в HDFS с помощью платформы Hadoop MapReduce.

- Хранение данных: храните обработанные данные в HDFS.

- синхронизация данных: синхронизируйте обработанные данные с HBase.

4.2 Процесс обработки данных в реальном времени

- Чтение данных: чтение данных в реальном времени из очередей сообщений, таких как Kafka.

- обработка данных: обработка и анализ данных в реальном времени с помощью Spark Streaming.

- Хранение данных: храните обработанные данные в памяти или HDFS.

- синхронизация данных: синхронизируйте обработанные данные с HBase.

4.3 Запрос и анализ данных

Пользователи могут запрашивать и анализировать данные о рисках, хранящиеся в HBase, через интерфейс запросов и анализа, предоставляемый уровнем обслуживания. Уровень обслуживания создает представления с возможностью запроса с помощью таких инструментов, как Hive, для облегчения запроса и анализа данных пользователей. В то же время уровень обслуживания также предоставляет богатые функции анализа данных, такие как статистический анализ, анализ тенденций и т. д., чтобы помочь пользователям лучше понимать и использовать данные о рисках.

5. Резюме

В этой статье подробно обсуждается общая архитектура витрины данных о рисках, основанная на проектировании архитектуры больших данных Lambda и лежащих в ее основе принципах реализации. Благодаря совместной работе уровня пакетной обработки, уровня ускорения и уровня обслуживания витрина данных о рисках может эффективно обрабатывать и анализировать огромные объемы данных о рисках, предоставляя финансовым учреждениям комплексную и точную поддержку данных о рисках. В то же время в этой статье также описывается процесс развертывания в режиме кластера, процесс обслуживания бизнес-сценариев и т. д., предоставляя читателям комплексное решение для витрины данных о рисках.

Углубленный анализ переполнения памяти CUDA: OutOfMemoryError: CUDA не хватает памяти. Попыталась выделить 3,21 Ги Б (GPU 0; всего 8,00 Ги Б).

[Решено] ошибка установки conda. Среда решения: не удалось выполнить первоначальное зависание. Повторная попытка с помощью файла (графическое руководство).

Прочитайте нейросетевую модель Трансформера в одной статье

.ART Теплые зимние предложения уже открыты

Сравнительная таблица описания кодов ошибок Amap

Уведомление о последних правилах Points Mall в декабре 2022 года.

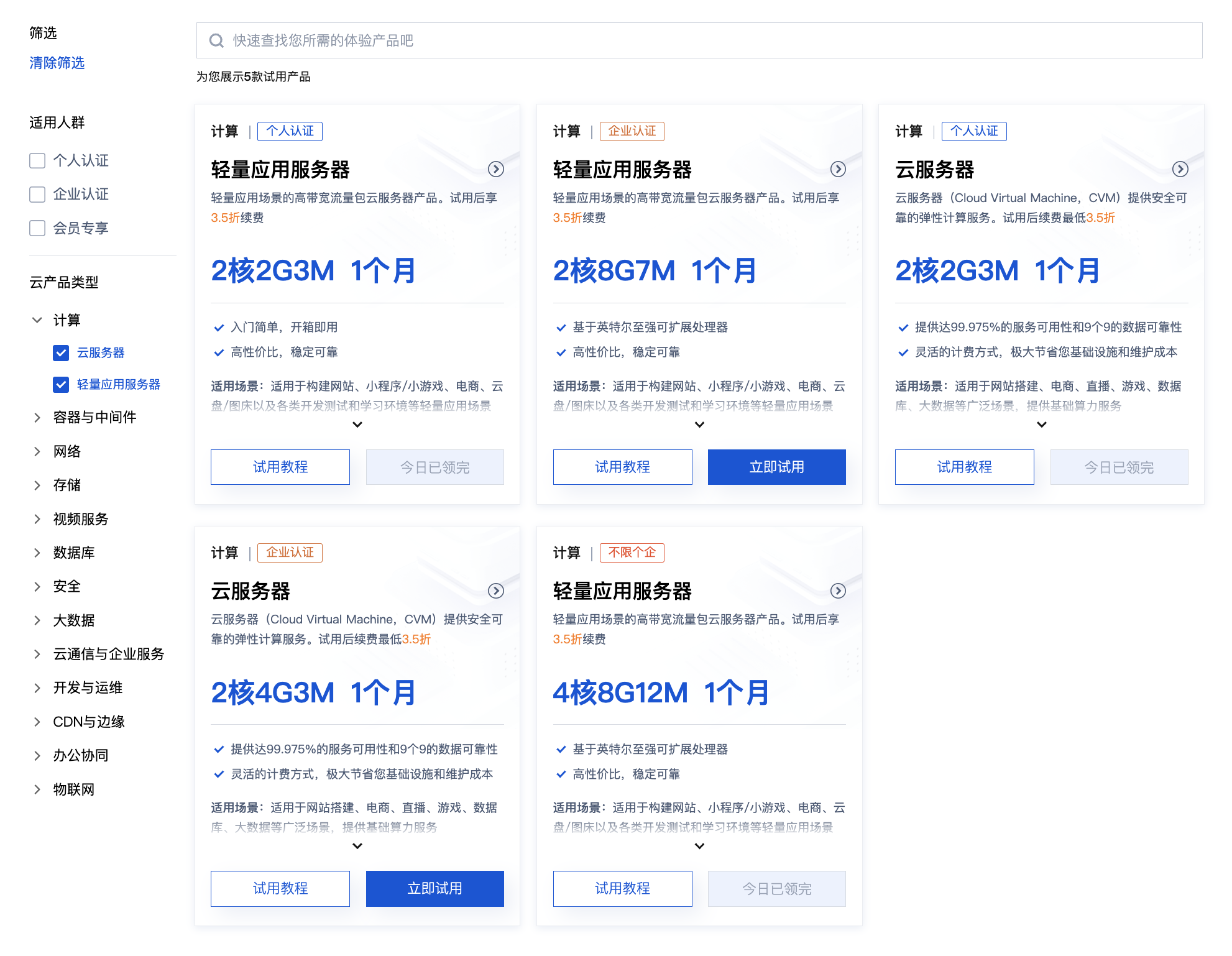

Даже новички могут быстро приступить к работе с легким сервером приложений.

Взгляд на RSAC 2024|Защита конфиденциальности в эпоху больших моделей

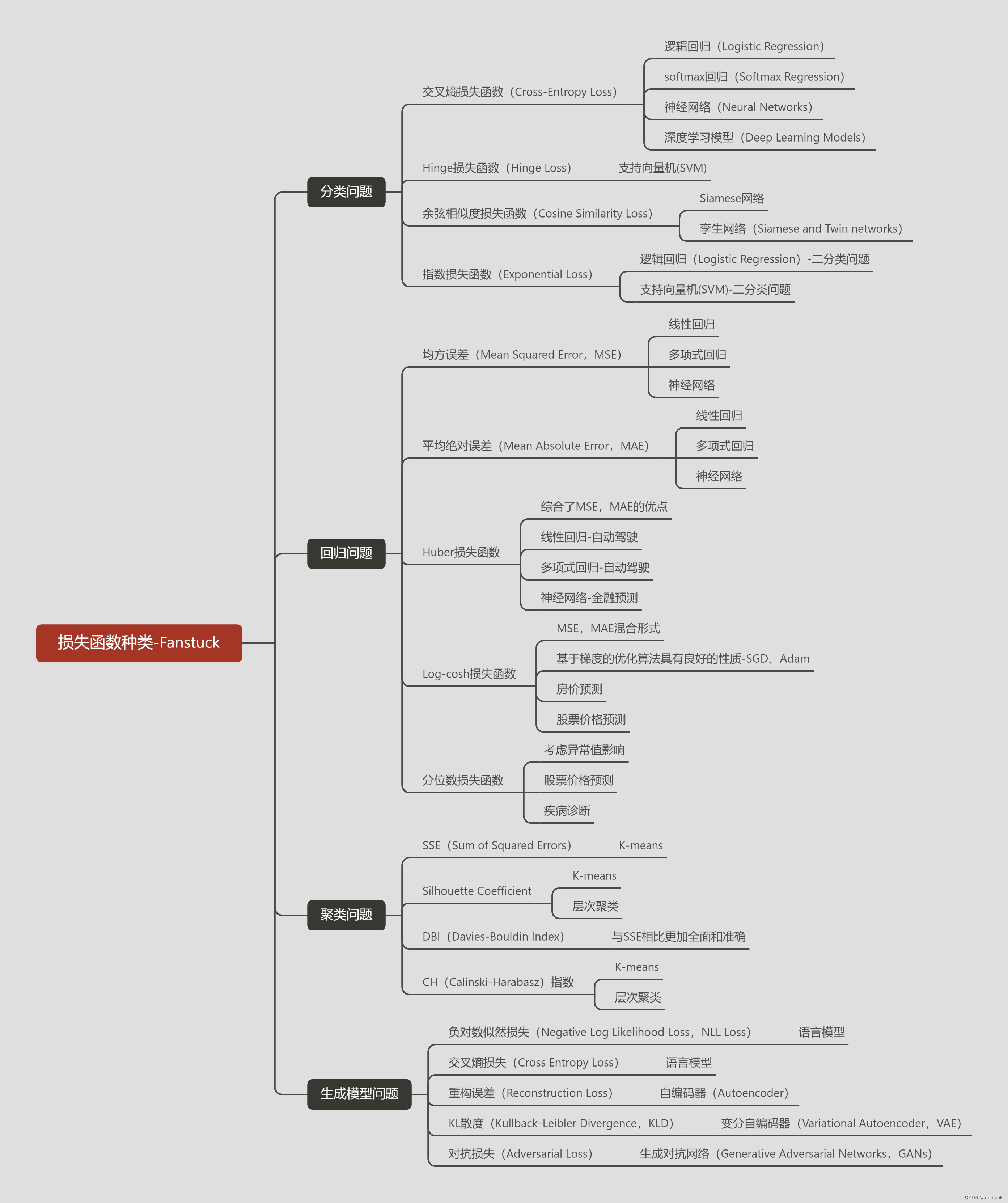

Вы используете ИИ каждый день и до сих пор не знаете, как ИИ дает обратную связь? Одна статья для понимания реализации в коде Python общих функций потерь генеративных моделей + анализ принципов расчета.

Используйте (внутренний) почтовый ящик для образовательных учреждений, чтобы использовать Microsoft Family Bucket (1T дискового пространства на одном диске и версию Office 365 для образовательных учреждений)

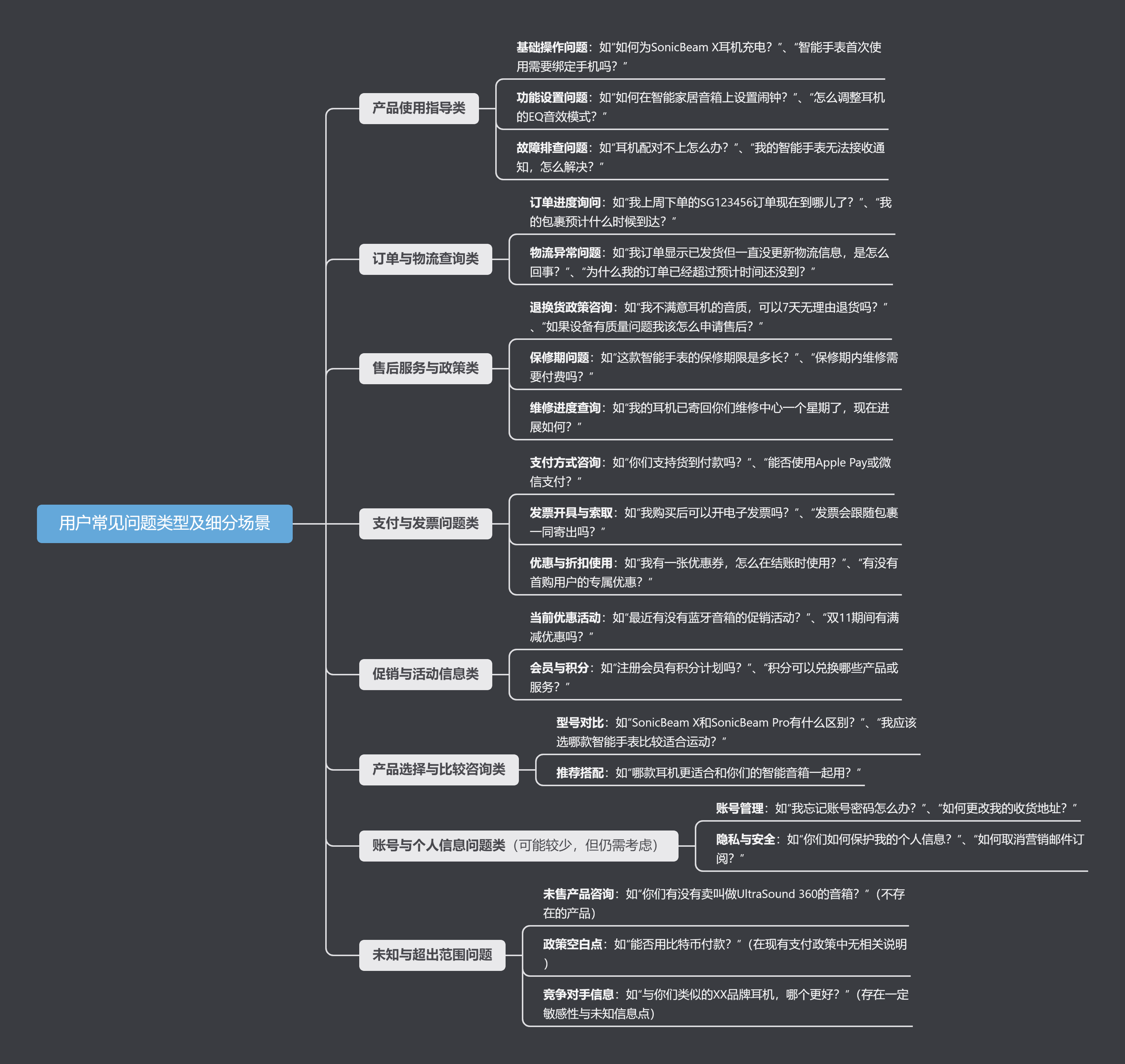

Руководство по началу работы с оперативным проектом (7) Практическое сочетание оперативного письма — оперативного письма на основе интеллектуальной системы вопросов и ответов службы поддержки клиентов

[docker] Версия сервера «Чтение 3» — создайте свою собственную программу чтения веб-текста

Обзор Cloud-init и этапы создания в рамках PVE

Корпоративные пользователи используют пакет регистрационных ресурсов для регистрации ICP для веб-сайта и активации оплаты WeChat H5 (с кодом платежного узла версии API V3)

Подробное объяснение таких показателей производительности с высоким уровнем параллелизма, как QPS, TPS, RT и пропускная способность.

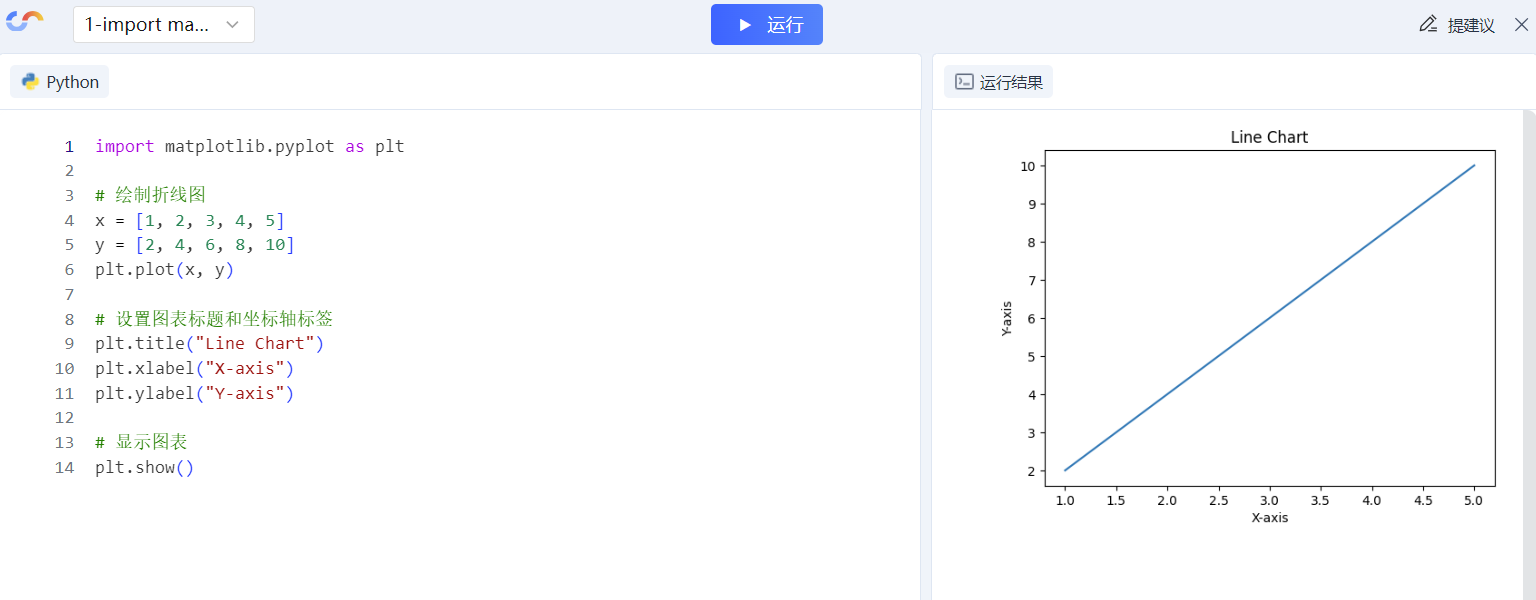

Удачи в конкурсе Python Essay Challenge, станьте первым, кто испытает новую функцию сообщества [Запускать блоки кода онлайн] и выиграйте множество изысканных подарков!

[Техническая посадка травы] Кровавая рвота и отделка позволяют вам необычным образом ощипывать гусиные перья! Не распространяйте информацию! ! !

[Официальное ограниченное по времени мероприятие] Сейчас ноябрь, напишите и получите приз

Прочтите это в одной статье: Учебник для няни по созданию сервера Huanshou Parlu на базе CVM-сервера.

Cloud Native | Что такое CRD (настраиваемые определения ресурсов) в K8s?

Как использовать Cloudflare CDN для настройки узла (CF самостоятельно выбирает IP) Гонконг, Китай/Азия узел/сводка и рекомендации внутреннего высокоскоростного IP-сегмента

Дополнительные правила вознаграждения амбассадоров акции в марте 2023 г.

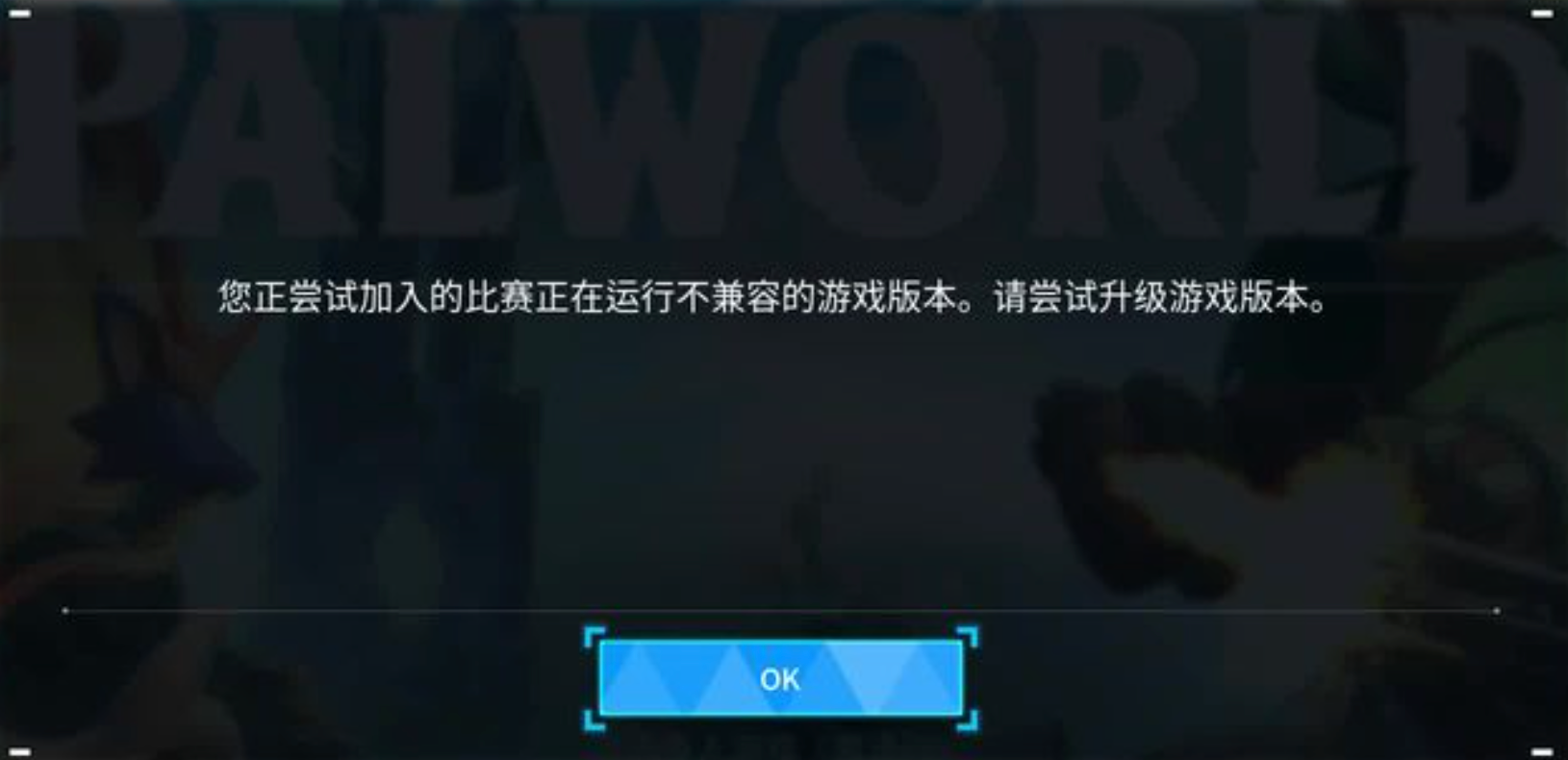

Можно ли открыть частный сервер Phantom Beast Palu одним щелчком мыши? Супер простой урок для начинающих! (Прилагается метод обновления сервера)

[Играйте с Phantom Beast Palu] Обновите игровой сервер Phantom Beast Pallu одним щелчком мыши

Maotouhu делится: последний доступный внутри страны адрес склада исходного образа Docker 2024 года (обновлено 1 декабря)

Кодирование Base64 в MultipartFile

5 точек расширения SpringBoot, супер практично!

Глубокое понимание сопоставления индексов Elasticsearch.