Набор данных автономного вождения nuScenes

nuScenes — это большой общедоступный набор данных по автономному вождению, который позволяет исследователям изучать сложные ситуации вождения в городских условиях, используя полный набор датчиков реальных автономных транспортных средств.

Введение

NuScenes Набор данных (Произносится как/nuːsiːnz/) это публика из массового Автономного вождение Набор данных,Зависит от Motional (бывший nuTonomy) развитие команды. Dynamics делает беспилотные автомобили безопасной, надежной и простой в использовании реальностью. Публикуя часть наших данных, Motion Цель — поддержать общественные исследования в области компьютерного зрения и автономного вождения.

Для этого мы собрали 1000 сценариев вождения в Бостоне и Сингапуре, двух городах, известных своим интенсивным движением транспорта и сложными условиями вождения. 20-секундные сцены выбираются вручную, чтобы показать различные интересные маневры вождения, дорожные ситуации и неожиданное поведение. Богатая сложность NuScenes будет способствовать разработке методов, обеспечивающих безопасное вождение в городских районах с десятками объектов в сцене. Собирая данные на разных континентах, мы можем дополнительно изучить обобщение алгоритмов компьютерного зрения для разных мест, погодных условий, типов транспортных средств, растительности, дорожной разметки, а также левого и правого движения.

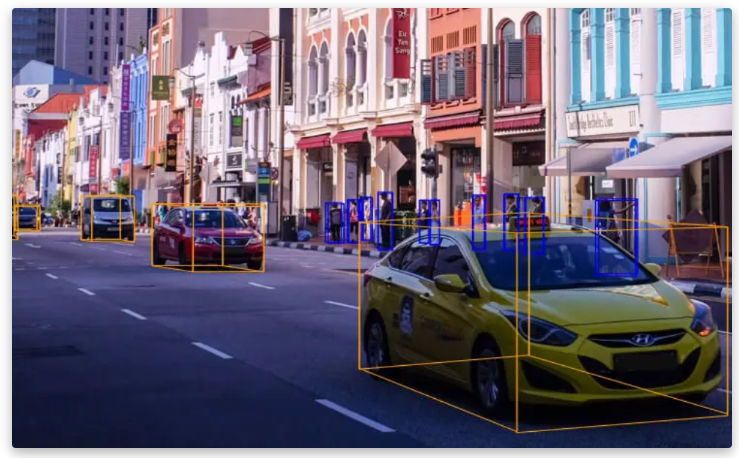

Для облегчения общих задач компьютерного зрения,Например, обнаружение и отслеживание целей.,мы повсюду Набор данных Для использования 2Hz 23 класса объектов снабжены точными трехмерными ограничительными рамками. Кроме того, мы аннотируем свойства уровня объекта, такие как видимость, активность и поза.

для nuScenes Набор Данные мы собрали около 15 часов вождения в Бостоне и Сингапуре. для завершенияиз nuScenes Набор данные, мы публикуем из Boston Seaport и Сингапур One Норт, Квинстаун и Holland Village Региональные данные. Маршруты движения тщательно выбираются с учетом сложных ситуаций. Мы ориентируемся на разные места, время и погодные условия. Чтобы сбалансировать распределение частоты классов, мы включаем больше сцен с редкими классами (например, велосипедами). Используя эти критерии, мы вручную отобрали 1000 сцен продолжительностью 20 секунд каждая. Сцены тщательно аннотированы экспертами. Директивы аннотатора можно найти в devkit нашел в репозитории.

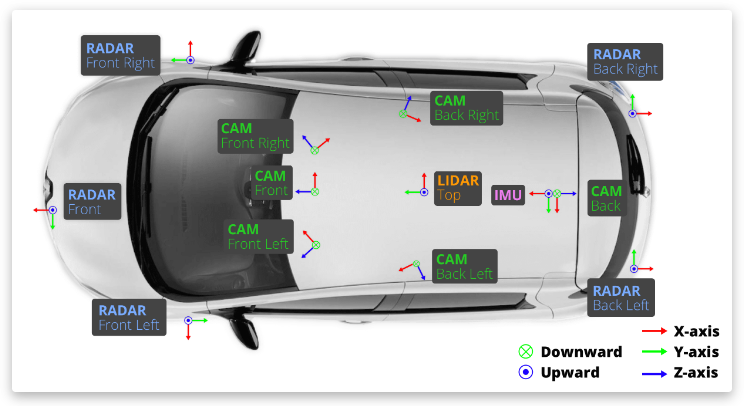

Мы используем два автомобиля Renault Zoe в Бостоне и Сингапуре, и у них абсолютно одинаковое расположение датчиков. Эти данные были собраны с исследовательской платформы и не учитывают настройки, используемые в продуктах Motion. Расположение датчика смотрите на изображении выше.

Набор данных Функции:

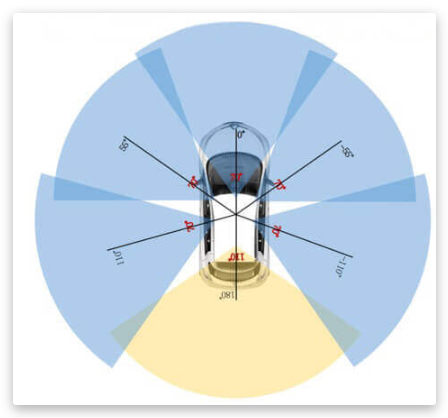

- Полный комплект датчиков (один лидар,Пять радаров,Шесть камер, IMU, GPS)

- 1000 данные сцен, данные каждой группы 20s

- 1 400 000 изображений с камеры

- 390000 лидарсканированиеданные

- Данные двух городов: Бостон и Сингапур.

- Подробная информация о карте

- Ручная аннотация для 23 классов объектов из 1,4 M 3D-ограждающая рамка

- Такие атрибуты, как видимость, активность и поза.

- 1.1 Б лидар точка 32 аннотация руководства по категории

- Бесплатно для некоммерческого использования

официальный адрес:https://nuscenes.org/

Ссылка для скачивания:https://nuscenes.org/nuscenes

Калибровка датчика

Для получения высокого качества из мультисенсорного набора данных,Каждый датчик должен быть откалиброван по его внешним и внутренним характеристикам. Обозначим фазу для саморамкииз внешних координат,То есть центральная точка задней оси. Наиболее актуальные шаги заключаются в следующем:

лидар

Мы используем лазерные линии для точного измерения относительного положения рамки лидаризиз.

камера

Помещаем калибровочную мишень в форме куба перед датчиком камеры или дара. Калибровочная мишень состоит из трех ортогональных плоскостей с известными диаграммами направленности. После обнаружения закономерности,Мы рассчитываем матрицу преобразования камеры в лидариз путем калибровки цели по плоскости. Учитывая приведенный выше расчет, излидар для преобразования собственного кадра,Затем мы можем вычислить преобразование кадра камеры в себя и таким образом сгенерировать внешние параметры.

радар

Устанавливаем радар в горизонтальное положение. Затем мы собрали данные радарных измерений, ездя в городских условиях. При фильтрации сигналов радара от движущейся цели,Калибруем угол рыскания методом перебора,Чтобы минимизировать скорость компенсации расстояния от статической цели.

камера Внутренняя калибровка

Мы используем калибровочную мишень с известным набором шаблонов, чтобы определить внутренние параметры камеры и параметры искажения.

Синхронизация датчиков

Добиться хорошего кросс-модального выравнивания данных между лидарикамерой.,Когда верхний лидар проходит по центру поля зрения,камераиз Экспозиция срабатывает。изображениеиз Временная метка — это время срабатывания экспозиции.; Временная метка сканирования лидара — это полный поворот текущего кадра лидара во времени. Учитывая, что время экспозиции практически мгновенное, этот метод обычно обеспечивает хорошее выравнивание. Обратите внимание, что камера работает 12Гц, при этом лидар работает 20 Гц. 12 снимков камеры распределены максимально равномерно среди 20 лидарных сканов, поэтому не все излидарные сканы имеют соответствующую изкамерарамку. Уменьшите частоту кадров камеры до 12 Гц. Помогает снизить требования к вычислительным ресурсам, пропускной способности и памяти сенсорных систем.

Индекс оценки

Метрики для задачи обнаружения nuScenes. Наша окончательная оценка представляет собой взвешенную сумму средней средней точности (mAP) и нескольких истинно положительных показателей (TP).

Average Precision metric

- mean Average Precision (mAP)

Мы используем известную метрику средней точности,Однако соответствие определяется путем рассмотрения двумерного межосевого расстояния на плоскости земли. Конкретно,Мы сопоставляем прогнозы с прогнозами с минимальным межцентровым расстоянием до определенного порога из основного истинного объекта. для заданного порога соответствия,Мы рассчитываем среднюю точность (AP) путем интегрирования кривой полноты и точности. , и точность > 0,1. Наконец, мы усредняем порог соответствия {0,5, 1, 2, 4} метров и вычисляем среднее значение по классам.

рис. При вычислении AP полнота и точность ниже 0,1 удаляются, и эти области заменяются на 0. Для расчета mAP используются разные категории и разные трудности D:

True Positive metrics

Мы определяем метрики, измеряющие трансформацию/масштаб/направление/скорость и ошибки атрибутов для набора истинных фронтов (TP). В процессе сопоставления все индикаторы TP рассчитываются с использованием порогового значения межцентрового расстояния в 2 м, и все они являются положительными скалярами.

Сопоставление и оценка происходят отдельно для каждой категории, и каждый показатель представляет собой среднее кумулятивное среднее значение более 10 % каждого достигнутого уровня запоминания. Если класс не достигает 10% отзыва, всем ошибкам TP для этого класса присваивается значение 1. Определим следующие ошибки ТП:

индекс | значение |

|---|---|

Average Translation Error (ATE) | Двумерное евклидово расстояние между центрами в метрах. |

Average Scale Error (ASE) | 1 - IoU, где IoU - это трехмерное отношение пересечения к объединению, выровненное по углу. |

Average Orientation Error (AOE) | Минимальная разница угла отклонения между прогнозом дуги и истинной точкой зрения. Ошибка направления оценивается в 360 градусов, за исключением препятствий, все категории оцениваются только в 180 градусов. Игнорируйте ошибки ориентации конуса. |

Average Velocity Error (AVE) | Норма L2 двумерной разности скоростей (м/с) игнорирует абсолютную ошибку скорости препятствий и конусов в ошибке скорости м/с. |

Average Attribute Error (AAE) | Рассчитывается как 1-акк, где акк — точность классификации атрибута. Не обращайте внимания на ошибки в свойствах барьеров и конусов. |

TP индекс определяется классом из, а затем мы используем класс из среднего для расчета mATE、 mASE、 mAOE、 mAVE и mAAE。

nuScenes detection score

- nuScenes detection score (NDS)

. Затем мы присваиваем вес как 5 из mAP и 1 из 5 TP балл, и вычислить нормализованное изtotal и.

Оригинальная бумага

Ссылки

Ссылка на статью:

Учебное пособие по Jetpack Compose для начинающих, базовые элементы управления и макет

Код js веб-страницы, фон частицы, код спецэффектов

【новый! Суперподробное】Полное руководство по свойствам компонентов Figma.

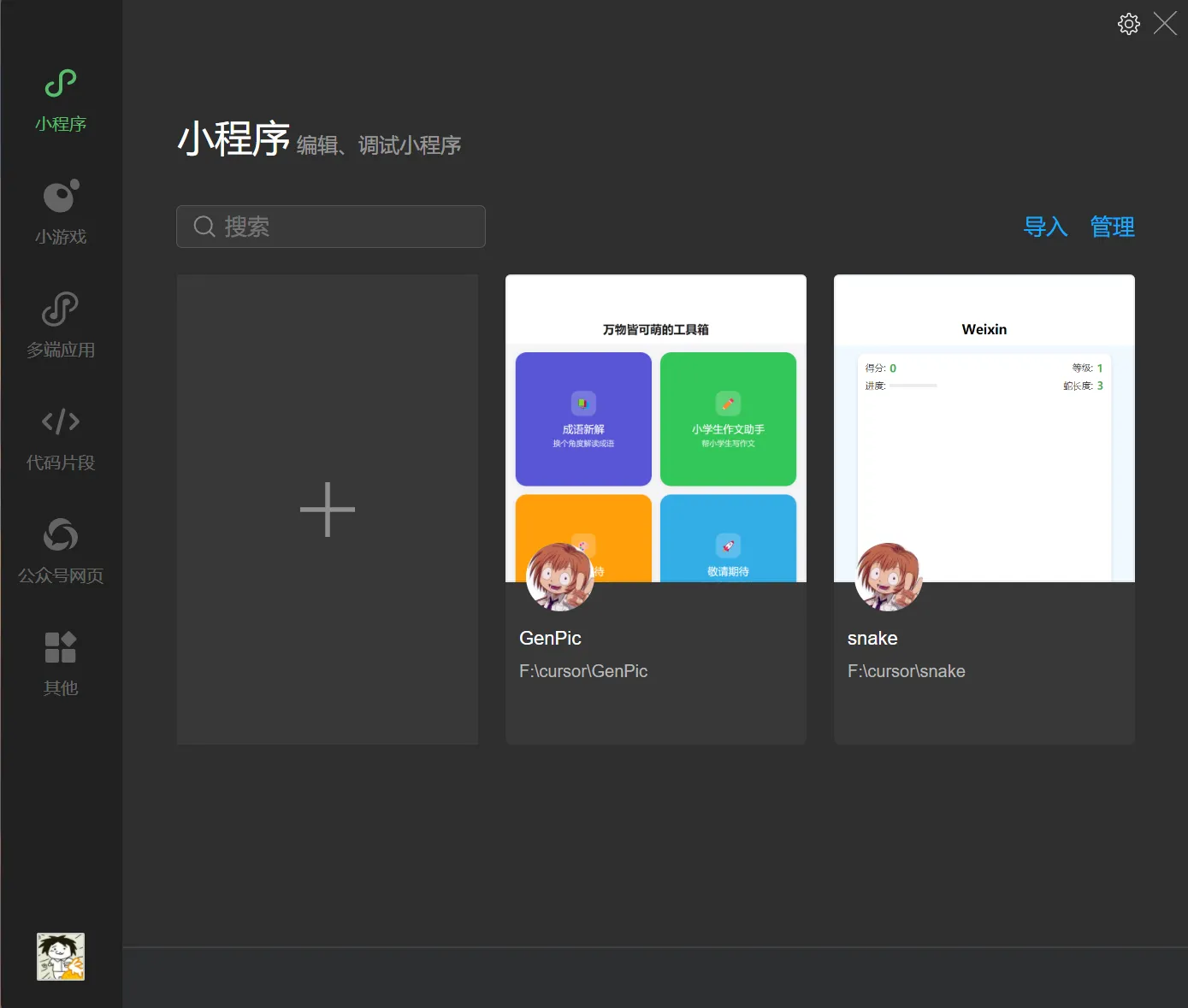

🎉Обязательно к прочтению новичкам: полное руководство по написанию мини-программ WeChat с использованием программного обеспечения Cursor.

[Забавный проект Docker] VoceChat — еще одно приложение для мгновенного чата (IM)! Может быть встроен в любую веб-страницу!

Как реализовать переход по странице в HTML (html переходит на указанную страницу)

Как решить проблему зависания и низкой скорости при установке зависимостей с помощью npm. Существуют ли доступные источники npm, которые могут решить эту проблему?

Серия From Zero to Fun: Uni-App WeChat Payment Practice WeChat авторизует вход в систему и украшает страницу заказа, создает интерфейс заказа и инициирует запрос заказа

Серия uni-app: uni.navigateЧтобы передать скачок значения

Апплет WeChat настраивает верхнюю панель навигации и адаптируется к различным моделям.

JS-время конвертации

Обеспечьте бесперебойную работу ChromeDriver 125: советы по решению проблемы chromedriver.exe не найдены

Поле комментария, щелчок мышью, специальные эффекты, js-код

Объект массива перемещения объекта JS

Как открыть разрешение на позиционирование апплета WeChat_Как использовать WeChat для определения местонахождения друзей

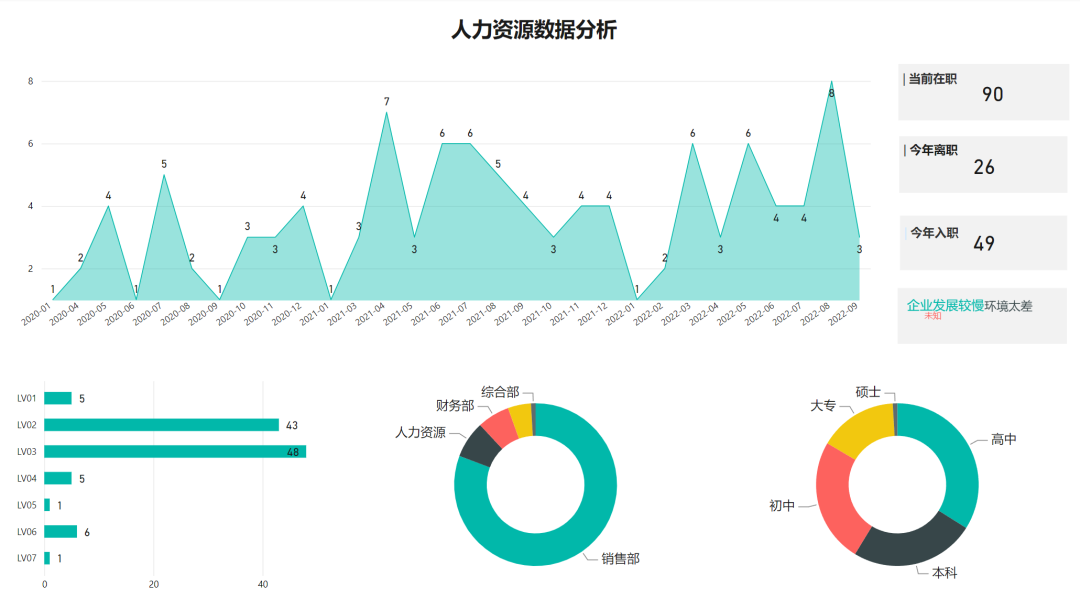

Я даю вам два набора из 18 простых в использовании фонов холста Power BI, так что вам больше не придется возиться с цветами!

Получить текущее время в js_Как динамически отображать дату и время в js

Вам необходимо изучить сочетания клавиш vsCode для форматирования и организации кода, чтобы вам больше не приходилось настраивать формат вручную.

У ChatGPT большое обновление. Всего за 45 минут пресс-конференция показывает, что OpenAI сделал еще один шаг вперед.

Copilot облачной разработки — упрощение разработки

Микросборка xChatGPT с низким кодом, создание апплета чат-бота с искусственным интеллектом за пять шагов

CUDA Out of Memory: идеальное решение проблемы нехватки памяти CUDA

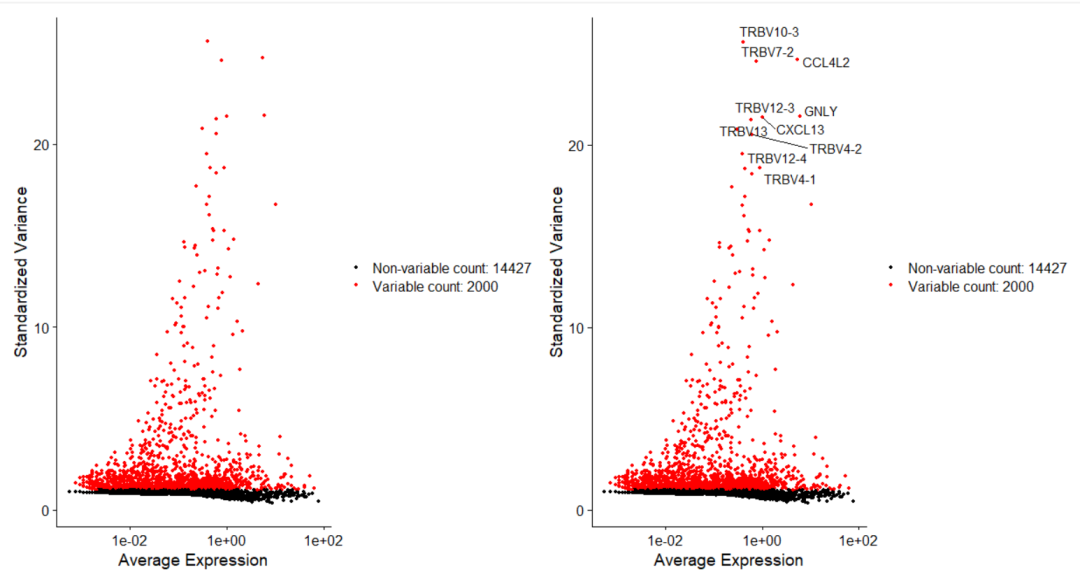

Анализ кластеризации отдельных ячеек, который должен освоить каждый&MarkerгенетическийВизуализация

vLLM: мощный инструмент для ускорения вывода ИИ

CodeGeeX: мощный инструмент генерации кода искусственного интеллекта, который можно использовать бесплатно в дополнение к второму пилоту.

Машинное обучение Реальный бой LightGBM + настройка параметров случайного поиска: точность 96,67%

Бесшовная интеграция, мгновенный интеллект [1]: платформа больших моделей Dify-LLM, интеграция без кодирования и встраивание в сторонние системы, более 42 тысяч звезд, чтобы стать свидетелями эксклюзивных интеллектуальных решений.

LM Studio для создания локальных больших моделей

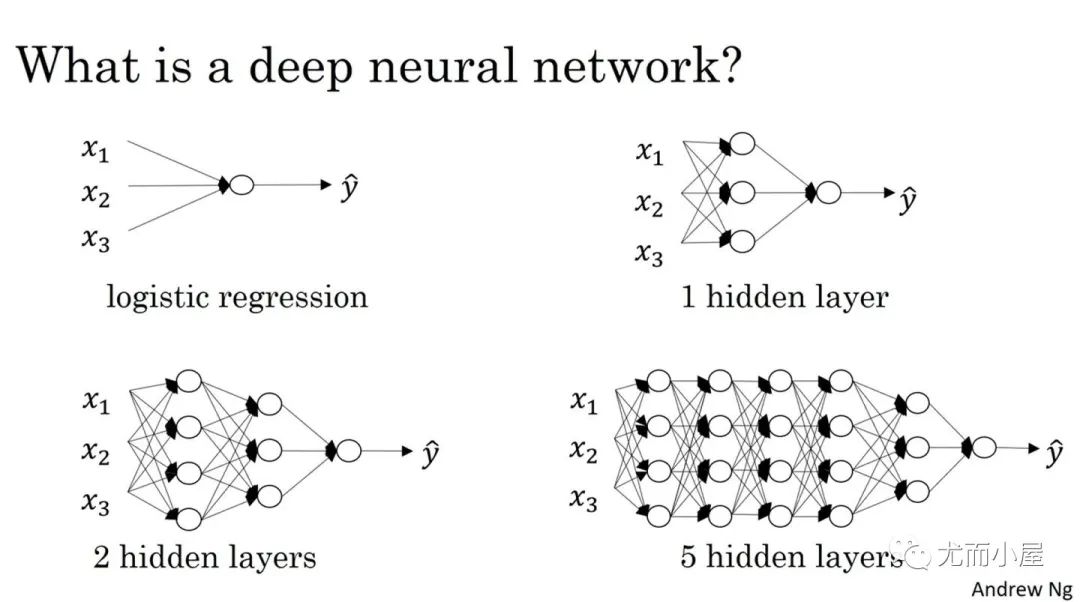

Как определить количество слоев и нейронов скрытых слоев нейронной сети?