[Колонка 17 Elasticsearch] Углубленное исследование: стратегия агрегирования данных Elasticsearch на миллиардном уровне.

01 Введение

В эпоху больших данных объем данных достиг ошеломляющего уровня, часто достигая сотен миллионов и более. Для такого объема данных вопрос о том, как выполнять эффективные операции агрегирования, стал предметом внимания многих разработчиков и специалистов по данным. Elasticsearch (сокращенно ES) как мощная распределенная система поиска и анализа обеспечивает надежную поддержку агрегирования больших объемов данных. В этой статье мы углубимся в то, как ES обрабатывает сотни миллионов агрегированных данных, и подробно объясним каждую деталь, чтобы помочь читателям лучше понять и применить функцию агрегирования ES.

02 Обзор агрегации Elasticsearch

Функция агрегирования Elasticsearch — одна из его основных функций, которая позволяет пользователям выполнять комплексный анализ и обобщение данных, хранящихся в ES. Операции агрегирования могут выполняться на основе одного или нескольких полей. Путем группировки, подсчета и расчета значений этих полей можно получить сводную информацию различных размерностей. Эта информация имеет решающее значение для анализа данных и поддержки принятия решений.

03 Проблемы при обработке больших объемов данных

Когда объем данных достигает сотен миллионов, реализация операций агрегации сталкивается с огромными проблемами. Во-первых, резко возрастет потребление вычислительных ресурсов, включая процессор, память и пропускную способность сети. Во-вторых, время ответа на запрос может стать очень большим, даже выходя за рамки диапазона ожидания пользователя. Наконец, распространение и хранение данных также могут оказывать важное влияние на эффективность операций агрегирования.

04 Стратегия агрегирования больших данных Elasticsearch

Чтобы решить эти проблемы, Elasticsearch применяет ряд стратегий и методов для оптимизации операций агрегирования больших объемов данных. Эти стратегии и методы будут подробно представлены ниже, а также будут приведены соответствующие примеры кода и команд.

1. Приблизительная агрегация

Для операций агрегирования больших объемов данных точные результаты часто не нужны, а приблизительные результаты обычно могут удовлетворить потребности. Elasticsearch предоставляет приблизительные функции агрегирования, такие как мера мощности, упомянутая ранее. Этот метод агрегации может значительно снизить нагрузку на вычисления и память, обеспечивая при этом определенную точность. Установив параметр Precision_threshold, вы можете контролировать баланс между точностью и использованием памяти.

2. Агрегация сегментов

Агрегация сегментов — это метод разделения данных на несколько сегментов для обработки. Каждый сегмент может содержать часть данных, и для каждого сегмента могут выполняться независимые статистические вычисления. Этот подход может снизить сложность отдельных вычислений агрегирования и улучшить возможности обработки больших объемов данных. В Elasticsearch вы можете использовать агрегацию терминов для реализации агрегации сегментов. Установив параметр размера, вы можете ограничить количество возвращаемых сегментов, чтобы избежать чрезмерных вычислений и потребления памяти.

3. Распределенная агрегация

Elasticsearch — это распределенная система, которая, естественно, поддерживает распределенную агрегацию. При распределенной агрегации данные распределяются по нескольким узлам для обработки. Каждый узел отвечает за обработку части данных и возвращает результаты обработки координирующему узлу. Узел координации отвечает за объединение результатов работы каждого узла в конечный результат и возврат его клиенту. Этот метод позволяет полностью использовать вычислительные ресурсы и ресурсы хранения кластера, а также повысить эффективность и масштабируемость операций агрегации. Выполнить распределенную агрегацию в Elasticsearch так же просто, как отправить запрос на агрегацию в кластер.

4. Оптимизируйте индексы и запросы

Помимо использования таких методов, как приблизительное агрегирование, агрегирование сегментов и распределенное агрегирование, вы также можете повысить производительность агрегирования больших объемов данных за счет оптимизации индексов и запросов. Это включает в себя выбор подходящих типов полей, использование соответствующих параметров анализатора и сопоставления, оптимизацию операторов запроса и использование таких методов, как разбиение по страницам и ограничение размеров набора результатов. Эти меры оптимизации могут сократить ненужные вычисления и потребление памяти, повысить скорость ответа на запросы и общую производительность системы.

05 Примеры кода и команд

Ниже приведен пример кода и команды для использования Elasticsearch для агрегирования больших объемов данных:

Пример 1. Приблизительное агрегирование с использованием меры мощности

POST /your_index/_search

{

"size": 0,

"aggs": {

"unique_users": {

"cardinality": {

"field": "user_id",

"precision_threshold": 40000

}

}

}

}В приведенном выше коде,назватьyour_indexДля индекса отправлен запрос на агрегацию.,использоватьcardinalityметрическая параuser_idполе Приблизительная агрегация,Подсчитайте количество уникальных пользователей。установивprecision_thresholdПараметры40000,Уравновешивает потребности в точности и использовании Память.

Пример 2. Агрегация сегментов с использованием агрегации терминов

POST /your_index/_search

{

"size": 0,

"aggs": {

"group_by_field": {

"terms": {

"field": "your_field",

"size": 10000,

"shard_size": 50000

},

"aggs": {

"average_score": {

"avg": {

"field": "score"

}

}

}

}

}

}В приведенном выше коде,Используйте агрегацию терминов для выполнения операции группирования данных.,в соответствии сyour_fieldГруппировать по значению поля。Затем,Внутри каждого сегмента выполняется еще одно среднее агрегирование.,рассчитывается в каждом ведреscoreсреднее значение поля。установивsizeПараметры10000иshard_sizeПараметры50000,Ограничивает количество возвращаемых сегментов и количество обрабатываемых сегментов на каждом сегменте.,Чтобы избежать излишнего расчета и Память потребления. Следует отметить, что,Значение настройки здесь должно быть скорректировано в соответствии с фактической ситуацией и оптимизацией.

06 Резюме

В этой статье подробно описано, как Elasticsearch обрабатывает сотни миллионов операций агрегирования данных. Используя такие методы, как приблизительное агрегирование, агрегирование сегментов, распределенное агрегирование и меры по оптимизации индексов и запросов, можно эффективно повысить производительность и масштабируемость агрегирования больших данных. В реальных приложениях для достижения наилучшей производительности необходимо внести соответствующие корректировки и оптимизации с учетом конкретных потребностей бизнеса и объема данных. Я считаю, что благодаря постоянному развитию и совершенствованию технологий Elasticsearch в будущем будет предоставлять все более эффективные методы и инструменты для удовлетворения растущих потребностей в обработке больших данных. В то же время необходимо постоянно изучать и исследовать новые технологии и методы, чтобы лучше справляться с проблемами и возможностями в эпоху больших данных.

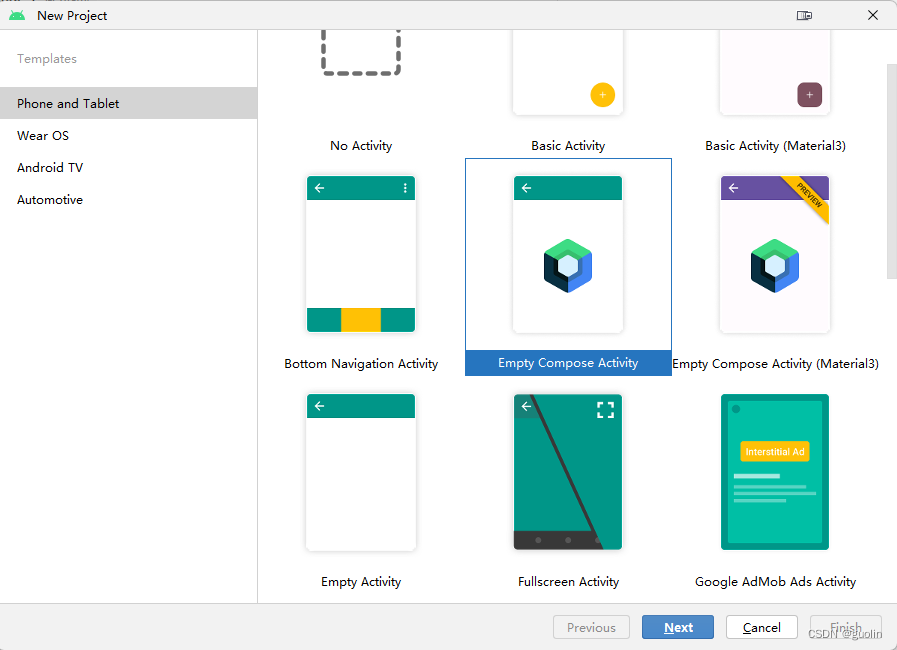

Учебное пособие по Jetpack Compose для начинающих, базовые элементы управления и макет

Код js веб-страницы, фон частицы, код спецэффектов

【новый! Суперподробное】Полное руководство по свойствам компонентов Figma.

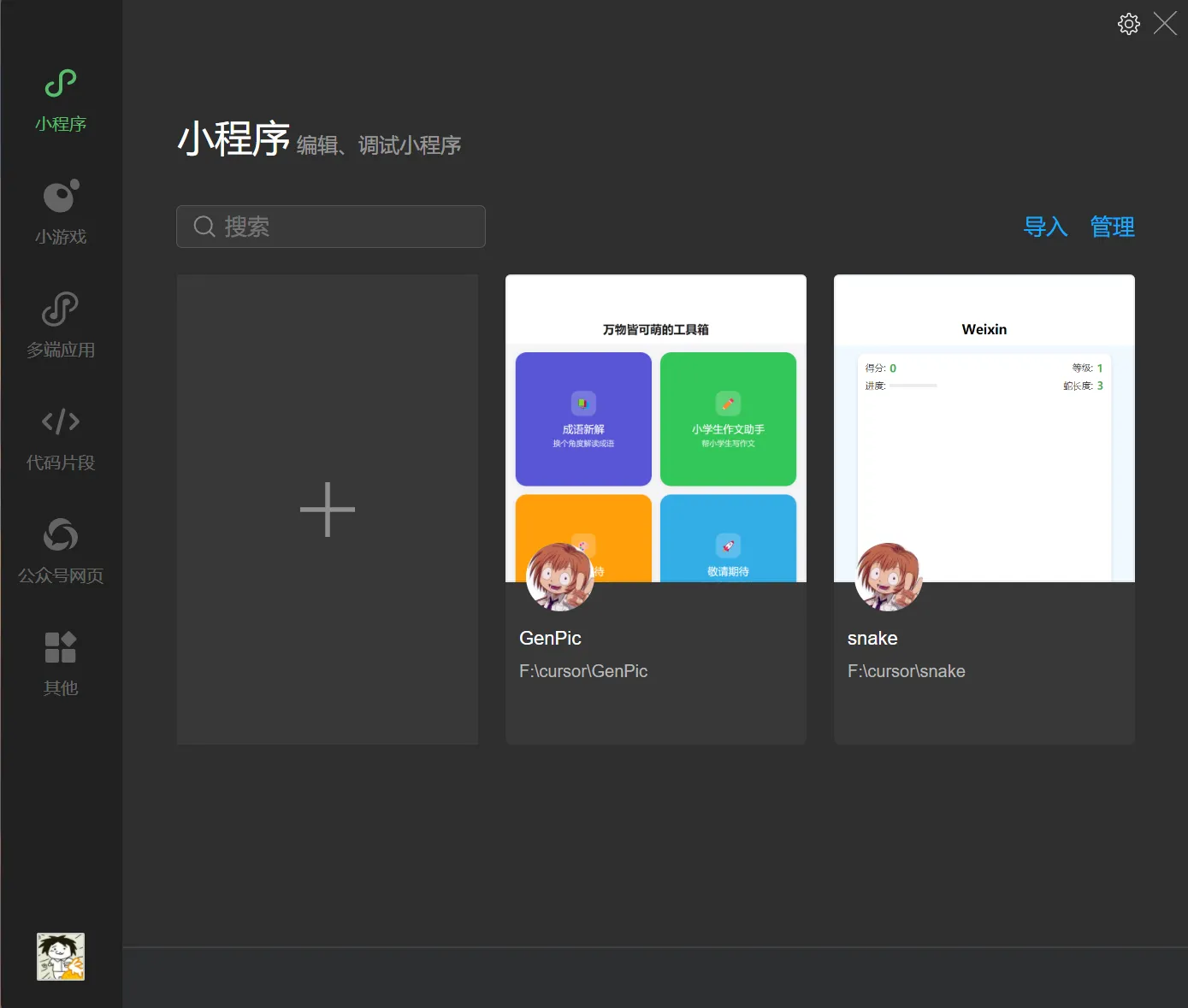

🎉Обязательно к прочтению новичкам: полное руководство по написанию мини-программ WeChat с использованием программного обеспечения Cursor.

[Забавный проект Docker] VoceChat — еще одно приложение для мгновенного чата (IM)! Может быть встроен в любую веб-страницу!

Как реализовать переход по странице в HTML (html переходит на указанную страницу)

Как решить проблему зависания и низкой скорости при установке зависимостей с помощью npm. Существуют ли доступные источники npm, которые могут решить эту проблему?

Серия From Zero to Fun: Uni-App WeChat Payment Practice WeChat авторизует вход в систему и украшает страницу заказа, создает интерфейс заказа и инициирует запрос заказа

Серия uni-app: uni.navigateЧтобы передать скачок значения

Апплет WeChat настраивает верхнюю панель навигации и адаптируется к различным моделям.

JS-время конвертации

Обеспечьте бесперебойную работу ChromeDriver 125: советы по решению проблемы chromedriver.exe не найдены

Поле комментария, щелчок мышью, специальные эффекты, js-код

Объект массива перемещения объекта JS

Как открыть разрешение на позиционирование апплета WeChat_Как использовать WeChat для определения местонахождения друзей

Я даю вам два набора из 18 простых в использовании фонов холста Power BI, так что вам больше не придется возиться с цветами!

Получить текущее время в js_Как динамически отображать дату и время в js

Вам необходимо изучить сочетания клавиш vsCode для форматирования и организации кода, чтобы вам больше не приходилось настраивать формат вручную.

У ChatGPT большое обновление. Всего за 45 минут пресс-конференция показывает, что OpenAI сделал еще один шаг вперед.

Copilot облачной разработки — упрощение разработки

Микросборка xChatGPT с низким кодом, создание апплета чат-бота с искусственным интеллектом за пять шагов

CUDA Out of Memory: идеальное решение проблемы нехватки памяти CUDA

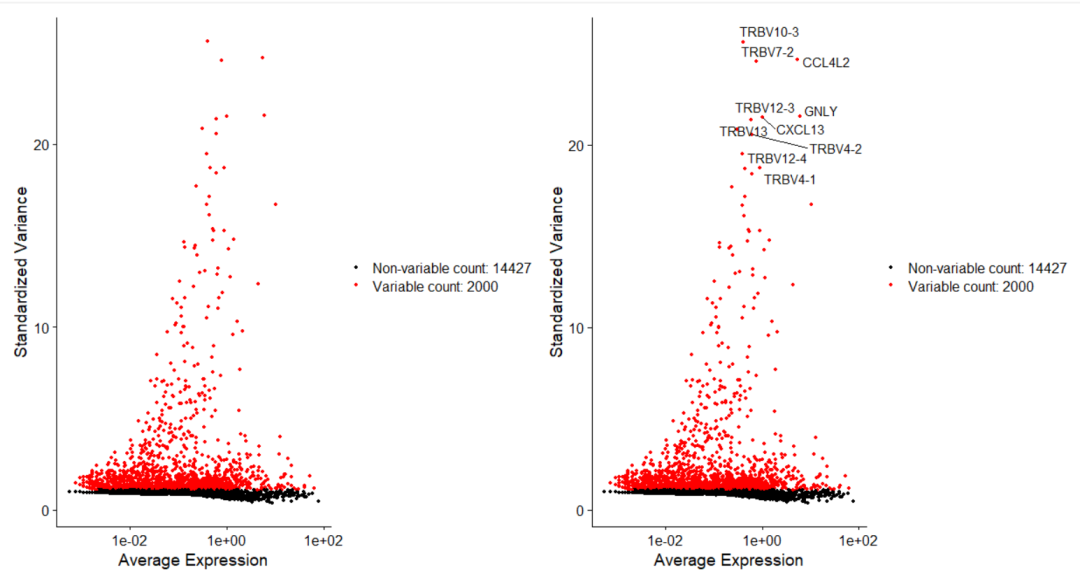

Анализ кластеризации отдельных ячеек, который должен освоить каждый&MarkerгенетическийВизуализация

vLLM: мощный инструмент для ускорения вывода ИИ

CodeGeeX: мощный инструмент генерации кода искусственного интеллекта, который можно использовать бесплатно в дополнение к второму пилоту.

Машинное обучение Реальный бой LightGBM + настройка параметров случайного поиска: точность 96,67%

Бесшовная интеграция, мгновенный интеллект [1]: платформа больших моделей Dify-LLM, интеграция без кодирования и встраивание в сторонние системы, более 42 тысяч звезд, чтобы стать свидетелями эксклюзивных интеллектуальных решений.

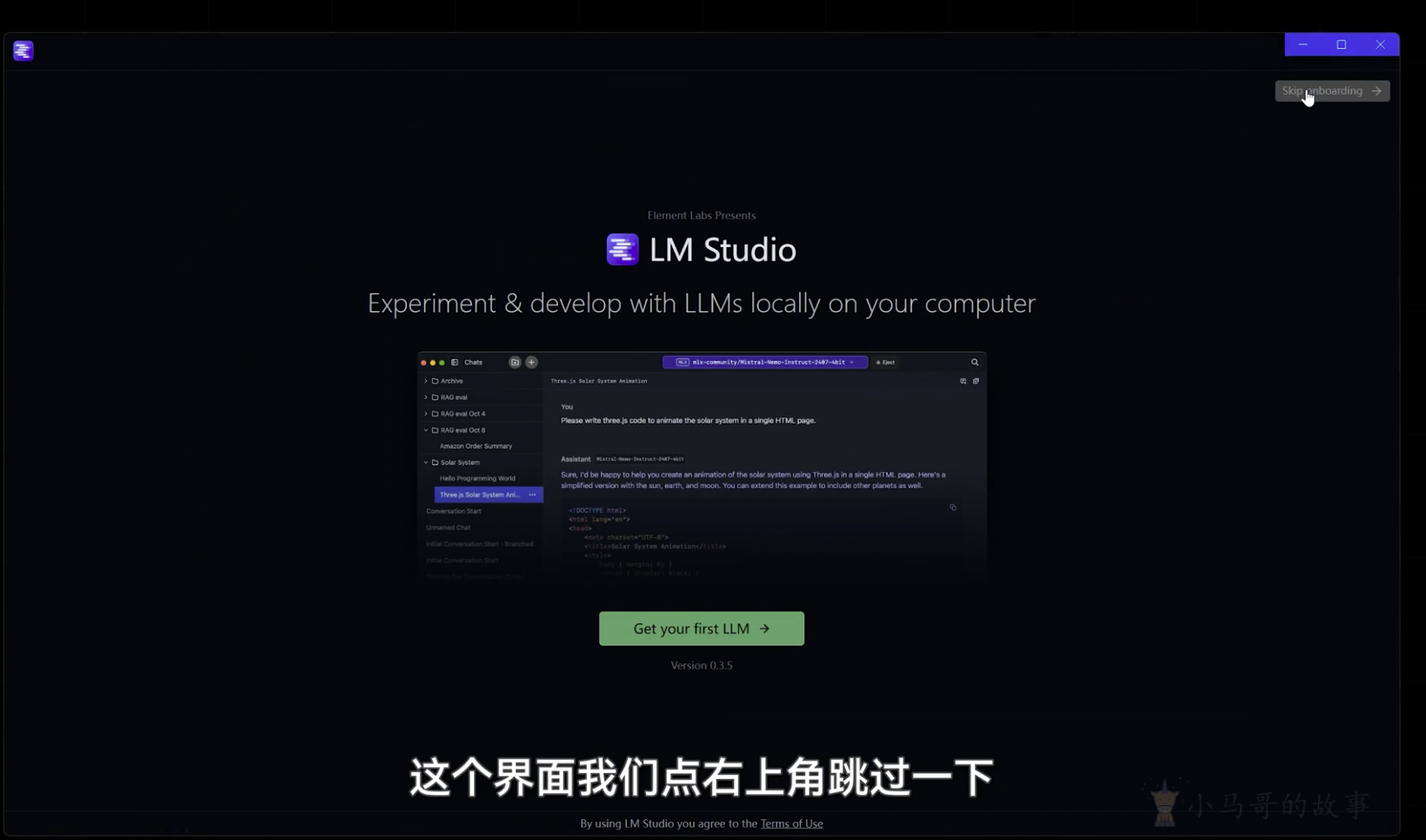

LM Studio для создания локальных больших моделей

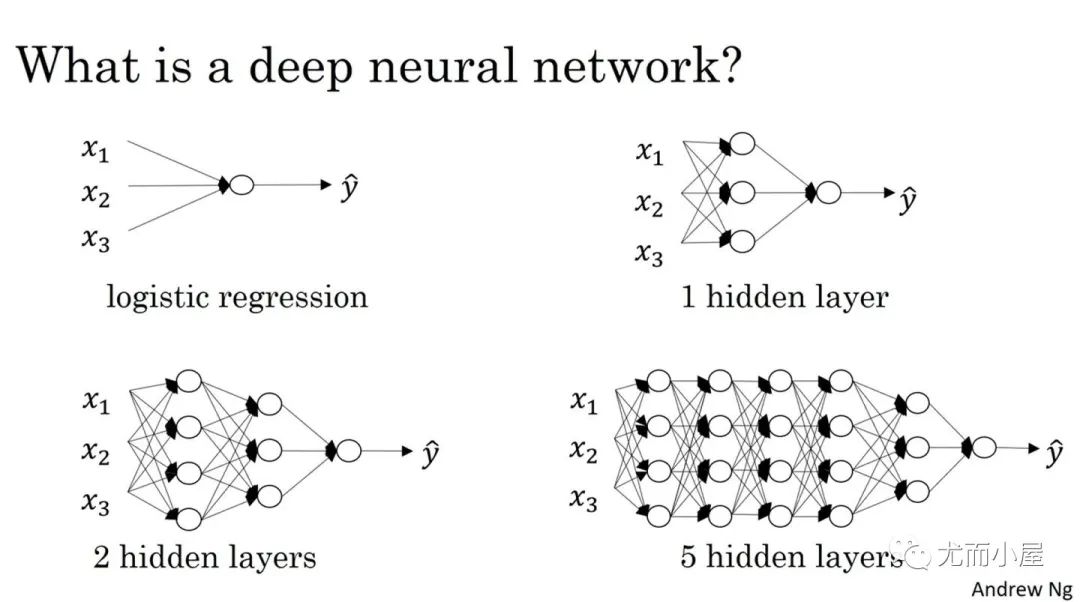

Как определить количество слоев и нейронов скрытых слоев нейронной сети?