Использование Python для реализации модели глубокого обучения для интеллектуального мониторинга безопасности пищевых продуктов

Безопасность пищевых продуктов является важным вопросом, связанным со здоровьем населения. С развитием науки и техники технологии глубокого обучения все чаще используются в мониторинге безопасности пищевых продуктов. Благодаря автоматизации и интеллектуальным средствам можно эффективно повысить эффективность и точность определения качества пищевых продуктов. В этой статье будет показано, как использовать Python для реализации модели глубокого обучения для интеллектуального мониторинга безопасности пищевых продуктов, а также продемонстрирован процесс реализации на примерах кода.

Обзор проекта

Этот проект направлен на создание интеллектуальной системы мониторинга безопасности пищевых продуктов, основанной на глубоком обучении и использующей технологию распознавания изображений для автоматического обнаружения посторонних веществ или нежелательных состояний в пищевых продуктах, таких как плесень, загрязнение и т. д. Конкретные шаги включают в себя:

- Подготовка данных

- Предварительная обработка данных

- Модельное здание

- Модельное обучение

- Оценка и оптимизация модели

- Практическое применение

1. Подготовка данных

Во-первых, нам нужно подготовить набор данных изображений пищевых продуктов, который содержит изображения нормальных и ненормальных (плесень, загрязнение и т. д.) продуктов питания. Данные можно собирать из наборов данных с открытым исходным кодом, таких как Kaggle, или самостоятельно.

import os

import pandas as pd

from sklearn.model_selection import train_test_split

# Предполагая, что набор данных загружен и сохранен в каталоге

data_dir = 'food_images/'

labels = []

images = []

for label in os.listdir(data_dir):

for file in os.listdir(os.path.join(data_dir, label)):

if file.endswith('.jpg') or file.endswith('.png'):

images.append(os.path.join(data_dir, label, file))

labels.append(label)

# CreateDataFrame

df = pd.DataFrame({

'image': images,

'label': labels

})

# Разделите обучающий набор и тестовый набор

train_df, test_df = train_test_split(df, test_size=0.2, random_state=42)2. Предварительная обработка данных

Используйте TensorFlow и Keras для предварительной обработки и улучшения данных изображения, чтобы улучшить возможности обобщения модели.

import tensorflow as tf

from tensorflow.keras.preprocessing.image import ImageDataGenerator

# увеличение данных

train_datagen = ImageDataGenerator(

rescale=1./255,

shear_range=0.2,

zoom_range=0.2,

horizontal_flip=True

)

test_datagen = ImageDataGenerator(rescale=1./255)

train_generator = train_datagen.flow_from_dataframe(

train_df,

x_col='image',

y_col='label',

target_size=(150, 150),

batch_size=32,

class_mode='binary'

)

test_generator = test_datagen.flow_from_dataframe(

test_df,

x_col='image',

y_col='label',

target_size=(150, 150),

batch_size=32,

class_mode='binary'

)3. Построение модели

Мы будем использовать сверточные нейронные сети (CNN) для построения моделей глубокого обучения. CNN обладает превосходными характеристиками при обработке изображений и очень подходит для обнаружения безопасности пищевых продуктов.

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D, Flatten, Dense, Dropout

# Построить модель CNN

model = Sequential([

Conv2D(32, (3, 3), activation='relu', input_shape=(150, 150, 3)),

MaxPooling2D((2, 2)),

Conv2D(64, (3, 3), activation='relu'),

MaxPooling2D((2, 2)),

Conv2D(128, (3, 3), activation='relu'),

MaxPooling2D((2, 2)),

Flatten(),

Dense(512, activation='relu'),

Dropout(0.5),

Dense(1, activation='sigmoid')

])

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])4. Модельное обучение

Обучите модель с помощью набора обучающих данных и оцените производительность модели в наборе проверочных данных.

history = model.fit(

train_generator,

steps_per_epoch=train_generator.samples // train_generator.batch_size,

epochs=10,

validation_data=test_generator,

validation_steps=test_generator.samples // test_generator.batch_size

)5. Оценка и оптимизация модели.

После завершения обучения нам необходимо оценить производительность модели и оптимизировать ее.

# Оценка модели

loss, accuracy = model.evaluate(test_generator)

print(f'Потеря проверки: {loss:.4f}, Точность: {accuracy:.4f}')

# Нарисуйте кривую обучения

import matplotlib.pyplot as plt

plt.plot(history.history['accuracy'], label='Точность обучения')

plt.plot(history.history['val_accuracy'], label='Точность проверки')

plt.xlabel('Epochs')

plt.ylabel('Accuracy')

plt.legend()

plt.show()6. Практическое применение

Обученную модель можно использовать для реального мониторинга безопасности пищевых продуктов. Изображения пищевых продуктов собираются в режиме реального времени, вводятся в модель для обнаружения и выводятся результаты обнаружения.

from tensorflow.keras.preprocessing import image

import numpy as np

def predict_image(img_path):

img = image.load_img(img_path, target_size=(150, 150))

img_array = image.img_to_array(img) / 255.0

img_array = np.expand_dims(img_array, axis=0)

prediction = model.predict(img_array)

return 'нормальный' if prediction[0][0] > 0.5 else 'аномальный'

# Пример: Обнаружение изображения еды

print(predict_image('path/to/food_image.jpg'))Подвести итог

Во введении к этой статье мы покажем, как использовать Python и технологию глубокого обучения для создания интеллектуальной системы мониторинга безопасности пищевых продуктов. Система использует технологию распознавания изображений для автоматического обнаружения посторонних веществ или плохих условий в продуктах питания, повышая эффективность и точность проверки качества продуктов питания. Мы надеемся, что эта статья может предоставить читателям ценную информацию и вдохновить на дальнейшие исследования и инновации в области интеллектуального мониторинга безопасности пищевых продуктов.

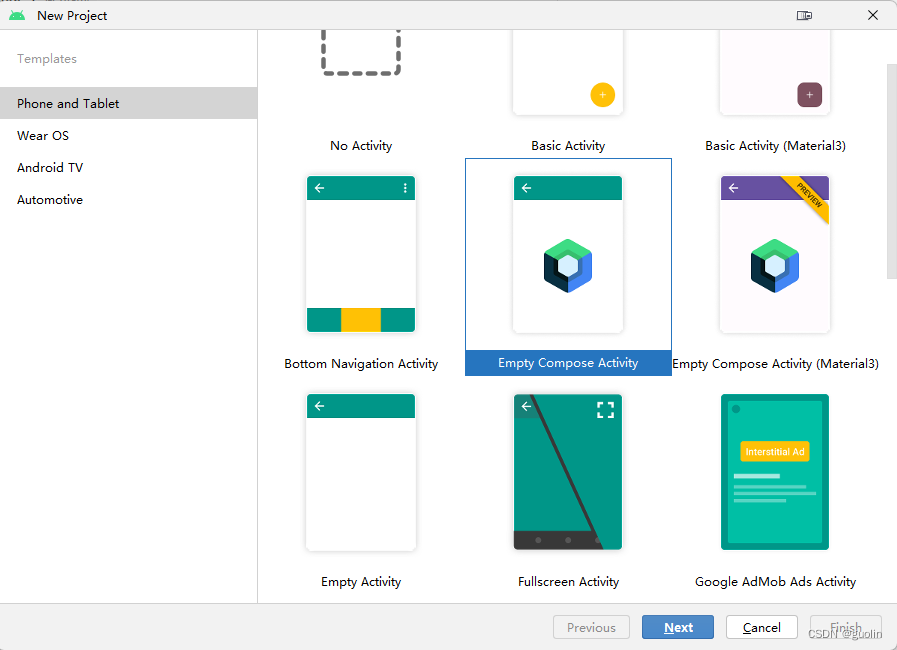

Учебное пособие по Jetpack Compose для начинающих, базовые элементы управления и макет

Код js веб-страницы, фон частицы, код спецэффектов

【новый! Суперподробное】Полное руководство по свойствам компонентов Figma.

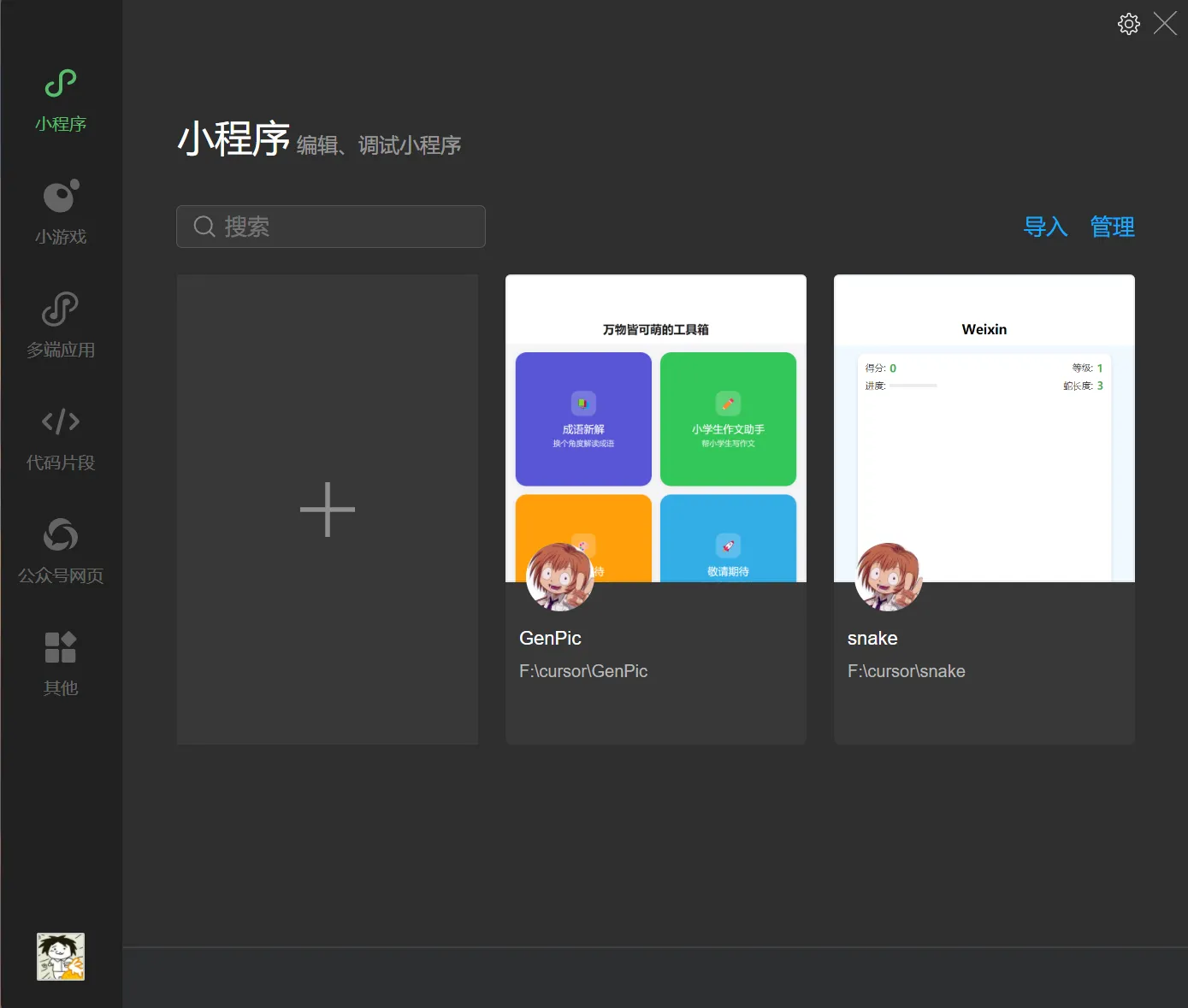

🎉Обязательно к прочтению новичкам: полное руководство по написанию мини-программ WeChat с использованием программного обеспечения Cursor.

[Забавный проект Docker] VoceChat — еще одно приложение для мгновенного чата (IM)! Может быть встроен в любую веб-страницу!

Как реализовать переход по странице в HTML (html переходит на указанную страницу)

Как решить проблему зависания и низкой скорости при установке зависимостей с помощью npm. Существуют ли доступные источники npm, которые могут решить эту проблему?

Серия From Zero to Fun: Uni-App WeChat Payment Practice WeChat авторизует вход в систему и украшает страницу заказа, создает интерфейс заказа и инициирует запрос заказа

Серия uni-app: uni.navigateЧтобы передать скачок значения

Апплет WeChat настраивает верхнюю панель навигации и адаптируется к различным моделям.

JS-время конвертации

Обеспечьте бесперебойную работу ChromeDriver 125: советы по решению проблемы chromedriver.exe не найдены

Поле комментария, щелчок мышью, специальные эффекты, js-код

Объект массива перемещения объекта JS

Как открыть разрешение на позиционирование апплета WeChat_Как использовать WeChat для определения местонахождения друзей

Я даю вам два набора из 18 простых в использовании фонов холста Power BI, так что вам больше не придется возиться с цветами!

Получить текущее время в js_Как динамически отображать дату и время в js

Вам необходимо изучить сочетания клавиш vsCode для форматирования и организации кода, чтобы вам больше не приходилось настраивать формат вручную.

У ChatGPT большое обновление. Всего за 45 минут пресс-конференция показывает, что OpenAI сделал еще один шаг вперед.

Copilot облачной разработки — упрощение разработки

Микросборка xChatGPT с низким кодом, создание апплета чат-бота с искусственным интеллектом за пять шагов

CUDA Out of Memory: идеальное решение проблемы нехватки памяти CUDA

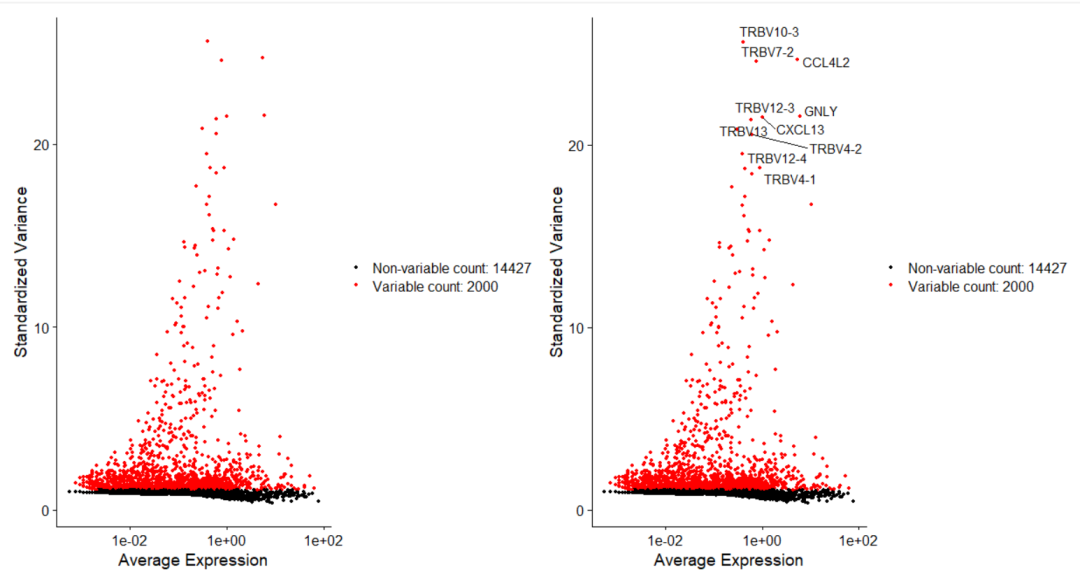

Анализ кластеризации отдельных ячеек, который должен освоить каждый&MarkerгенетическийВизуализация

vLLM: мощный инструмент для ускорения вывода ИИ

CodeGeeX: мощный инструмент генерации кода искусственного интеллекта, который можно использовать бесплатно в дополнение к второму пилоту.

Машинное обучение Реальный бой LightGBM + настройка параметров случайного поиска: точность 96,67%

Бесшовная интеграция, мгновенный интеллект [1]: платформа больших моделей Dify-LLM, интеграция без кодирования и встраивание в сторонние системы, более 42 тысяч звезд, чтобы стать свидетелями эксклюзивных интеллектуальных решений.

LM Studio для создания локальных больших моделей

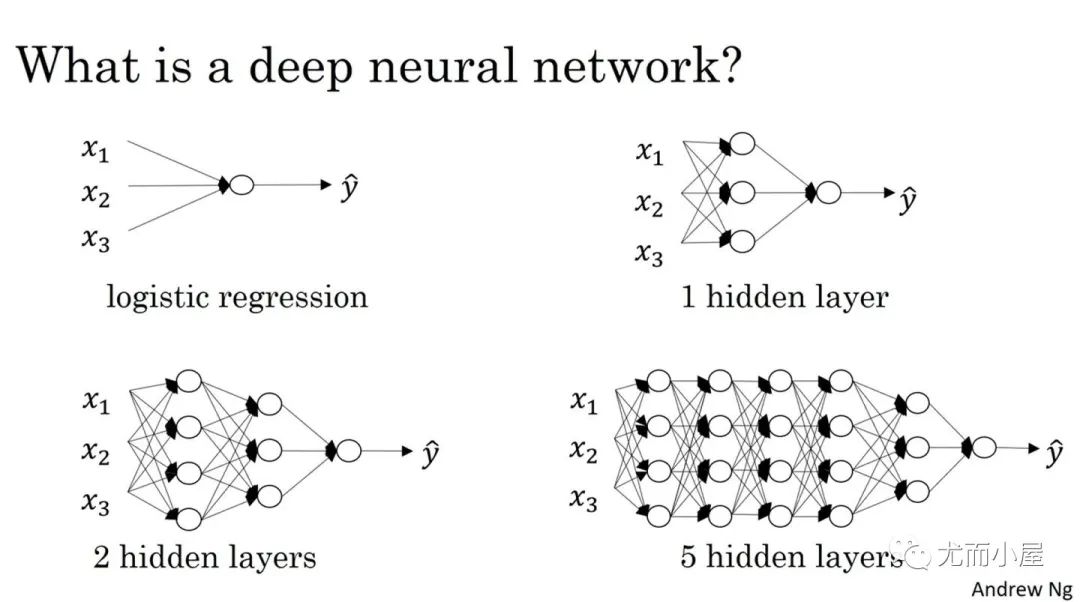

Как определить количество слоев и нейронов скрытых слоев нейронной сети?