hive обрабатывает существующие решения для небольших файлов

Вариант 1

Архив, архив. Hive имеет встроенную поддержку преобразования файлов в существующих разделах в архивы Hadoop (HAR), так что раздел, который когда-то состоял из 100 файлов, занимал только около 3 файлов (в зависимости от настройки).

Однако после архивирования его можно только запросить, а операции обновления и записи не поддерживаются.

set hive.archive.enabled=true;

set hive.archive.har.parentdir.settable=true;

set har.partfile.size=1099511627776;

#Архивируем определенный раздел таблицы

alter table test_rownumber2 archive partition(dt='20230324');

#Отменить

alter table test_rownumber2 unarchive partition(dt='20230324');ссылка:https://www.docs4dev.com/docs/zh/apache-hive/3.1.1/reference/LanguageManual_Archiving.html

Вариант 2

Для файлов orc вы можете использовать команду concatenate, поставляемую с hive, для автоматического объединения небольших файлов.

#Для несекционированных таблиц

alter table A concatenate;

#Для секционированных таблиц

alter table B partition(dt='2021-05-07',hr='12') concatenate;Уведомление:

1. Команда объединения поддерживает только типы файлов RCFILE и ORC.

2. При использовании команды объединения для объединения небольших файлов вы не можете указать количество объединяемых файлов, но можете выполнить команду несколько раз.

3. При многократном использовании конкатенации количество файлов не меняется. Это связано с настройкой параметра mapreduce.input.fileinputformat.split.minsize=256mb, который может задавать минимальный размер каждого файла.

Вариант 3 (рекомендуется)

Используйте sql, вставьте перезапись для восстановления данных.

При создании промежуточной таблицы с исходной структурой таблицы данные затем импортируются из исходной таблицы в промежуточную таблицу. Убедившись в согласованности данных, переименуйте промежуточную таблицу в исходное имя таблицы, измените исходную таблицу на имя временной таблицы и, наконец, удалите временную таблицу.

#1. Создайте временную таблицу (при создании временной таблицы структура исходной таблицы должна быть согласованной),

create table test.test_table_hive_merge like test.test_table_hive;

#Если таблица хранится в cos или ofs, вам может потребоваться изменить путь хранения после создания таблицы. По умолчанию используется путь hdfs.

alter table test_table_hive_merge set location 'cosn://hadoop-test-cos-1251458/warehouse/test.db/test_table_hive_merge';

#2. Установите параметры сеанса, связанные с объединенными файлами.

set hive.exec.dynamic.partition=true;

set hive.exec.dynamic.partition.mode=nonstrict;

set hive.exec.max.dynamic.partitions=3000;

set hive.exec.max.dynamic.partitions.pernode=5000;

set hive.merge.mapfiles=true ;

set hive.merge.mapredfiles=true ;

set hive.merge.tezfiles=true ;

set hive.merge.sparkfiles=true ;

set hive.merge.smallfiles.avgsize=256000000;

set hive.merge.size.per.task=512000000;

#3. Объедините файлы во временную таблицу и убедитесь, что никакие данные не записаны в исходную таблицу перед выполнением.

#Если существует несколько уровней разделов, поместите имя раздела в раздел

INSERT OVERWRITE TABLE test.test_table_hive_merge partition(batch_date) SELECT * FROM test.test_table_hive;

#4. Проверьте объем данных исходной таблицы и временной таблицы.

set hive.compute.query.using.stats=false ;

set hive.fetch.task.conversion=none;

SELECT count(*) FROM test.test_table_hive;

SELECT count(*) FROM test.test_table_hive_merge;

#5. Убедившись в согласованности данных таблицы, измените имя исходной таблицы на временную, измените среднюю таблицу на исходное имя таблицы и используйте оператор alter.

alter table test.test_table_hive rename to test.test_table_hive_tmp;

alter table test.test_table_hive_merge rename to test.test_table_hive;

#6 Проверьте количество объединенных разделов и количество мелких файлов.

hdfs dfs -count cosn://hadoop-test-cos-1251458/warehouse/test.db/test_table_hive

hdfs dfs -du -h cosn://hadoop-test-cos-1251458/warehouse/test.db/test_table_hive/batch_date=20210608

hdfs dfs -du -h cosn://hadoop-test-cos-1251458/warehouse/test.db/test_table_hive/batch_date=20210608 | wc -l

#7. Понаблюдайте некоторое время, прежде чем удалять временную таблицу.

drop table test.test_table_hive_tmp ;Примечание. При изменении имени таблицы куста изменится путь хранения соответствующей таблицы. Если есть задача по загрузке данных по определенному пути, обратите внимание, что его может потребоваться изменить.

Похожие скрипты:

#!/bin/bash

if [ ! -n "$1" ] ;then

echo "you have not input a file! The file content is the table name, default.test "

else

echo "the file you input is $1"

fi

hive=/usr/local/service/hive/bin/hive

#использоватьbeeline необходимо изменить адрес hs2

#hive=' /usr/local/service/hive/bin/beeline --showDbInPrompt=true -u "jdbc:hive2://10.0.0.30:7001" -n hadoop --outputformat=tsv2 --showHeader=false --silent=true '

#В основном передаваемые параметры

hive_sets=" set hive.exec.dynamic.partition=true; set hive.exec.dynamic.partition.mode=nonstrict; set hive.exec.max.dynamic.partitions=3000; set hive.exec.max.dynamic.partitions.pernode=5000; set hive.merge.mapfiles=true; set hive.merge.mapredfiles=true; set hive.merge.tezfiles=true; set hive.merge.sparkfiles=true; set hive.merge.smallfiles.avgsize=256000000; set hive.merge.size.per.task=512000000; "

#Файл временного хранения раздела

touch /tmp/partitions_tmp.txt ;

#Максимальная поддержка глубоких 4-уровневых разделов

funGetPart(){

pCount=$1 ;

tName=$2 ;

taHe=`$3 -n 1 /tmp/partitions_tmp.txt ` ;

if [ ${pCount} -eq 2 ];then

partition=$(echo ${taHe} | awk -F '=|/' '{print $1}')

elif [ ${pCount} -eq 4 ];then

partition=$(echo ${taHe} | awk -F '=|/' '{print $1","$3}')

elif [ ${pCount} -eq 6 ];then

partition=$(echo ${taHe} | awk -F '=|/' '{print $1","$3","$5}')

elif [ ${pCount} -eq 8 ];then

partition=$(echo ${taHe} | awk -F '=|/' '{print $1","$3","$5","$7}')

else

echo -e "\033[31m Parsing is not supported \n \033[0m"

exit -1 ;

fi

}

lineTables=$(cat $1)

for dataTab in ${lineTables}

do

#Определяем, ожидается ли имя таблицы. Имя библиотеки. Имя таблицы.

dataCount=` echo ${dataTab}| awk -F "." '{print NF}' `

if [ ${dataCount} -ne 2 ];then

echo -e "\033[31m The file content is incorrect!!! \033[0m"

echo -e "\033[31m For example: default.test \n \033[0m"

exit -1 ;

fi

#Определяем, является ли раздел таблицы нормальным

$hive -e "SHOW PARTITIONS ${dataTab} ; " > /tmp/partitions_tmp.txt

if [ ! -s /tmp/partitions_tmp.txt ];then

echo -e "\033[31m The table => ${dataTab} <= no partitione information \n \033[0m"

exit -1 ;

fi

##Сначала определите количество извлеченных двухрядных разделов

tpartCount=`(tail -n 1 /tmp/partitions_tmp.txt | awk -F '=|/' '{print NF}')`

hpartCount=`(head -n 1 /tmp/partitions_tmp.txt | awk -F '=|/' '{print NF}')`

if [ "${tpartCount}" = "" ] || [ "${hpartCount}" = "" ];then

echo -e "\033[31m The table => ${dataTab} <= no partitione information \n \033[0m"

exit -1 ;

fi

if [ ${tpartCount} -ne ${hpartCount} ];then

echo -e "\033[31m The table => ${dataTab} <= have different number of partitions \n \033[0m"

exit -1 ;

fi

## Затем оцените извлеченные 2 строки информации о разделах

funGetPart ${hpartCount} ${dataTab} head

hpartValue=${partition}

funGetPart ${tpartCount} ${dataTab} tail

tpartValue=${partition}

if [ "${hpartValue}" != "${tpartValue}" ];then

echo -e "\033[31m The table => ${dataTab} <= have different value of partitions \n \033[0m"

exit -1 ;

fi

echo "В настоящее время обрабатывается таблица: ${dataTab} , Раздел: ${tpartValue} "

echo -e "==> Create table : ${dataTab}_merge from: ${dataTab} \n "

#Если промежуточная таблица уже существует, выберите, продолжать ли выполнение. По умолчанию выполняется выход из выполнения.

#${hive} -e "create table if not exists ${dataTab}_merge like ${dataTab} ; "

${hive} -e "create table ${dataTab}_merge like ${dataTab} ; "

if [ $? -ne 0 ];then

echo -e "\033[31m ${dataTab}_merge Creat fail \n \033[0m" ;

exit -1 ;

fi

echo -e "==> Overwrite table : ${dataTab}_merge , partition: ${tpartValue} , from: ${dataTab} \n "

${hive} -e " ${hive_sets} INSERT OVERWRITE TABLE ${dataTab}_merge partition(${tpartValue}) SELECT * FROM ${dataTab} ; "

if [ $? -eq 0 ];then

echo -e "\033[32m ${dataTab}_merge Overwrite success \n \033[0m" ;

#Изменяем имя исходной таблицы на временную таблицу и заменяем промежуточную таблицу на имя исходной таблицы

echo -e "==> Rename ${dataTab} To ${dataTab}_tmp \n "

${hive} -e " alter table ${dataTab} rename to ${dataTab}_tmp ; "

echo -e "==> Rename ${dataTab}_merge To ${dataTab} \n "

${hive} -e " alter table ${dataTab}_merge rename to ${dataTab} ; "

echo -e "==> Имена таблиц, которые необходимо удалить позже: ${dataTab}_tmp ; drop table ${dataTab}_tmp \n ; "

else

echo -e "\033[31m => ${dataTab} <= merged fail \n \033[0m"

exit -1 ;

fi

sleep 1

done

wait

Вариант 4

Для файлов в формате txt вы можете использовать Hadoop getmerge для объединения небольших файлов.

Используйте команду getmerge, чтобы сначала объединить данные локально, а затем загрузить их обратно через put.

hadoop fs -getmerge /user/hive/warehouse/xxxx.db/xxxx/pdate=20220815/* /home/hadoop/pdate/20220815

hadoop fs -rm /user/hive/warehouse/xxxx.db/xxxx/pdate=20220815/*

hadoop fs -mkdir -p /user/hive/warehouse/xxxx.db/xxxx/pdate=20220815

hadoop fs -put /home/hadoop/pdate/20220815 /user/hive/warehouse/xxxx.db/xxxx/pdate=20220815/*Справочник по соответствующему сценарию

#!/bin/bash

if [ ! -n "$1" ] ;then

echo "you have not input a file!"

else

echo "the file you input is $1"

fi

lineurl=$(cat $1)

hadoop=/usr/local/service/hadoop/bin/hadoop

localbak=/home/hadoop/pdate

for line in $lineurl

do

echo «Текущая обработка: $line "

file_name=`echo $line | awk -F "=" '{print $NF}'`

table_name=`echo $line | awk -F "/" '{print $(NF-1)}'`

mkdir -p ${localbak}/${table_name}

echo "=> Getmerge data to ${localbak}/${table_name}/${file_name} "

${hadoop} fs -getmerge ${line}/* ${localbak}/${table_name}/${file_name}

echo "=> Rm ${line} "

${hadoop} fs -rm ${line}/*

${hadoop} fs -mkdir -p ${line}

echo "=> Put ${localbak}/${table_name}/${file_name} To ${line} "

${hadoop} fs -put ${localbak}/${table_name}/${file_name} ${line}/

${hadoop} fs -test -f ${line}/${file_name}

if [ $? -eq 0 ];then

echo -e "\033[32m $line merged success \n \033[0m"

else

echo -e "\033[31m $line merged fail \n \033[0m"

fi

sleep 1

done

waitссылка:

https://jishuin.proginn.com/p/763bfbd631ad

https://cloud.tencent.com/developer/article/1514064

https://developer.aliyun.com/article/952137

https://www.jianshu.com/p/e5e4fd4b039c

Углубленный анализ переполнения памяти CUDA: OutOfMemoryError: CUDA не хватает памяти. Попыталась выделить 3,21 Ги Б (GPU 0; всего 8,00 Ги Б).

[Решено] ошибка установки conda. Среда решения: не удалось выполнить первоначальное зависание. Повторная попытка с помощью файла (графическое руководство).

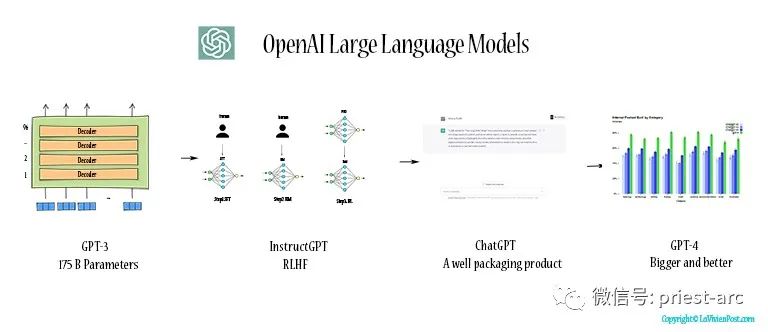

Прочитайте нейросетевую модель Трансформера в одной статье

.ART Теплые зимние предложения уже открыты

Сравнительная таблица описания кодов ошибок Amap

Уведомление о последних правилах Points Mall в декабре 2022 года.

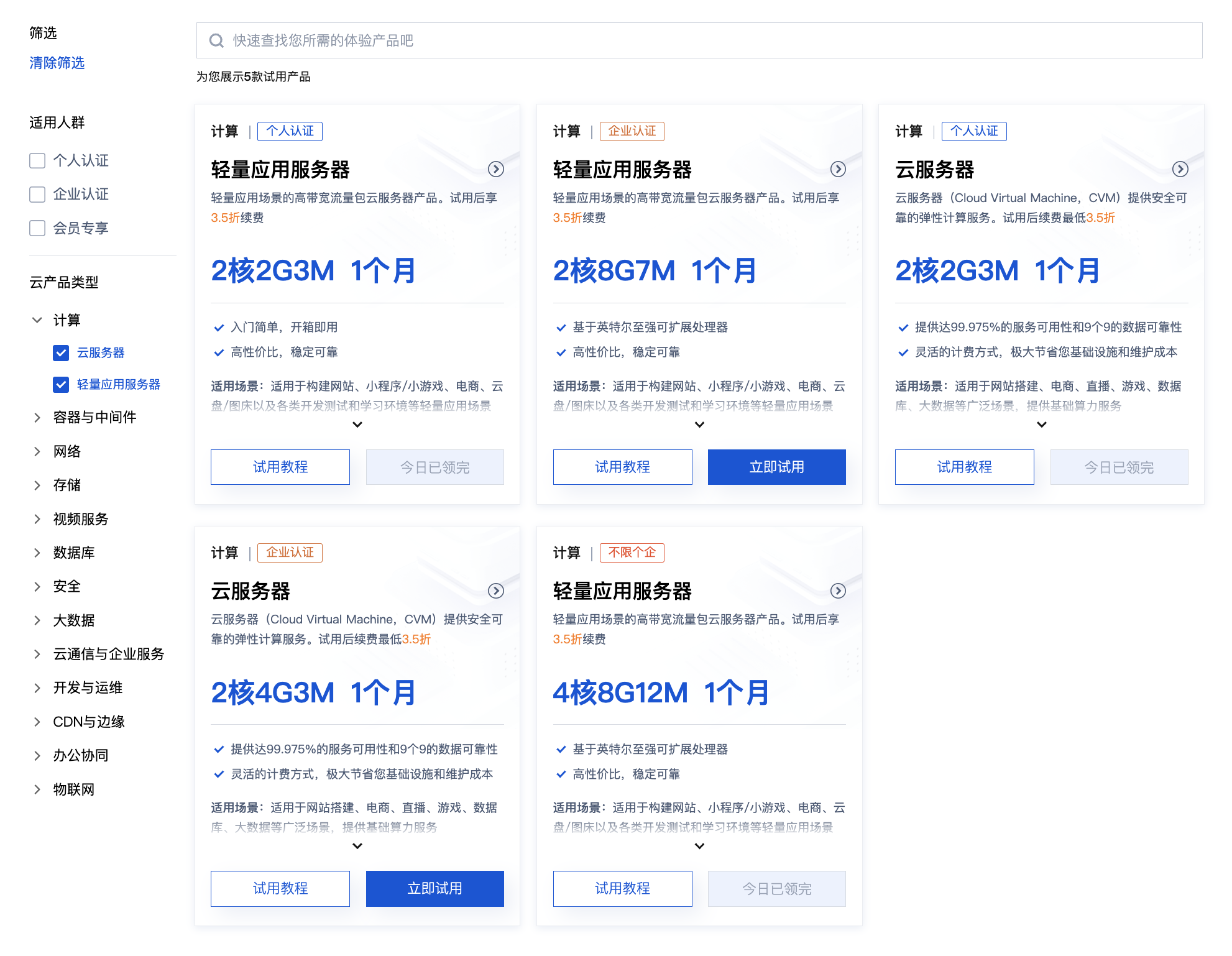

Даже новички могут быстро приступить к работе с легким сервером приложений.

Взгляд на RSAC 2024|Защита конфиденциальности в эпоху больших моделей

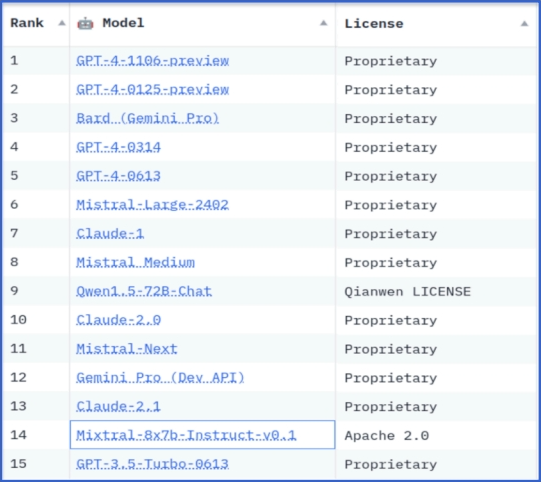

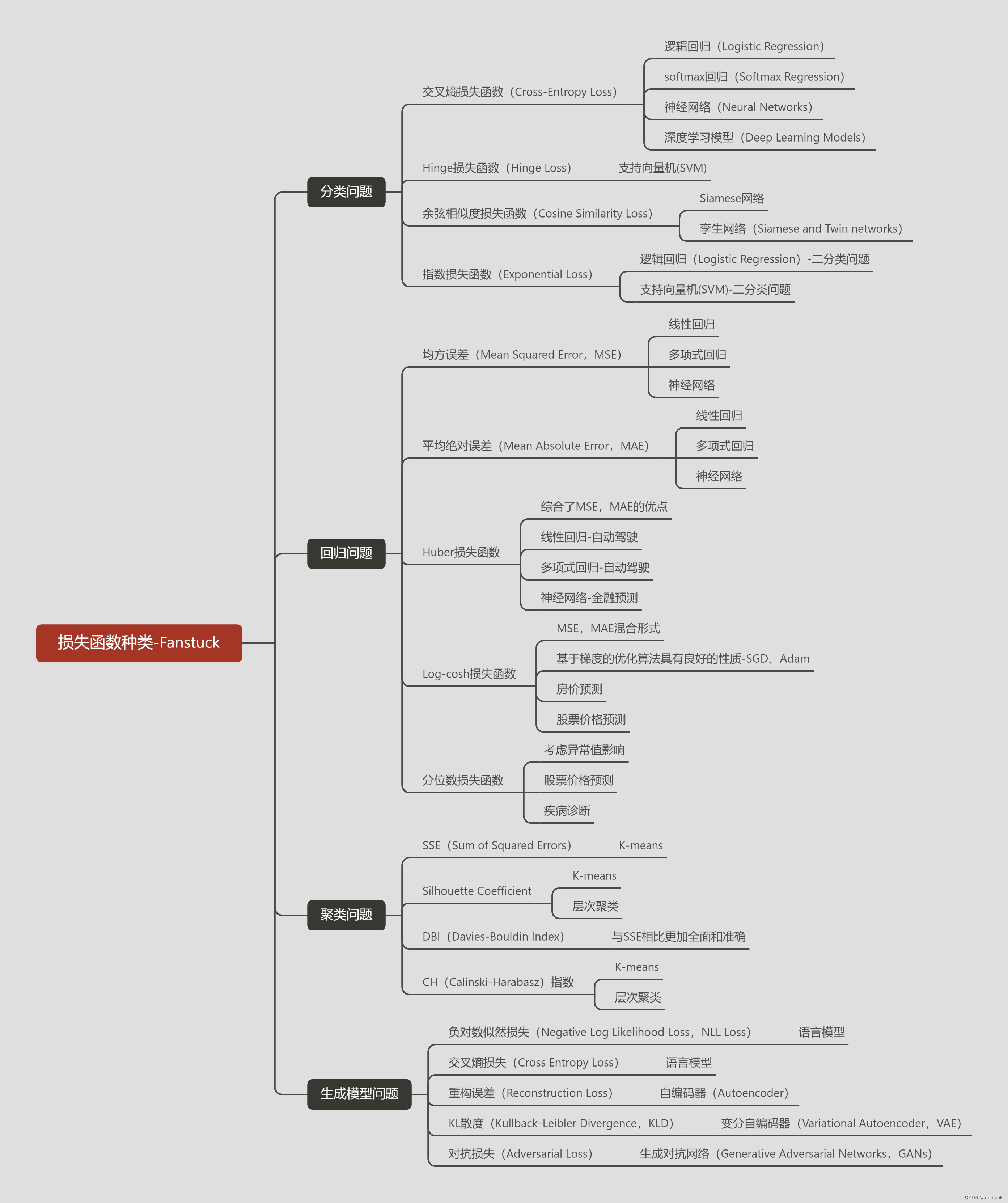

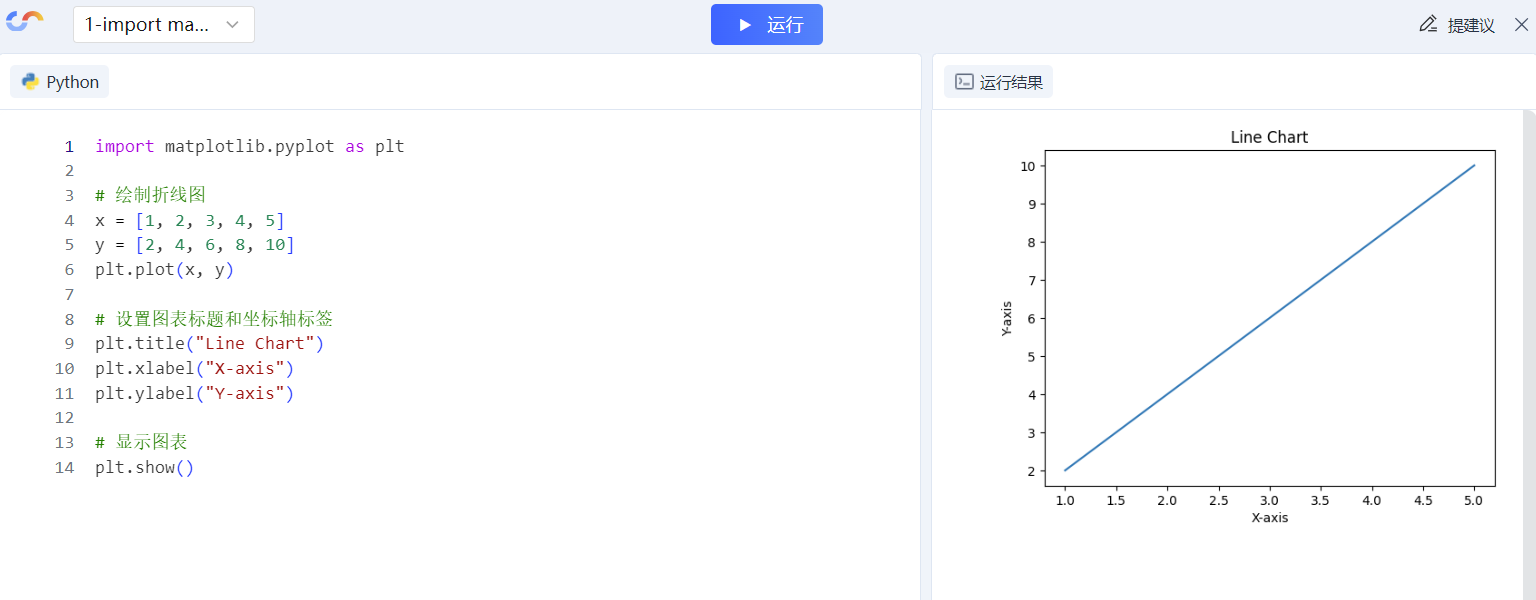

Вы используете ИИ каждый день и до сих пор не знаете, как ИИ дает обратную связь? Одна статья для понимания реализации в коде Python общих функций потерь генеративных моделей + анализ принципов расчета.

Используйте (внутренний) почтовый ящик для образовательных учреждений, чтобы использовать Microsoft Family Bucket (1T дискового пространства на одном диске и версию Office 365 для образовательных учреждений)

Руководство по началу работы с оперативным проектом (7) Практическое сочетание оперативного письма — оперативного письма на основе интеллектуальной системы вопросов и ответов службы поддержки клиентов

[docker] Версия сервера «Чтение 3» — создайте свою собственную программу чтения веб-текста

Обзор Cloud-init и этапы создания в рамках PVE

Корпоративные пользователи используют пакет регистрационных ресурсов для регистрации ICP для веб-сайта и активации оплаты WeChat H5 (с кодом платежного узла версии API V3)

Подробное объяснение таких показателей производительности с высоким уровнем параллелизма, как QPS, TPS, RT и пропускная способность.

Удачи в конкурсе Python Essay Challenge, станьте первым, кто испытает новую функцию сообщества [Запускать блоки кода онлайн] и выиграйте множество изысканных подарков!

[Техническая посадка травы] Кровавая рвота и отделка позволяют вам необычным образом ощипывать гусиные перья! Не распространяйте информацию! ! !

[Официальное ограниченное по времени мероприятие] Сейчас ноябрь, напишите и получите приз

Прочтите это в одной статье: Учебник для няни по созданию сервера Huanshou Parlu на базе CVM-сервера.

Cloud Native | Что такое CRD (настраиваемые определения ресурсов) в K8s?

Как использовать Cloudflare CDN для настройки узла (CF самостоятельно выбирает IP) Гонконг, Китай/Азия узел/сводка и рекомендации внутреннего высокоскоростного IP-сегмента

Дополнительные правила вознаграждения амбассадоров акции в марте 2023 г.

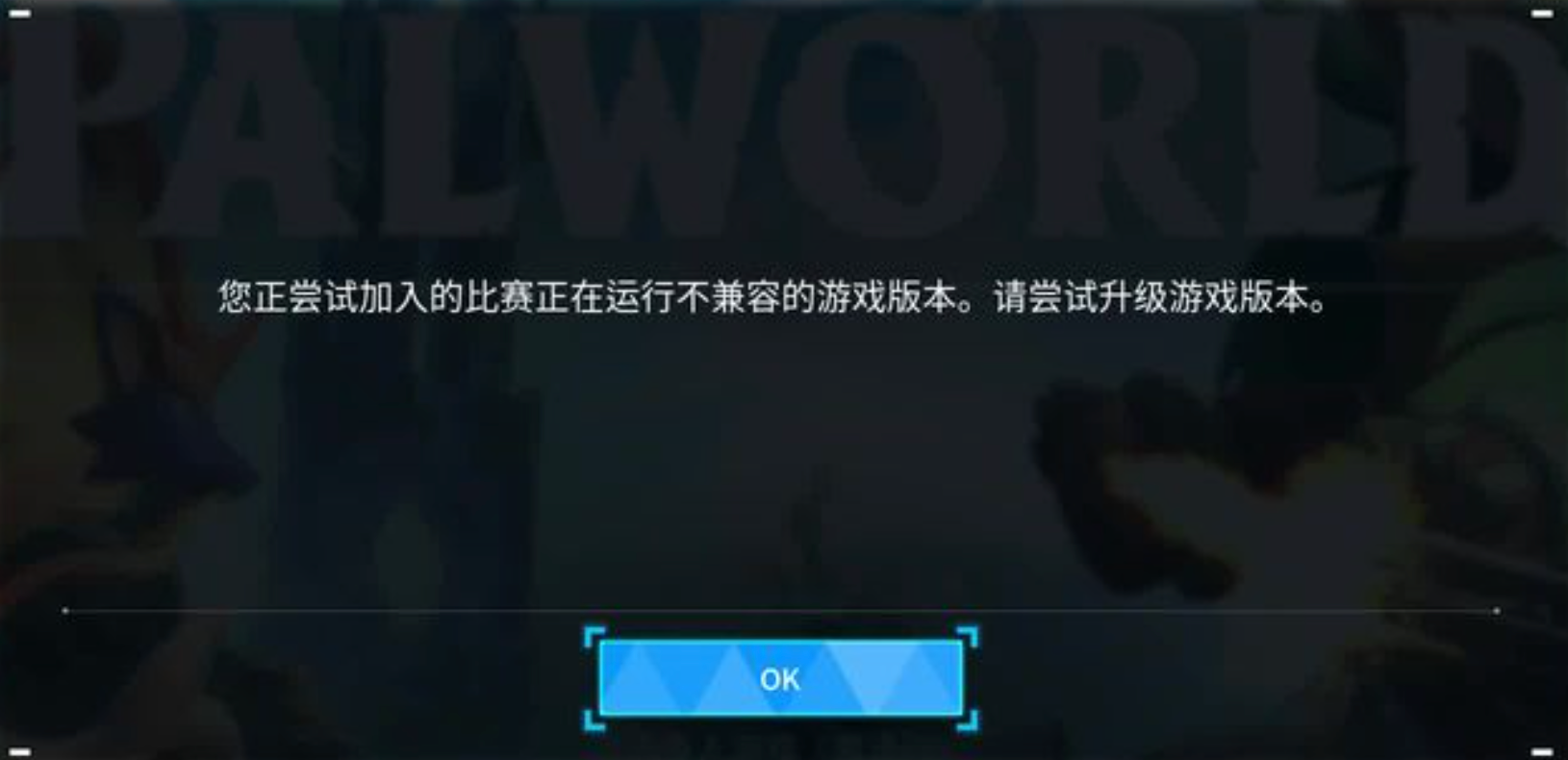

Можно ли открыть частный сервер Phantom Beast Palu одним щелчком мыши? Супер простой урок для начинающих! (Прилагается метод обновления сервера)

[Играйте с Phantom Beast Palu] Обновите игровой сервер Phantom Beast Pallu одним щелчком мыши

Maotouhu делится: последний доступный внутри страны адрес склада исходного образа Docker 2024 года (обновлено 1 декабря)

Кодирование Base64 в MultipartFile

5 точек расширения SpringBoot, супер практично!

Глубокое понимание сопоставления индексов Elasticsearch.